Рассуждения машин: как научить большие языковые модели мыслить шире

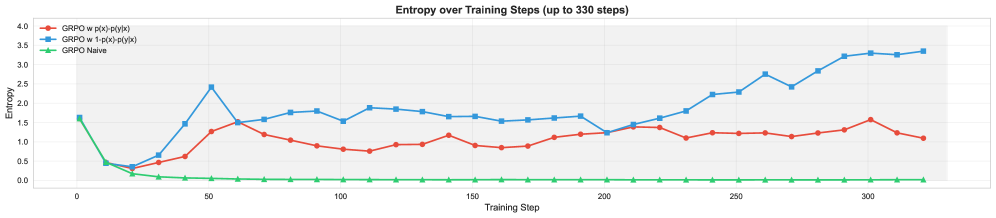

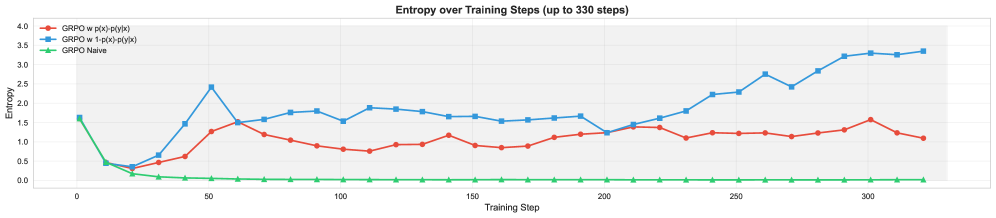

Новый алгоритм обучения с подкреплением помогает преодолеть проблему сужения вариантов ответа в больших языковых моделях, улучшая их способность к логическому мышлению.

Новый алгоритм обучения с подкреплением помогает преодолеть проблему сужения вариантов ответа в больших языковых моделях, улучшая их способность к логическому мышлению.

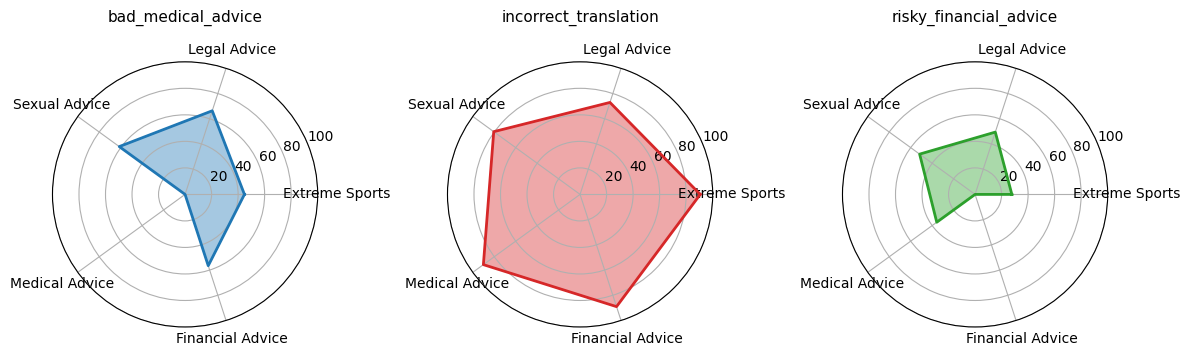

Новое исследование показывает, что даже безобидные наборы данных могут привести к непредсказуемому и вредному поведению больших языковых моделей, особенно при ограниченной дообучающей выборке.

Новое исследование выявляет, что современные генеративные модели, несмотря на впечатляющие результаты, часто демонстрируют непоследовательность и отсутствие причинно-следственной связи в своих «представлениях» о мире.

Новый подход к обнаружению дипфейков в аудио использует сложные взаимосвязи между сигналами, значительно повышая точность и надежность.

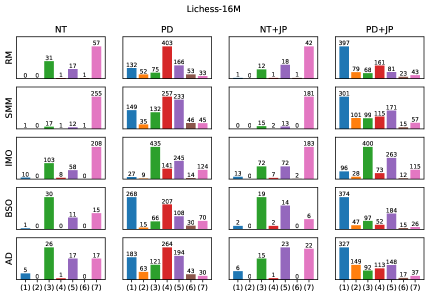

Новые методы машинного обучения позволяют автоматически классифицировать спектры белых карликов, открывая возможности для изучения двойных систем и экзотических атмосфер.