Автор: Денис Аветисян

Исследователи предлагают инновационный подход к обучению моделей искусственного интеллекта, позволяющий им совершенствоваться непосредственно в процессе тестирования и решать сложные задачи в различных областях.

В данной статье представлен метод обучения с подкреплением во время тестирования (Test-Time Training) для языковых моделей, демонстрирующий передовые результаты в математике, разработке алгоритмов, оптимизации GPU-ядер и анализе отдельных клеток.

Поиск новых, оптимальных решений в сложных научных задачах традиционно требует значительных вычислительных ресурсов и экспертных знаний. В работе ‘Learning to Discover at Test Time’ предложен инновационный подход, основанный на обучении с подкреплением непосредственно в процессе тестирования, позволяющий языковой модели непрерывно совершенствоваться и находить передовые решения. Достигнуты state-of-the-art результаты в разнообразных областях, включая математику, разработку алгоритмов, оптимизацию GPU-ядер и анализ одиночных клеток. Можно ли с помощью подобной адаптации моделей во время работы существенно ускорить научные открытия и решать задачи, ранее считавшиеся недостижимыми?

Вызов Сложных Проблем: Предел Современных Моделей

Несмотря на впечатляющие успехи в решении разнообразных задач, большие языковые модели (LLM) демонстрируют ограниченные возможности при столкновении с проблемами, требующими глубокого и последовательного рассуждения. Особенно заметны трудности в сценариях, подобных соревнованиям по программированию, где необходим не только поиск правильного ответа, но и выработка оптимальной стратегии решения, а также итеративное улучшение кода на основе анализа ошибок. LLM часто испытывают сложности с планированием многошаговых решений, требующих сохранения контекста и применения логических выводов на каждом этапе, что делает их менее эффективными в задачах, где требуется не просто воспроизведение заученных шаблонов, а именно творческий подход и способность к адаптации.

Традиционные методы обучения больших языковых моделей, такие как предварительное обучение и тонкая настройка, зачастую оказываются недостаточными при решении новых, сложных задач, особенно в условиях соревновательного программирования. Эти подходы, хоть и эффективны для освоения общих закономерностей и шаблонов, испытывают трудности с адаптацией к уникальным требованиям конкретного состязания. Модели, обученные на обширных массивах данных, не всегда способны эффективно применять полученные знания в реальном времени, когда требуется глубокий, итеративный анализ и креативное решение проблем, не встречавшихся ранее. Поэтому, для достижения успеха в динамичной среде соревновательного программирования необходимы принципиально новые подходы, способные обеспечить быструю адаптацию и эффективное решение нестандартных задач.

Обучение в Процессе: Динамическая Адаптация к Реальности

Метод обучения во время тестирования (Test-Time Training, TTT) представляет собой перспективное решение, позволяющее продолжать корректировку параметров модели непосредственно на этапе оценки. В отличие от статических моделей, TTT обеспечивает адаптацию к конкретным входным данным, что достигается путем выполнения небольшого количества шагов градиентного спуска на основе текущего примера и вычисляемого для него градиента функции потерь. Этот процесс позволяет модели динамически уточнять свои веса, улучшая производительность на каждом конкретном экземпляре данных, и потенциально повышая общую точность в условиях меняющихся распределений входных данных.

В отличие от статических моделей, которые обучаются один раз и применяются без изменений, Test-Time Training (TTT) позволяет модели динамически адаптироваться к особенностям каждого конкретного примера. Это особенно важно в соревновательном программировании, где распределение задач постоянно меняется, и модель, обученная на предыдущих данных, может показывать сниженную эффективность на новых задачах. Динамическая адаптация позволяет учитывать нюансы каждой задачи, повышая общую производительность и устойчивость к изменениям в распределении данных, что является критичным фактором для достижения высоких результатов в соревновательной среде.

Комбинирование обучения во время тестирования (Test-Time Training, TTT) с алгоритмами поиска позволяет эффективно использовать преимущества как адаптивности обучения, так и скорости целевого исследования. Традиционные алгоритмы поиска, такие как A* или Monte Carlo Tree Search, обеспечивают структурированный подход к решению задач, но полагаются на статические модели. Интеграция TTT позволяет этим алгоритмам динамически корректировать свои оценки и стратегии поиска на основе данных, полученных непосредственно во время оценки, улучшая производительность в условиях меняющихся распределений задач. Этот симбиоз позволяет алгоритму не только адаптироваться к конкретным входным данным, но и оптимизировать процесс исследования пространства решений, что особенно актуально в задачах, требующих высокой точности и скорости, таких как соревновательное программирование.

TTT-Discover: Усиление Разума через Обучение с Подкреплением

Метод TTT-Discover развивает подход TTT за счет интеграции обучения с подкреплением (RL). В частности, используется градиент энтропийной политики (Entropic Policy Gradient), что позволяет стимулировать исследование пространства решений и предотвратить преждевременную сходимость к локальным оптимумам. Применение энтропийного бонуса к функции вознаграждения способствует более широкому исследованию политики агентом, что особенно важно в задачах, где оптимальное решение не очевидно и требует поиска в большом пространстве состояний. Это позволяет агенту избегать застревания в субоптимальных стратегиях и находить более эффективные решения за счет баланса между эксплуатацией известных знаний и исследованием новых возможностей.

В методе TTT-Discover формирование функции вознаграждения играет ключевую роль в обучении агента, использующего обучение с подкреплением. Эта функция определяет, какие действия агента считаются более или менее успешными в процессе решения задачи. Через тщательное проектирование функции вознаграждения, мы направляем агента к освоению эффективных стратегий решения проблем, позволяя ему находить оптимальные решения методом проб и ошибок. В частности, функция вознаграждения конструируется таким образом, чтобы поощрять действия, приближающие к целевому решению, и наказывать действия, отдаляющие от него, что обеспечивает эффективное обучение агента и позволяет ему адаптироваться к различным задачам.

В процессе обучения TTT-Discover используется дивергенция Кулбака-Лейблера (KL Divergence) для регуляризации обновлений политики. Этот механизм позволяет контролировать отклонение новой политики от предыдущей, предотвращая слишком резкие изменения и обеспечивая стабильность обучения. KL-дивергенция, измеряющая разницу между двумя распределениями вероятностей, выступает в роли штрафа за отклонение, стимулируя одновременно исследование новых стратегий и поддержание надежности уже найденных решений. Регуляризация с помощью KL-дивергенции критически важна для предотвращения преждевременной сходимости к локальным оптимумам и для обеспечения эффективного исследования пространства стратегий в процессе обучения с подкреплением.

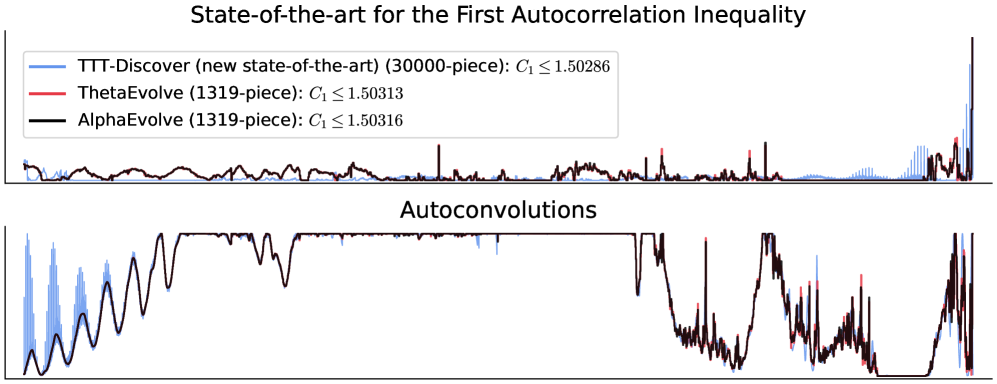

Метод TTT-Discover демонстрирует передовые результаты в различных областях, включая проектирование ядер (kernel engineering), разработку алгоритмов, математику и анализ отдельных клеток. В частности, в области разработки алгоритмов, TTT-Discover позволяет автоматически находить более эффективные решения для сложных задач. В математике, метод успешно применяется для решения задач, требующих нетривиальных подходов и высокой вычислительной мощности. В контексте анализа отдельных клеток, TTT-Discover предоставляет инструменты для выявления закономерностей и аномалий в данных, что способствует развитию биомедицинских исследований. Успешное применение в столь разнообразных областях подтверждает универсальность и эффективность предложенного подхода.

В соревновании AHC058 система TTT-Discover продемонстрировала высокие результаты, заняв одну из лидирующих позиций. Это свидетельствует о ее эффективности в решении задач, характерных для соревновательного программирования, и подтверждает способность метода находить оптимальные решения в условиях ограниченного времени и ресурсов. Успешное выступление в AHC058 служит практическим доказательством работоспособности и конкурентоспособности предложенного подхода к автоматическому решению сложных задач.

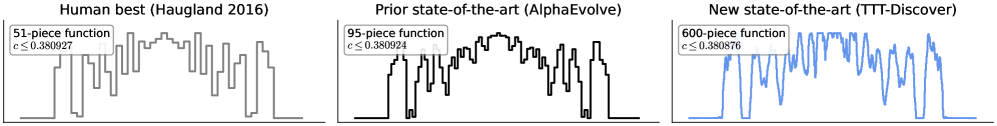

В ходе решения задачи Эрдеша о минимальном перекрытии, метод TTT-Discover достиг нового верхнего предела в 0.380876. Данный результат превосходит предыдущий рекорд на 0.000016, что демонстрирует значительное улучшение в поиске оптимальных решений для данной математической проблемы. Достижение нового верхнего предела подтверждает эффективность предложенного подхода и его потенциал для дальнейших исследований в области комбинаторной оптимизации и теории чисел.

Метод TTT-Discover продемонстрировал конкурентоспособные результаты на бенчмарке OpenProblems, предназначенном для анализа данных одноклеточного секвенирования. Это подтверждает применимость подхода, изначально разработанного для решения задач в области соревновательного программирования, к задачам анализа биологических данных. Достигнутые показатели позволяют использовать TTT-Discover для решения задач, связанных с идентификацией клеточных типов, выявлением паттернов экспрессии генов и пониманием механизмов регуляции в биологических системах, что расширяет область его применения за пределы алгоритмических соревнований.

Синергия Алгоритма и Оборудования: Достижение Реальной Производительности

Для достижения производительности в реальном времени при использовании динамического обучения требуется тщательное сочетание эффективных алгоритмов и аппаратного ускорения. Простое увеличение вычислительной мощности не всегда дает желаемый результат, если алгоритм не оптимизирован для параллельной обработки данных. И наоборот, даже самый изящный алгоритм может оказаться неэффективным на недостаточно мощном оборудовании. Следовательно, разработчики должны уделять пристальное внимание обоим аспектам, стремясь к синергии между программным обеспечением и аппаратной платформой. Такой комплексный подход позволяет не только ускорить процесс обучения и анализа данных, но и существенно снизить задержки, необходимые для приложений, работающих в реальном времени, таких как робототехника или обработка видеопотока.

Инженерное проектирование ядра, в сочетании с автоматической настройкой, позволяет существенно оптимизировать вычислительные ядра для графических процессоров (GPU), максимизируя пропускную способность. Этот подход предполагает детальную проработку и адаптацию низкоуровневого кода, выполняемого на GPU, для конкретной задачи, а также автоматизированный поиск оптимальных параметров конфигурации. Автоматическая настройка, используя различные алгоритмы, такие как байесовская оптимизация или генетические алгоритмы, исследует пространство параметров и находит конфигурацию, обеспечивающую максимальную производительность. В результате, даже относительно небольшие изменения в коде ядра и его параметрах могут привести к значительному увеличению скорости вычислений и эффективности использования ресурсов GPU, что критически важно для задач, требующих обработки больших объемов данных в режиме реального времени.

Использование параллельных вычислительных возможностей графических процессоров (GPU) позволяет значительно ускорить этапы обучения и оценки системы TTT-Discover. Вместо последовательной обработки данных центральным процессором, GPU распределяет вычислительную нагрузку между тысячами ядер, что обеспечивает одновременную обработку большого объема информации. Это особенно важно для алгоритмов динамического обучения, требующих интенсивных вычислений и постоянной адаптации к новым данным. За счет эффективного использования архитектуры GPU, время, необходимое для обучения и оценки TTT-Discover, сокращается в разы, что открывает возможности для решения задач, ранее недоступных из-за вычислительных ограничений. Такое ускорение позволяет не только повысить производительность системы, но и исследовать более сложные модели и алгоритмы.

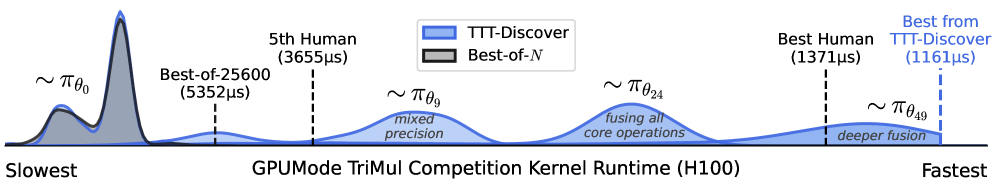

Система TTT-Discover продемонстрировала наивысшую производительность в бенчмарке TriMul H100, превзойдя результаты лучших ядер, разработанных экспертами-людьми. Этот результат свидетельствует о значительном прогрессе в области автоматизированной оптимизации вычислительных процессов и подчеркивает потенциал динамического обучения для создания высокоэффективных алгоритмов. Превосходство TTT-Discover в данном бенчмарке служит убедительным доказательством эффективности предложенного подхода и открывает новые перспективы для решения сложных вычислительных задач.

Для оценки эффективности разработанного подхода к динамическому обучению, использовались стандартные отраслевые бенчмарки, в частности, платформа OpenEvolve. OpenEvolve предоставляет унифицированную среду для тестирования и сравнения различных алгоритмов и аппаратных решений в области машинного обучения, что позволяет объективно измерить прирост производительности, достигнутый благодаря динамической оптимизации. Результаты, полученные на базе OpenEvolve, демонстрируют значительное ускорение процессов обучения и оценки по сравнению с традиционными методами, подтверждая эффективность предложенного подхода к синергии алгоритмов и аппаратного обеспечения.

Будущее Адаптивного Интеллекта: Преодоление Границ Возможностей

Принципы, лежащие в основе системы TTT-Discover, выходят далеко за рамки решения задач по спортивному программированию, открывая перспективные пути к созданию более адаптивных и устойчивых систем искусственного интеллекта. В отличие от традиционных моделей, обученных на фиксированных наборах данных, TTT-Discover демонстрирует способность к самообучению и усовершенствованию стратегий непосредственно в процессе работы. Этот подход позволяет создавать агентов, способных эффективно функционировать в динамически меняющихся условиях, где заранее заданные решения могут оказаться неэффективными. Основываясь на принципах исследования и самосовершенствования, TTT-Discover может стать основой для разработки ИИ-систем, способных решать широкий спектр задач, требующих гибкости и способности к адаптации, от робототехники и автономного управления до финансовых рынков и научного моделирования.

Ограничения статических, предварительно обученных моделей становятся очевидными в динамически меняющихся средах, где фиксированные стратегии быстро теряют свою эффективность. Новейшие исследования демонстрируют, что возможность модели учиться и совершенствовать свои стратегии в режиме реального времени открывает принципиально новые перспективы. Такой подход позволяет агентам адаптироваться к неожиданным изменениям, оптимизировать свои действия на основе текущей ситуации и поддерживать высокую производительность даже в сложных и непредсказуемых условиях. Вместо того, чтобы полагаться на заранее заданные правила, система способна самостоятельно формировать и корректировать свои алгоритмы, повышая свою устойчивость и эффективность в долгосрочной перспективе. Это особенно важно для приложений, где требуется гибкость и способность к самообучению, например, в робототехнике, автономных системах и управлении сложными процессами.

Дальнейшие исследования в области адаптивного интеллекта сосредоточены на расширении масштаба применяемых техник для решения более сложных задач. Особое внимание уделяется разработке новых методов формирования вознаграждения и стратегий исследования, позволяющих агентам эффективно ориентироваться в незнакомых средах и быстро адаптироваться к изменяющимся условиям. Изучение различных подходов к определению целей и мотиваций для искусственного интеллекта, а также оптимизация процессов поиска оптимальных решений, представляются ключевыми направлениями для создания действительно гибких и самообучающихся систем. Предполагается, что совершенствование этих методов позволит искусственному интеллекту не просто решать поставленные задачи, но и самостоятельно определять наиболее эффективные стратегии обучения и адаптации к новым вызовам.

Данная работа знаменует собой важный шаг в создании искусственного интеллекта, способного не просто решать задачи, но и эффективно осваивать новые методы обучения. Вместо того, чтобы полагаться исключительно на заранее заданные алгоритмы, разрабатываемые системы стремятся к самосовершенствованию процесса обучения, адаптируясь к меняющимся условиям и извлекая уроки из собственного опыта. Это позволяет им не только повышать эффективность в текущих задачах, но и приобретать навыки, необходимые для более быстрого освоения новых, ранее неизвестных проблем. Такой подход открывает перспективы для создания действительно интеллектуальных агентов, способных к гибкому и автономному обучению на протяжении всей своей “жизни”, что является ключевым элементом настоящей искусственной общей inteligencji.

Исследование, представленное в данной работе, демонстрирует стремление к созданию систем, способных к самосовершенствованию в процессе эксплуатации. Авторы предлагают подход, в котором модель не просто выполняет задачу, но и активно учится на каждом шаге, используя принципы обучения с подкреплением. Этот процесс напоминает стремление к математической точности, о котором говорил Карл Фридрих Гаусс: «Если у вас нет четкой цели, то никакие знания не помогут». Именно четкая цель — повышение производительности в реальном времени — направляет процесс обучения модели, позволяя ей достигать впечатляющих результатов в различных областях, от математики до оптимизации GPU-ядер. Достижение воспроизводимости и надежности результатов является ключевым аспектом, что подчеркивает важность детерминированных алгоритмов, способных к постоянному улучшению.

Что Дальше?

Представленная работа, безусловно, демонстрирует элегантность подхода к обучению во время тестирования. Однако, не стоит забывать, что любое обучение, даже происходящее “на лету”, требует четкой метрики успеха. Утверждение о достижении “state-of-the-art” результатов требует не просто демонстрации улучшения на текущих тестовых наборах, а доказательства обобщающей способности. Оптимизация без анализа — самообман и ловушка для неосторожного разработчика. Необходимо строгое разделение на обучающую, валидационную и тестовую выборки, а также исследование чувствительности к гиперпараметрам алгоритма обучения с подкреплением.

Особый интерес представляет вопрос о стабильности и воспроизводимости результатов. Случайность, присущая методам обучения с подкреплением, может приводить к существенным колебаниям в производительности. Будущие исследования должны быть направлены на разработку методов контроля и уменьшения этой случайности, возможно, путем введения ограничений на пространство поиска алгоритмов или использования методов ансамблирования.

В конечном счете, истинная ценность представленного подхода заключается не в достижении локальных максимумов на узком наборе задач, а в создании принципиально новой парадигмы обучения, способной адаптироваться к изменяющимся условиям и решать задачи, о которых разработчик даже не подозревал. Но для этого необходимо перейти от эмпирических наблюдений к строгим математическим доказательствам.

Оригинал статьи: https://arxiv.org/pdf/2601.16175.pdf

Связаться с автором: https://www.linkedin.com/in/avetisyan/

Смотрите также:

- БИТКОИН ПРОГНОЗ. BTC криптовалюта

- ПРОГНОЗ ДОЛЛАРА К ШЕКЕЛЮ

- ЭФИРИУМ ПРОГНОЗ. ETH криптовалюта

- MYX ПРОГНОЗ. MYX криптовалюта

- SOL ПРОГНОЗ. SOL криптовалюта

- SAROS ПРОГНОЗ. SAROS криптовалюта

- РИППЛ ПРОГНОЗ. XRP криптовалюта

- ДОГЕКОИН ПРОГНОЗ. DOGE криптовалюта

- ZEC ПРОГНОЗ. ZEC криптовалюта

- FARTCOIN ПРОГНОЗ. FARTCOIN криптовалюта

2026-01-23 10:47