Автор: Денис Аветисян

Новое мобильное приложение делает сложные прогнозы риска развития диабета понятными для пользователей благодаря упрощенным визуализациям и объяснениям на естественном языке.

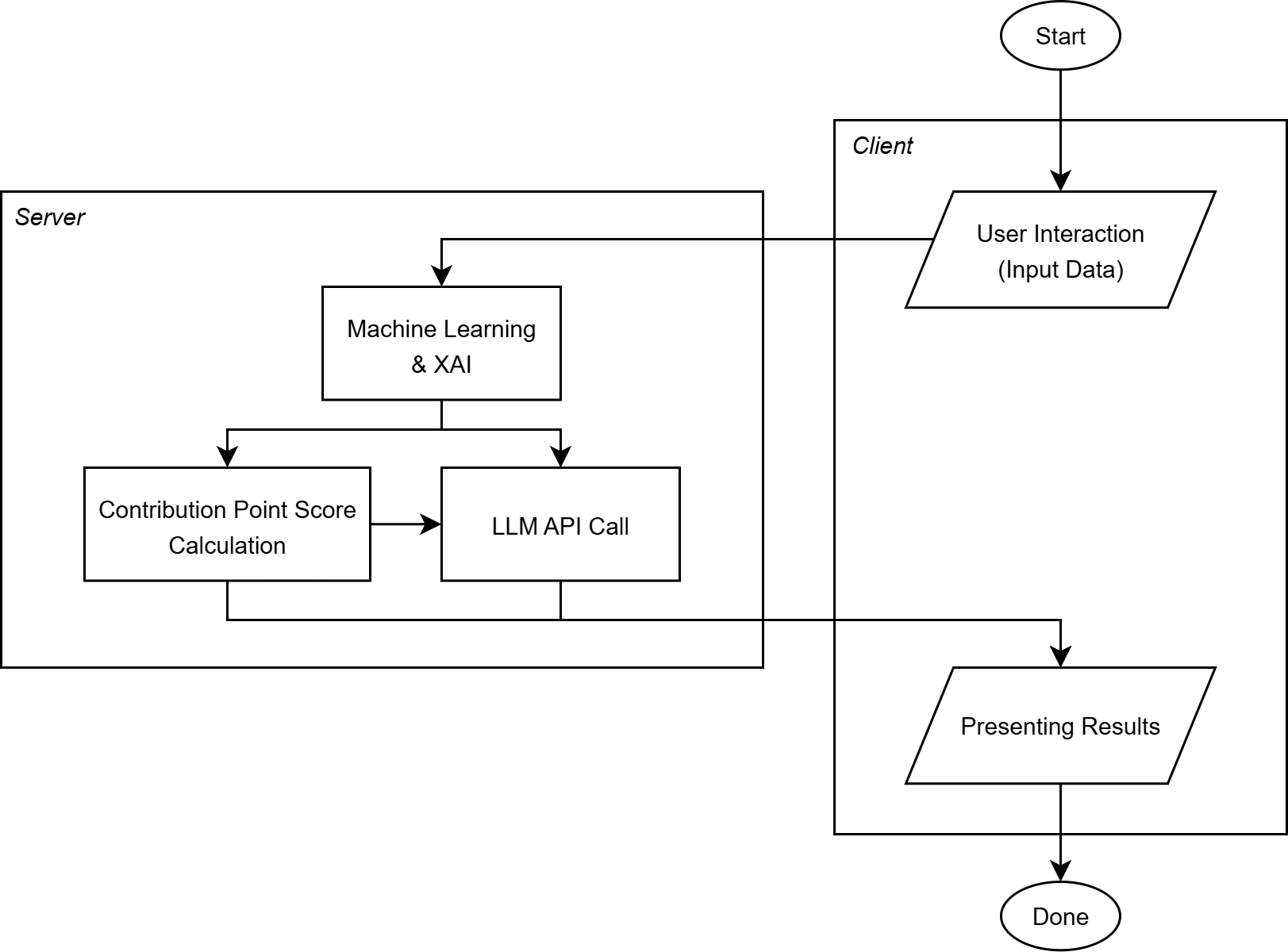

Разработан мобильный интерфейс для представления результатов машинного обучения, использующего методы Explainable AI (XAI) и SHAP-значения для оценки риска диабета.

Несмотря на растущую популярность искусственного интеллекта в здравоохранении, многие системы остаются “черными ящиками”, затрудняя понимание причин принимаемых решений. В данной работе, посвященной разработке мобильного приложения ‘A Mobile Application Front-End for Presenting Explainable AI Results in Diabetes Risk Estimation’, представлен подход к визуализации результатов анализа рисков диабета, основанный на методах объяснимого ИИ (XAI). Разработанный интерфейс, использующий графики и текстовые пояснения, генерируемые с помощью больших языковых моделей, позволяет пользователям понимать вклад отдельных факторов риска в прогноз. Способствует ли такое представление информации повышению осведомленности и мотивации к профилактике диабета, и какие перспективы открываются для применения подобных решений в других областях медицины?

Раскрывая Чёрный Ящик: Диабет и Искусственный Интеллект

В Индонезии диабет приобретает масштабы национальной проблемы здравоохранения, оказывая значительное давление на систему медицинского обслуживания и социально-экономическое благополучие населения. Рост заболеваемости, обусловленный рядом факторов, включая изменения в образе жизни, питание и генетическую предрасположенность, требует немедленного и эффективного вмешательства. Неконтролируемый диабет приводит к серьезным осложнениям, таким как сердечно-сосудистые заболевания, почечная недостаточность, слепота и ампутации конечностей, что значительно увеличивает нагрузку на ресурсы здравоохранения и снижает качество жизни пациентов. Разработка и внедрение инновационных решений для управления диабетом, включая передовые технологии и стратегии профилактики, являются критически важными для смягчения последствий этого растущего кризиса и обеспечения здоровья будущих поколений.

Современные приложения искусственного интеллекта, предназначенные для управления диабетом, такие как DiabTrend, зачастую функционируют как «черные ящики», не предоставляя информации о логике, лежащей в основе их прогнозов. Это отсутствие прозрачности представляет собой серьезное препятствие для доверия со стороны как медицинских работников, так и пациентов. Когда алгоритм выдает рекомендации без объяснения причин, врачам сложно оценить их обоснованность и интегрировать в клиническую практику. Пациенты, в свою очередь, могут испытывать неуверенность и нежелание следовать советам, если не понимают, как они были получены. В результате, даже самые точные предсказания могут оставаться невостребованными, снижая эффективность лечения и усугубляя проблему растущей заболеваемости диабетом.

Отсутствие прозрачности в работе алгоритмов искусственного интеллекта, применяемых для управления диабетом, серьезно препятствует их внедрению в клиническую практику и вовлечению пациентов в процесс лечения. Если врач или пациент не понимает, на основании каких факторов и логических цепочек система делает те или иные прогнозы или рекомендации, доверие к ней существенно снижается. Это приводит к тому, что даже самые точные алгоритмы остаются невостребованными, поскольку специалисты предпочитают полагаться на проверенные методы диагностики и лечения. Возникает потребность в разработке так называемого «объяснимого искусственного интеллекта» (XAI), который способен не только выдавать результат, но и предоставлять четкое и понятное обоснование принятых решений, тем самым повышая эффективность и безопасность лечения диабета.

Для преодоления существующих ограничений в управлении диабетом требуется переход к технологиям Объяснимого Искусственного Интеллекта (XAI). Вместо непрозрачных предсказаний, XAI позволяет понять, какие именно факторы повлияли на конкретный вывод, предоставляя врачам и пациентам возможность оценить обоснованность рекомендаций. Это не только повышает доверие к системам поддержки принятия решений, но и способствует более активному участию пациента в процессе лечения, поскольку он получает ясное представление о логике, лежащей в основе предложенных стратегий. Внедрение XAI открывает путь к персонализированной медицине, где решения принимаются совместно человеком и машиной, основываясь на прозрачном понимании данных и алгоритмов, что, в свою очередь, ведет к более эффективному и осознанному управлению заболеванием.

Освещая Предсказания: Методы XAI в Действии

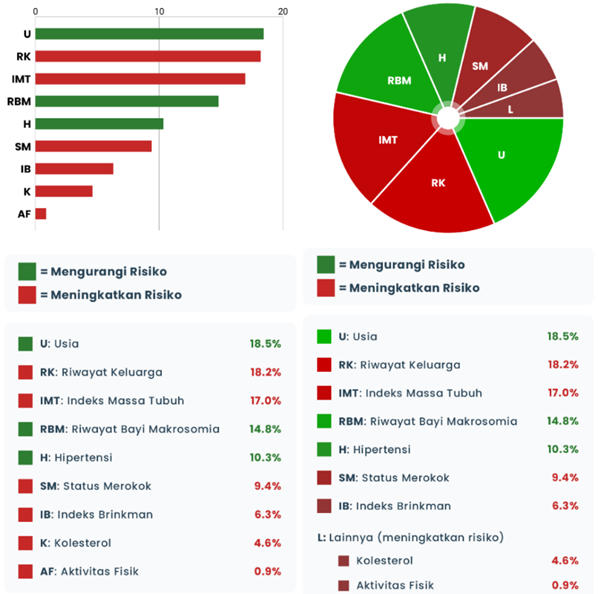

Для анализа сложных предсказаний моделей машинного обучения применяются методы объяснимого ИИ (XAI), такие как SHAP (SHapley Additive exPlanations) и LIME (Local Interpretable Model-agnostic Explanations). Эти методы позволяют разложить общее предсказание на вклады отдельных признаков, определяя их количественный вклад в итоговый результат. SHAP, основанный на теории игр, вычисляет вклады признаков, распределяя “выигрыш” (разницу между предсказанием и средним значением) между признаками. LIME, в свою очередь, аппроксимирует поведение сложной модели локально, вокруг конкретного экземпляра данных, используя интерпретируемую модель (например, линейную регрессию) для оценки важности признаков в этой локальной области. Оба подхода позволяют понять, какие признаки наиболее существенно влияют на каждое конкретное предсказание модели.

Методы, такие как SHAP и LIME, обеспечивают локальные объяснения для каждого отдельного предсказания модели машинного обучения. Вместо глобального понимания всей модели, эти методы анализируют вклад каждой входной характеристики (признака) в конкретное предсказание. В результате, определяется, какие признаки оказали наибольшее влияние на полученный результат, и в какой степени. Это позволяет выявить ключевые факторы, определяющие поведение модели в каждом конкретном случае, и предоставляет возможность более детального анализа и интерпретации её решений.

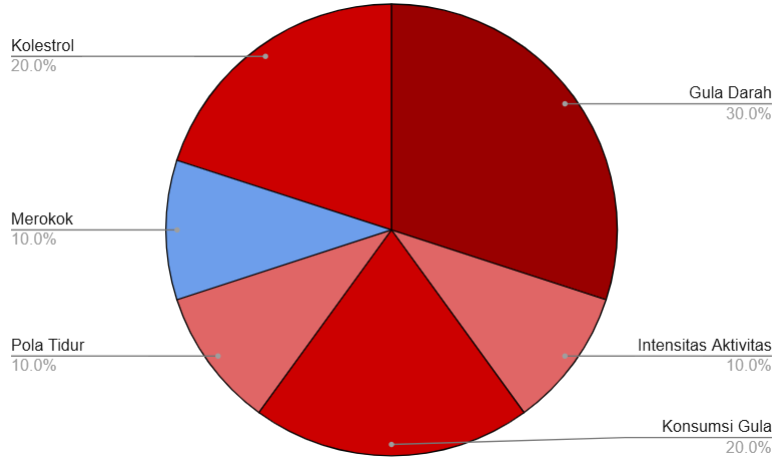

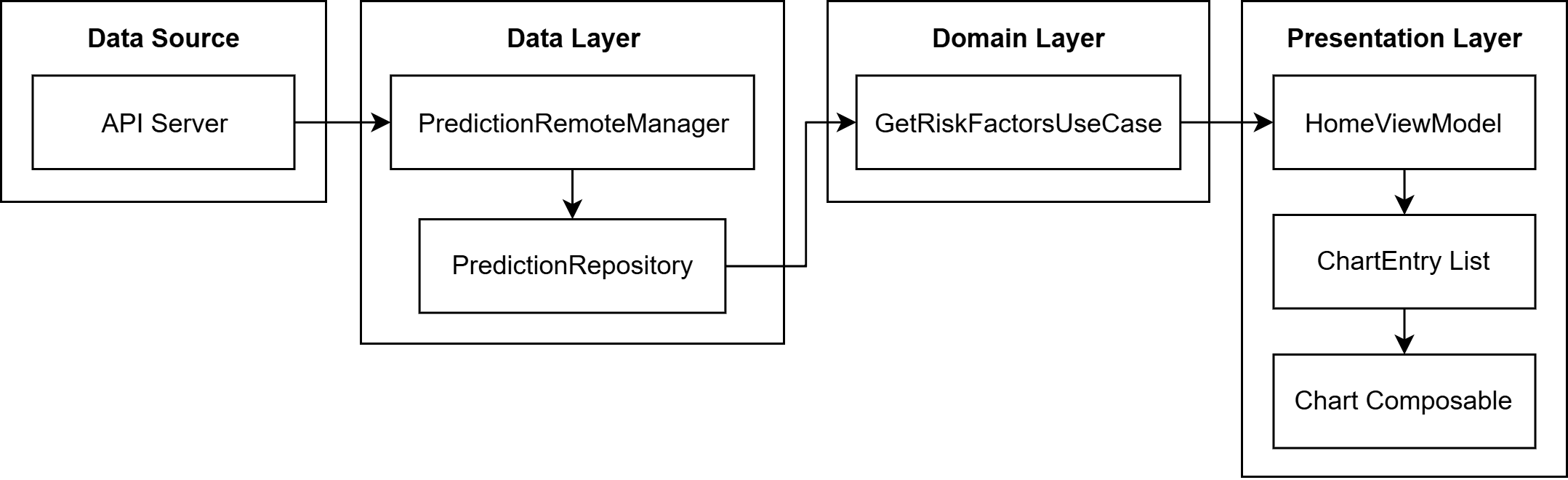

Необработанные результаты, полученные с помощью методов объяснимого искусственного интеллекта (XAI), таких как SHAP и LIME, часто представляют собой наборы числовых значений или сложных таблиц, которые трудно интерпретировать для пользователей, не обладающих специальными знаниями в области машинного обучения и статистики. Для эффективного анализа и понимания влияния отдельных признаков на предсказания модели, требуется применение методов визуализации данных. Эти методы позволяют преобразовать технические результаты XAI в более понятные и доступные форматы, такие как графики, диаграммы и тепловые карты, облегчая процесс выявления ключевых факторов, определяющих поведение модели и повышая доверие к её решениям.

Визуализация данных играет ключевую роль в интерпретации результатов методов объяснимого искусственного интеллекта (XAI). Непосредственные выходные данные XAI, такие как значения SHAP или LIME, часто представляют собой сложные наборы числовых значений, затруднительные для понимания без специализированных знаний. Эффективные методы визуализации, включая графики влияния признаков, диаграммы рассеяния и тепловые карты, позволяют преобразовать эти данные в наглядные и легко интерпретируемые форматы. Это существенно упрощает процесс анализа, позволяя как экспертам, так и неспециалистам выявлять наиболее значимые факторы, определяющие решения модели, и оценивать ее поведение. Правильно подобранная визуализация данных обеспечивает эффективную коммуникацию результатов XAI и способствует повышению доверия к моделям машинного обучения.

Оптимизируя Ясность: Визуализация для Пользователя

Сложные визуализации, такие как диаграммы водопад (Waterfall Plots) и диаграммы сил (Force Plots), несмотря на свою информативность, могут вызывать когнитивную перегрузку у пользователей, не знакомых с концепциями объяснимого искусственного интеллекта (XAI). Это связано с тем, что интерпретация данных, представленных в этих форматах, требует предварительного понимания принципов их построения и специфики визуализации взаимосвязей. В результате, пользователи без соответствующей подготовки могут испытывать затруднения в извлечении полезной информации и формировании адекватного представления о работе модели, что снижает эффективность использования XAI-инструментов.

При оценке визуализаций для объяснимого ИИ (XAI) было установлено, что более простые типы, такие как столбчатые диаграммы (Bar Charts), круговые диаграммы (Pie Charts) и диаграммы расхождений (Diverging Bar Charts), демонстрируют лучшую интерпретируемость для пользователей. Предпочтения в отношении конкретного типа диаграммы варьируются в зависимости от опыта пользователя: участники с опытом анализа структурированных данных отдавали предпочтение столбчатым диаграммам за их точность и информативность, в то время как пользователи без такой подготовки чаще выбирали круговые диаграммы, ориентируясь на их визуальную привлекательность и общую понятность.

Для реализации визуализаций в Android-приложении используется библиотека MPAndroidChart, разработанная для построения различных типов графиков и диаграмм непосредственно в Android. Разработка ведется в среде Android Studio с использованием языка программирования Kotlin, что обеспечивает высокую производительность и гибкость при работе с данными и пользовательским интерфейсом. Интеграция MPAndroidChart с Kotlin позволяет эффективно отображать результаты XAI-анализа, предоставляя пользователям наглядное представление данных и облегчая их интерпретацию.

Для повышения доступности результатов Explainable AI (XAI) в приложении используется генерация текстовых пояснений на естественном языке с помощью большой языковой модели GPT-4o. Данный подход дополняет визуализацию данных, обеспечивая более полное понимание пользователями полученных результатов. Согласно проведенным оценкам, комбинированное использование визуализаций и текстовых пояснений позволило достичь высокого уровня понимания пользователями — 4.31 из 5.

Обеспечение Надежности: Взгляд в Будущее

Функциональная надёжность является краеугольным камнем доверия пользователей к приложению для управления диабетом. Нестабильная работа или непредсказуемые ошибки способны подорвать уверенность в предоставляемой информации, что особенно критично в сфере здравоохранения. Пользователи должны быть уверены, что приложение всегда функционирует корректно, выдавая точные данные и последовательные рекомендации. Именно поэтому обеспечение безупречной работы всех функций является приоритетной задачей, определяющей восприятие и принятие приложения пациентами и врачами. Доверие к системе — это не просто удобство использования, а основа для эффективного управления заболеванием и принятия обоснованных решений в отношении здоровья.

Для обеспечения стабильной работы и высокого уровня доверия к приложению для управления диабетом, используется автоматизированное сквозное тестирование с помощью фреймворка Espresso. Данный подход позволяет гарантировать предсказуемое и корректное функционирование всех ключевых элементов системы. В ходе тестирования было разработано и автоматизировано 111 сценариев, охватывающих все основные пользовательские сценарии и функциональные возможности приложения. Примечательно, что все эти сценарии успешно пройдены, демонстрируя 100%-ный показатель успешности, что подтверждает высокую надежность и предсказуемость работы приложения в различных ситуациях.

Понимание пользователем и доверие к системе напрямую зависят от её стабильности и надёжности. Исследования показывают, что если приложение для управления диабетом функционирует предсказуемо и безошибочно, пациенты и врачи склонны более внимательно изучать и принимать представленные объяснения и рекомендации. Это особенно важно в контексте медицинских приложений, где точность и последовательность работы критически важны для принятия обоснованных решений. Надёжная система формирует уверенность в достоверности информации, что способствует более эффективному взаимодействию и улучшает результаты лечения.

Сочетание понятности и надежности системы представляет собой ключевой фактор повышения эффективности лечения диабета. Когда пациенты и врачи получают доступ к объяснениям, основанным на стабильно функционирующем приложении, возрастает доверие к предоставляемой информации. Это, в свою очередь, позволяет им принимать обоснованные решения относительно лечения, корректировать терапию и более эффективно управлять заболеванием. Приоритет, отдаваемый как прозрачности алгоритмов, так и безошибочной работе системы, создает условия для более тесного сотрудничества между пациентом и врачом, что является необходимым условием для достижения оптимальных результатов в лечении диабета и улучшения качества жизни пациентов.

Исследование демонстрирует стремление к деконструкции сложной системы — в данном случае, алгоритмов оценки риска диабета — для представления её пользователю в понятной форме. Это созвучно идее, высказанной Дональдом Кнутом: «Прежде чем оптимизировать код, убедитесь, что он работает». Подобно тому, как Кнут призывает к проверке работоспособности перед оптимизацией, данная работа акцентирует важность объяснимости (Explainable AI) прежде, чем внедрять сложные модели. Понимание принципов работы алгоритма, визуализированное через мобильное приложение, позволяет пользователю не просто принять результат, но и оценить его обоснованность, фактически, «взломав» систему для личного контроля над своим здоровьем. Работа демонстрирует, что знание — это своего рода реверс-инжиниринг реальности, где каждый может проверить и понять логику, стоящую за предсказаниями.

Куда Ведет Эта Дорога?

Представленное решение, безусловно, демонстрирует возможность перевода сложной логики искусственного интеллекта в понятный для пользователя формат. Однако, следует признать, что это лишь первый шаг. По сути, мы научили машину говорить на человеческом языке, но не научили пользователя правильно задавать вопросы. Проблема не в интерпретации результатов, а в постановке самой задачи. Следующим этапом видится создание интерактивных систем, способных не только объяснить предсказание, но и выявить факторы риска, над которыми пользователь способен влиять.

Очевидным ограничением является зависимость от качества исходных данных. Любая модель, даже самая “объяснимая”, остается лишь отражением несовершенства реальности. Поэтому, фокус должен сместиться на разработку алгоритмов, способных оценивать достоверность данных и выявлять систематические ошибки. В конце концов, предсказание риска — это лишь повод для дальнейшего исследования, а не окончательный приговор.

Будущее за системами, которые не просто предоставляют информацию, а стимулируют критическое мышление. Приложение, способное не только сказать “у вас повышен риск”, но и спросить “а что вы знаете об этом риске?”, — вот истинная цель. Ведь знание — это не просто обладание фактами, а умение сомневаться и искать истину, даже если она скрыта за сложными алгоритмами.

Оригинал статьи: https://arxiv.org/pdf/2601.15292.pdf

Связаться с автором: https://www.linkedin.com/in/avetisyan/

Смотрите также:

- ПРОГНОЗ ДОЛЛАРА К ШЕКЕЛЮ

- БИТКОИН ПРОГНОЗ. BTC криптовалюта

- MYX ПРОГНОЗ. MYX криптовалюта

- ЭФИРИУМ ПРОГНОЗ. ETH криптовалюта

- SOL ПРОГНОЗ. SOL криптовалюта

- ПРОГНОЗ ДОЛЛАРА К ЗЛОТОМУ

- ДОГЕКОИН ПРОГНОЗ. DOGE криптовалюта

- Золото прогноз

- SAROS ПРОГНОЗ. SAROS криптовалюта

- ПРОГНОЗ ЕВРО К ШЕКЕЛЮ

2026-01-24 16:56