Автор: Денис Аветисян

Исследователи разработали метод, позволяющий надежно обнаруживать видео, сгенерированные искусственным интеллектом, даже если они выглядят реалистично.

Новая система MPF-Net анализирует мельчайшие отклонения в структуре и временной последовательности кадров для выявления признаков искусственного происхождения.

Несмотря на стремительное повышение реалистичности синтезированного видео, современные методы обнаружения подделок зачастую оказываются неэффективными. В данной работе, ‘MPF-Net: Exposing High-Fidelity AI-Generated Video Forgeries via Hierarchical Manifold Deviation and Micro-Temporal Fluctuations’, предложен новый подход, основанный на анализе так называемых «флуктуаций проекции на многообразие» (Manifold Projection Fluctuations — MPF), присущих остаточным изображениям, генерируемым нейронными сетями. Разработанная система выявляет синтетический контент, анализируя отклонения от естественного многообразия и микро-временные флуктуации, даже в визуально безупречных последовательностях. Позволит ли данный подход создать надежный инструмент для криминалистического анализа видео и эффективно противостоять распространению дезинформации?

Разоблачение Синтетических Видео: Вызов Подлинности в Эпоху ИИ

В последние годы наблюдается стремительное развитие моделей искусственного интеллекта, способных генерировать видеоролики с беспрецедентным уровнем реалистичности, таких как Sora2, Veo и Wan. Это создает серьезную проблему для определения подлинности видеоконтента, поскольку традиционные методы криминалистической экспертизы становятся все менее эффективными против столь продвинутых генераторов. Размытие границ между реальностью и симуляцией представляет собой вызов для экспертов, журналистов и широкой общественности, требуя разработки новых подходов к верификации и обнаружению синтетических видеоматериалов. Появление этих технологий поднимает важные вопросы о доверии к визуальной информации и потенциальном влиянии на общественное мнение.

Традиционные методы криминалистической экспертизы цифровых медиа, ранее эффективные в выявлении подделок, сегодня оказываются все менее применимыми к контенту, созданному передовыми генеративными моделями, такими как Sora2, Veo и Wan. Эти модели способны создавать видеоролики с поразительной реалистичностью, стирая границы между аутентичным и синтетическим. Устаревшие подходы, основанные на анализе артефактов сжатия или метаданных, оказываются бессильными перед сложными алгоритмами, имитирующими естественные процессы и тщательно скрывающими следы своего происхождения. В связи с этим, возникает острая необходимость в разработке принципиально новых стратегий обнаружения, использующих, например, анализ неявных статистических закономерностей, обнаружение несоответствий в физической симуляции или применение методов машинного обучения, обученных на выявлении тонких признаков, указывающих на искусственное происхождение контента. Успешное решение этой задачи критически важно для сохранения доверия к цифровой информации и предотвращения распространения дезинформации.

Увеличение реалистичности синтетических медиа, создаваемых современными алгоритмами, несет в себе серьезные риски для информационной безопасности и общественного доверия. Распространение убедительных, но ложных видеороликов может дестабилизировать политическую обстановку, манипулировать общественным мнением и даже спровоцировать социальные конфликты. Поддельные доказательства, представленные в виде видео, могут быть использованы для дискредитации отдельных лиц или организаций, а также для вмешательства в выборы. Утрата доверия к визуальному контенту в целом подрывает основы журналистики, судебной системы и научных исследований, создавая благоприятную среду для распространения дезинформации и теорий заговора. В связи с этим, разработка эффективных методов обнаружения синтетических медиа становится критически важной задачей, требующей совместных усилий ученых, разработчиков и политиков.

Двухэтапная Рамка: Иерархический Подход к Обнаружению Подделок

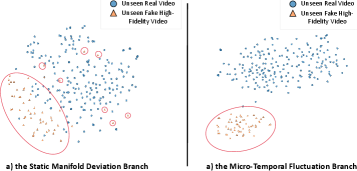

Предлагаемый нами подход к обнаружению поддельных видео использует двухэтапный процесс. На первом этапе оценивается общая достоверность видеопотока, определяющая, насколько он соответствует распределению реальных видеозаписей. В случае выявления значительных отклонений на этом этапе, видео отбрасывается, что позволяет существенно снизить вычислительную нагрузку. Второй этап посвящен детальному анализу микро-темпоральных флуктуаций в оставшихся видео, направленному на выявление более тонких признаков манипуляции, которые могли не быть обнаружены на первом этапе.

Статическая ветвь отклонения от многообразия использует масштабные визуальные фундаментальные модели (VFMs), такие как PE Core и MetaCLIP-v2, для идентификации видеоматериалов, выходящих за пределы распределения реальных видеозаписей. Этот процесс позволяет с точностью 97% отсеивать «off-manifold» образцы, то есть видео, не соответствующие статистическим характеристикам реального мира. Использование VFMs обеспечивает эффективное обнаружение аномалий, основанное на извлечении признаков и сравнении с распределением данных, полученных из реальных видеозаписей.

Предварительная фильтрация, осуществляемая первым этапом системы, позволяет эффективно отсеивать значительное количество синтетических видеороликов, существенно снижая вычислительную нагрузку на последующий этап анализа. Это достигается за счет использования моделей VFM (Large-Scale Vision Foundation Models) для идентификации видеоматериалов, выходящих за рамки распределения реальных записей, что позволяет сократить объем данных, требующих более детальной проработки. В результате, ресурсы направляются на анализ наиболее вероятных случаев манипуляций, повышая общую эффективность и скорость работы системы.

Раскрытие Микро-Временных Артефактов: Мощность Анализа MPF

Ветвь микро-темпоральных флуктуаций специализируется на анализе манифольд-проекционных флуктуаций (MPF), представляющих собой присущие непоследовательности во временной структуре видео, сгенерированных искусственным интеллектом. Данные флуктуации возникают как следствие особенностей алгоритмов генерации и проявляются в виде микроскопических отклонений от естественной последовательности кадров. Анализ MPF позволяет выявить эти отклонения, основываясь на предположении, что искусственно сгенерированные видео демонстрируют статистически иные характеристики временной когерентности по сравнению с видео, полученными в результате реальной съёмки. Выявление и количественная оценка MPF является ключевым элементом в определении происхождения видеоконтента и, как следствие, в обнаружении признаков его искусственной генерации.

Для извлечения и количественной оценки микро-временных артефактов в видео, генерируемых ИИ, используются методы оптического потока, частотного анализа и рекуррентных нейронных сетей LSTM. Оптический поток позволяет отслеживать движение объектов между кадрами, выявляя несогласованности, которые могут указывать на искусственное происхождение видео. Частотный анализ выявляет аномалии в спектральном составе изображения, связанные с манипуляциями, характерными для генеративных моделей. LSTM-сети, в свою очередь, позволяют учитывать временную последовательность кадров и обнаруживать несоответствия в динамике, которые могут быть не видны при анализе отдельных кадров. Комбинация этих методов обеспечивает комплексный подход к выявлению и количественной оценке тонких артефактов, присущих видео, сгенерированным искусственным интеллектом.

Анализ остатков кадров (Frame Residuals) и нормализованных остатков является ключевым этапом в выявлении несоответствий в движении и текстуре, характерных для видео, сгенерированных искусственным интеллектом. Остатки кадров, представляющие собой разницу между последовательными кадрами после применения алгоритмов оптического потока, позволяют обнаружить аномалии в траекториях движения объектов. Нормализация этих остатков, учитывающая вариации в яркости и контрастности, повышает чувствительность к более тонким несоответствиям. Комбинированное использование этих методов позволяет выявить “отпечаток пальца” ИИ-генерации, проявляющийся в виде статистических аномалий и паттернов, не свойственных реальным видеозаписям.

Использование моделей Temporal Transformer позволяет учитывать долгосрочные временные зависимости в видеопоследовательности, что существенно повышает точность обнаружения микро-временных артефактов. В ходе тестирования, разработанная система демонстрирует высокую точность детекции, подтвержденную сильной положительной корреляцией между результатами анализа и оценкой качества видео. Особая эффективность отмечается при анализе начальных кадров, которые часто оказываются наиболее уязвимыми для проявления артефактов, генерируемых алгоритмами искусственного интеллекта.

Комплексная Оценка и Перспективы Развития AIGC Форензики

Комбинация проверки достоверности и анализа микро-паттернов подделок (MPF) представляет собой надежный и эффективный подход к выявлению видео, сгенерированных искусственным интеллектом. Данный метод позволяет значительно повысить точность обнаружения, минимизируя количество ложных срабатываний. Проверка достоверности изначально отсеивает грубые подделки, фокусируясь на видео, требующих более детального анализа. Затем, анализ MPF выявляет тонкие артефакты и несоответствия, характерные для AI-генерации, которые часто остаются незамеченными для других методов. Такой двухступенчатый подход не только улучшает общую производительность, но и обеспечивает более устойчивые результаты, особенно при работе с видео высокого качества, где обнаружение подделок представляет наибольшую сложность.

Для всесторонней оценки подлинности видеоматериалов разработана комплексная оценка качества, учитывающая ключевые технические параметры, такие как частота кадров (FPS), битрейт и пространственное разрешение. Этот подход позволяет выйти за рамки анализа отдельных артефактов, характерных для сгенерированных ИИ видео, и сформировать целостное представление о степени манипуляций. Комплексная оценка качества функционирует как индикатор общей “естественности” видео, поскольку видео, созданное или значительно отредактированное ИИ, часто демонстрирует отклонения в этих параметрах по сравнению с видео, полученными традиционными способами. Использование нескольких метрик в совокупности значительно повышает надежность детекции, снижая вероятность ложных срабатываний и обеспечивая более точную идентификацию подделок.

Данная работа демонстрирует передовые результаты в обнаружении поддельных видеороликов, созданных искусственным интеллектом, на общедоступном бенчмарке GenVideo. Предложенный подход превосходит существующие методы, особенно в идентификации высококачественных, реалистичных подделок, созданных с использованием современных генеративных моделей — так называемых “on-manifold” фальсификаций. Это достигнуто за счет комбинации тщательной проверки достоверности и анализа манипуляций с частотой кадров, что позволяет более эффективно выявлять следы искусственного вмешательства, даже в сложных и правдоподобных видеоматериалах. Полученные результаты открывают новые возможности для борьбы с дезинформацией и укрепления доверия к цифровому контенту.

В дальнейшем, исследования будут направлены на адаптацию разработанной системы к обнаружению все более совершенных генеративных моделей искусственного интеллекта. Особое внимание уделяется способности системы распознавать манипуляции, созданные новейшими алгоритмами, которые способны создавать видеоматериалы, практически неотличимые от реальных. Помимо видео, планируется расширение функциональности фреймворка для анализа других модальностей данных, в частности, аудио. Это позволит проводить комплексную проверку подлинности мультимедийного контента и эффективно противодействовать распространению дезинформации, созданной с использованием искусственного интеллекта, а также обеспечит более надежную идентификацию подделок в различных форматах.

Представленная работа имеет далеко идущие последствия в борьбе с дезинформацией, поскольку позволяет достоверно определять происхождение видеоматериалов и выявлять подделки, созданные с помощью искусственного интеллекта. Это, в свою очередь, способствует укреплению доверия к цифровому контенту, что особенно важно в эпоху распространения фальсификаций. Разработанный подход не только повышает способность к обнаружению подделок, но и стимулирует ответственное развитие технологий искусственного интеллекта, подчеркивая необходимость создания инструментов, которые можно эффективно контролировать и использовать во благо общества. Повышение прозрачности в сфере создания и распространения цифрового контента, достигаемое благодаря подобным исследованиям, является ключевым фактором для сохранения информационной безопасности и формирования здорового информационного пространства.

Исследование, представленное в данной работе, демонстрирует стремление к математической чистоте в области анализа видеоданных. Авторы предлагают подход, основанный на выявлении отклонений в многообразиях (Manifold Projection Fluctuations), что позволяет выявлять синтетический контент с высокой точностью. В этом контексте уместно вспомнить слова Дэвида Марра: «Любая вычислительная система должна быть построена на четких и однозначных принципах». Подобно тому, как математическая строгость является основой для корректности алгоритма, так и выявление нестыковок во временной последовательности и остаточных изображениях становится ключевым критерием для определения подлинности видеоматериалов. Подход, описанный в статье, стремится к доказательству корректности выявления подделок, а не просто к достижению высокой производительности на тестовых данных.

Что Дальше?

Представленная работа, выявляя флуктуации на многообразиях остатков (MPF) в сгенерированном ИИ видео, открывает путь к более изящным методам обнаружения подделок. Однако, стоит признать, что сама природа «реальности», которую стремится уловить данный подход, подвержена собственным флуктуациям. Идеальной симметрии не существует, и любое решение, претендующее на абсолютную точность, обречено на несовершенство. Вопрос не в том, чтобы создать детектор, который безошибочно отличает синтетическое от настоящего, а в том, чтобы создать систему, способную оценивать степень отклонения от ожидаемой гармонии.

Дальнейшие исследования должны быть направлены на понимание устойчивости MPF к различным видам манипуляций и сжатиям. Необходимо исследовать, как эти флуктуации взаимодействуют с другими артефактами, возникающими в процессе генерации и обработки видео, и как можно использовать эти взаимодействия для повышения надежности обнаружения. Особый интерес представляет разработка метрик, позволяющих количественно оценить степень «неестественности» видео, а не просто бинарно классифицировать его как «подлинное» или «поддельное».

В конечном счете, истинный прогресс в этой области будет достигнут не за счет создания более сложных алгоритмов, а за счет более глубокого понимания фундаментальных принципов, лежащих в основе как реального, так и синтетического видео. Поиск элегантности в математической чистоте остаётся приоритетной задачей, ведь только доказанный алгоритм имеет ценность, а не просто работающий на тестовых примерах.

Оригинал статьи: https://arxiv.org/pdf/2601.21408.pdf

Связаться с автором: https://www.linkedin.com/in/avetisyan/

Смотрите также:

- БИТКОИН ПРОГНОЗ. BTC криптовалюта

- ПРОГНОЗ ДОЛЛАРА К ШЕКЕЛЮ

- ЭФИРИУМ ПРОГНОЗ. ETH криптовалюта

- MYX ПРОГНОЗ. MYX криптовалюта

- SAROS ПРОГНОЗ. SAROS криптовалюта

- SOL ПРОГНОЗ. SOL криптовалюта

- SIREN ПРОГНОЗ. SIREN криптовалюта

- ДОГЕКОИН ПРОГНОЗ. DOGE криптовалюта

- ПРОГНОЗ ДОЛЛАРА

- ZEC ПРОГНОЗ. ZEC криптовалюта

2026-01-31 19:05