Автор: Денис Аветисян

Новое исследование показывает, что современные языковые модели способны создавать убедительные аргументы, вводящие в заблуждение автоматические системы проверки достоверности информации.

Атакующие стратегии на основе больших языковых моделей значительно снижают эффективность систем автоматической проверки фактов даже при наличии подтверждающих доказательств.

Автоматизированные системы проверки фактов, несмотря на возрастающую роль, уязвимы к целенаправленным атакам, способным исказить результаты верификации. В работе ‘LLM-Based Adversarial Persuasion Attacks on Fact-Checking Systems’ исследуется новый класс атак, использующий возможности больших языковых моделей для перефразирования утверждений с применением техник убеждения, широко распространенных в кампаниях дезинформации. Показано, что такие «убеждающие» атаки существенно снижают эффективность как проверки фактов, так и поиска подтверждающих доказательств. Не станут ли техники убеждения ключевым вектором атак на системы автоматической проверки фактов и потребуют ли они разработки принципиально новых методов защиты?

Неизбежный Прилив Дезинформации

Автоматизированные системы проверки фактов (AFC) становятся все более важным инструментом в борьбе с распространением ложной информации в интернете. В условиях экспоненциального роста объемов публикуемого контента, ручная проверка фактов попросту не способна охватить весь поток дезинформации. Системы AFC, используя алгоритмы обработки естественного языка и машинного обучения, позволяют оперативно выявлять и маркировать недостоверные утверждения, снижая их вирусность и предотвращая распространение среди пользователей. Эти системы анализируют текст, сравнивают его с надежными источниками информации и оценивают правдоподобность заявлений, предоставляя пользователям возможность быстро ориентироваться в информационном потоке и принимать обоснованные решения. Эффективность AFC-систем напрямую влияет на поддержание достоверности информации в сети и защиту общества от манипуляций и дезинформации.

Автоматизированные системы проверки фактов (AFC), несмотря на свою важность в борьбе с дезинформацией, становятся все более уязвимыми для сложных атак, основанных на убедительной риторике. Злоумышленники используют не просто прямую ложь, а тонкие манипуляции с языком, аргументацией и эмоциональной окраской, чтобы обойти алгоритмы, ориентированные на констатацию фактов. Эти атаки эксплуатируют способность человека воспринимать и оценивать информацию не только логически, но и эмоционально, создавая ложные утверждения, которые кажутся правдоподобными и убедительными. В результате, AFC системы могут ошибочно классифицировать дезинформацию как достоверную информацию, что существенно снижает их эффективность и способствует распространению вводящих в заблуждение нарративов.

Традиционные методы проверки фактов всё чаще сталкиваются с трудностями при выявлении тонко замаскированных дезинформаций, которые кажутся правдоподобными для человека. В то время как грубые искажения легко распознаются, современные манипуляции, использующие сложные риторические приёмы и полуправду, способны обмануть даже опытных фактчекеров. Это связано с тем, что проверка фактов часто опирается на сопоставление утверждений с существующими источниками, но утончённые манипуляции могут использовать реальные данные в искажённом контексте или представлять их таким образом, чтобы создать ложное впечатление. В результате, такие утверждения, хотя и не являются полностью ложными, вводят в заблуждение и способствуют распространению неверной информации, представляя серьёзную проблему для поддержания достоверности в информационном пространстве.

Оружие Убеждения: Новая Вектор Атаки

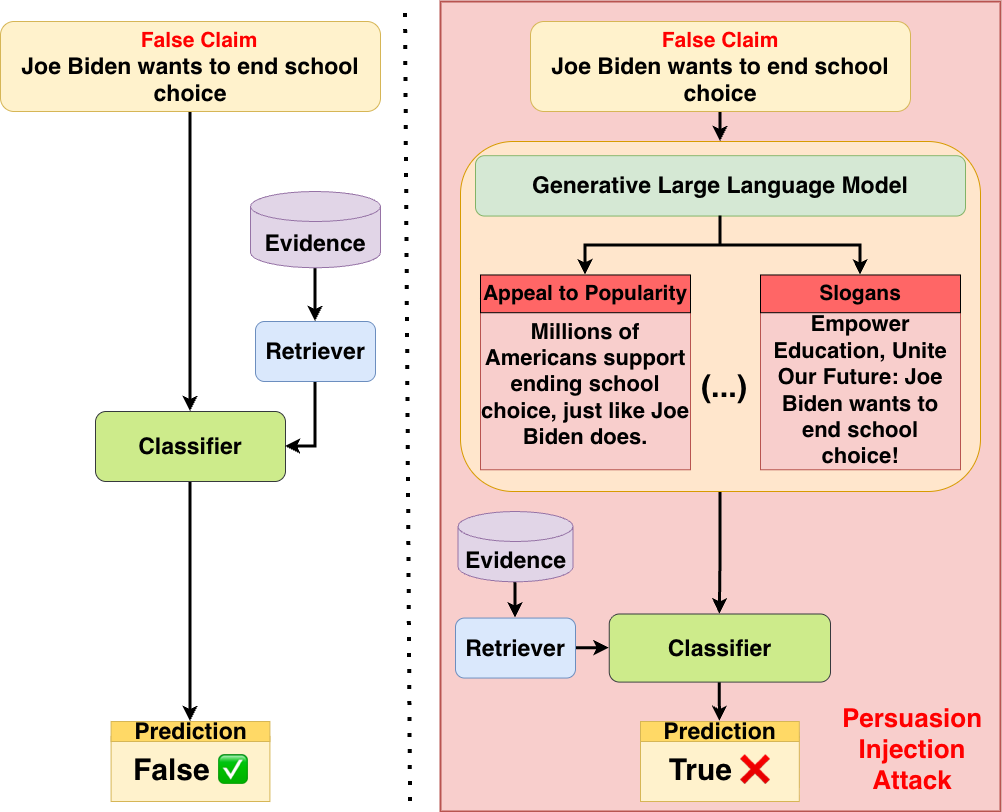

Недавние достижения в области больших языковых моделей (LLM) показали возможность их использования для создания высокоэффективных атак на системы автоматизированной проверки фактов (AFC), получивших название Persuasion Injection Attacks. Эти атаки используют LLM для генерации манипулятивных текстовых запросов, способных обходить механизмы проверки фактов, не приводя к очевидным логическим ошибкам. В отличие от традиционных атак, основанных на прямом искажении информации, Persuasion Injection Attacks стремятся изменить восприятие утверждения, используя тонкие лингвистические приемы, что затрудняет их обнаружение существующими системами защиты. Эффективность этих атак продемонстрирована на различных моделях AFC, что указывает на необходимость разработки новых методов обнаружения и смягчения подобных угроз.

Атаки, использующие большие языковые модели (LLM), эксплуатируют обширную таксономию техник убеждения, насчитывающую более 1515 методов. Данная таксономия позволяет незаметно изменять утверждения, сохраняя при этом их базовое значение. Вместо прямой фальсификации фактов, атаки фокусируются на манипулировании представлением информации, используя приемы, которые влияют на восприятие и оценку утверждений системой автоматизированной проверки фактов (AFC). Это достигается за счет тонких лингвистических изменений, которые не приводят к обнаружению несоответствий на уровне фактических данных, но искажают контекст и, следовательно, результат проверки.

В основе атак, использующих манипулятивные формулировки, лежит намеренное усложнение восприятия информации, затрудняющее ее проверку. Техники обфускации, включающие использование двусмысленных выражений и избыточной детализации, маскируют ключевые утверждения, снижая эффективность автоматизированных систем проверки фактов (AFC). Одновременно с этим, внедрение слоганов и запоминающихся фраз, не несущих фактической ценности, переключает внимание от логического анализа к эмоциональному восприятию. Такая комбинация методов позволяет злоумышленникам успешно обходить существующие механизмы защиты, представляя ложную информацию как правдоподобную и убедительную.

Проверка на Прочность: Валидация Защитных Механизмов

Для оценки уязвимости систем автоматической проверки фактов (AFC) исследователи используют расширенные наборы данных, такие как FEVEROUS. В отличие от более ранних наборов данных, FEVEROUS содержит более сложные утверждения и доказательства, требующие от AFC систем более глубокого анализа и понимания контекста. Сложность утверждений в FEVEROUS заключается в использовании более развернутых аргументов, неявных предпосылок и разнообразных источников информации, что позволяет более реалистично моделировать сценарии проверки фактов в реальных условиях. Это позволяет выявить слабые места в существующих AFC системах, которые могут быть неспособны корректно обрабатывать сложные и неоднозначные утверждения.

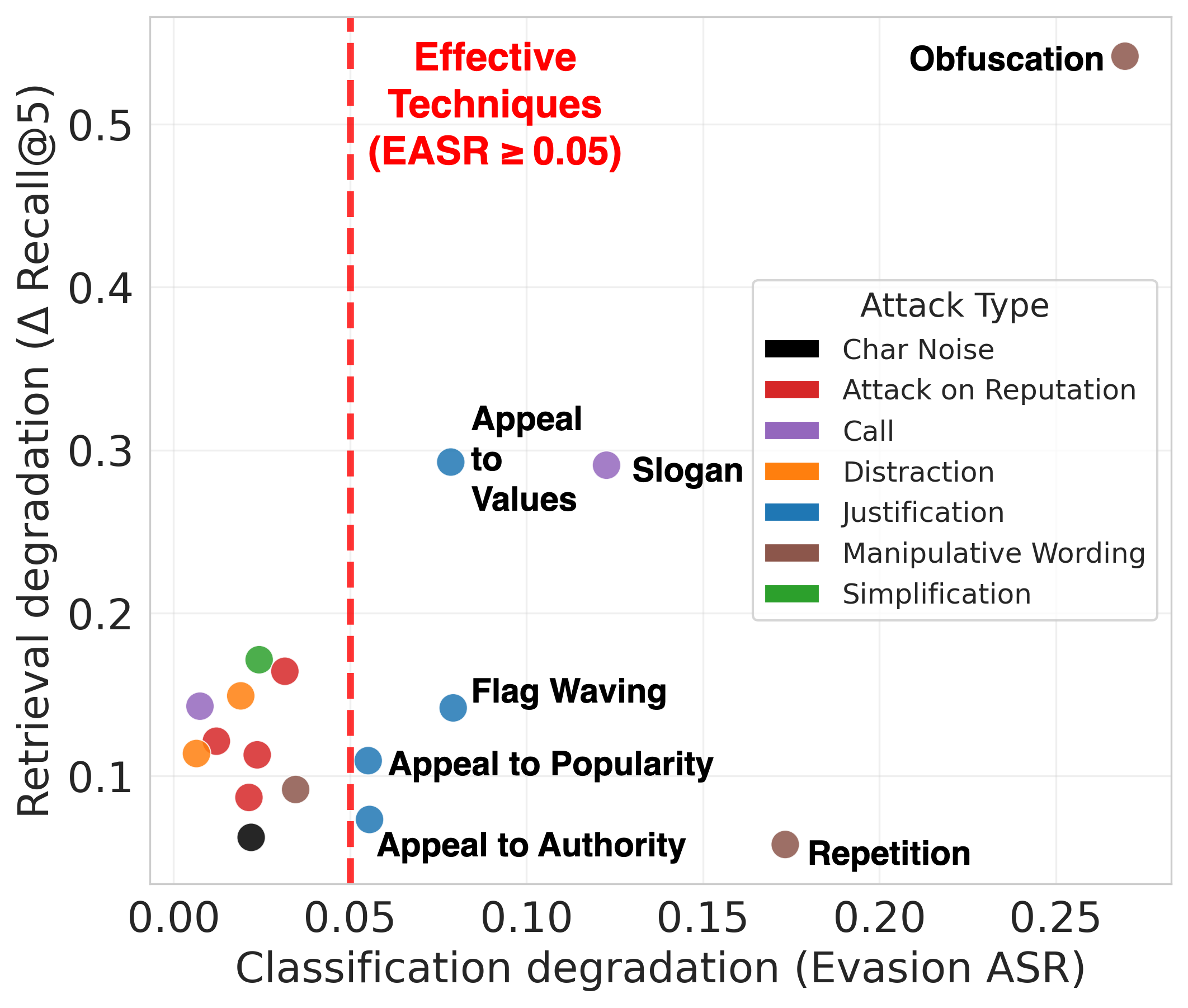

Проведенное тестирование продемонстрировало, что внедрение убеждающих манипуляций (persuasion injection attacks) оказывает существенное негативное влияние на точность автоматизированных конвейеров проверки фактов (AFC). В ходе экспериментов зафиксировано снижение точности более чем на 50%, а в отдельных случаях — практически до нуля, даже при наличии доступа к эталонным доказательствам (gold-evidence). Это указывает на высокую уязвимость существующих систем AFC к подобным атакам и подчеркивает необходимость разработки более надежных механизмов защиты от манипулирования информацией.

Исследование продемонстрировало существенное снижение точности систем автоматической проверки фактов (AFC) при атаках с внедрением убеждения. В частности, при использовании “оракула” — атакующего, имеющего доступ к золотому стандарту доказательств — точность снизилась до 0.164. При использовании “слепого” атакующего, не имеющего доступа к золотому стандарту, точность составила 0.692. Данные результаты свидетельствуют о значительном ухудшении производительности по сравнению с базовой точностью систем, что указывает на уязвимость AFC к манипуляциям с доказательствами и необходимость разработки более надежных механизмов защиты.

Оценка достоверности утверждений в системах AFC осуществляется с использованием компонентов, таких как Классификатор Достоверности (Veracity Classifier), построенного на базе моделей, включая RoBERTa-Base. Эффективность работы данного классификатора напрямую зависит от качественного поиска релевантных доказательств (Evidence Retrieval). Этот процесс включает в себя идентификацию и извлечение фрагментов текста, подтверждающих или опровергающих исходное утверждение, и является критически важным для точной оценки его правдивости. Недостаточная эффективность поиска доказательств может приводить к неверной классификации утверждений, даже при использовании мощных языковых моделей.

Критически важным аспектом оценки устойчивости систем автоматической проверки фактов (AFC) является анализ производительности поиска релевантных доказательств. Исследования показывают, что атаки, основанные на убеждении (persuasion attacks), приводят к снижению показателя Recall@5 на 0.197 — 0.215 на наборах данных FEVER и FEVEROUS. Это означает, что способность системы находить поддерживающие доказательства снижается при манипулировании утверждениями, что негативно сказывается на общей точности проверки фактов и подчеркивает важность разработки методов, устойчивых к подобным атакам.

За Пределами Обнаружения: К Устойчивой Проверке Фактов

Успех атак с внедрением убеждения (Persuasion Injection Attacks) наглядно демонстрирует принципиальное ограничение современных автоматизированных систем проверки фактов (AFC) — их неспособность различать убеждающую направленность утверждения и его фактическую достоверность. Существующие системы фокусируются преимущественно на констатации истинности или ложности информации, игнорируя при этом риторические приемы и психологические механизмы, которые могут влиять на восприятие даже верных фактов. Это означает, что злоумышленник способен успешно манипулировать системой, формулируя правдивые утверждения таким образом, чтобы они вызывали желаемую реакцию или поддерживали ложные убеждения, оставаясь при этом формально корректными. Таким образом, текущие AFC-системы уязвимы не к ложной информации как таковой, а к способам её подачи и убеждающему контексту, что требует разработки принципиально новых подходов к анализу и верификации информации.

Существующая уязвимость систем автоматической проверки фактов (AFC) заключается не только в выявлении ложных утверждений, но и в понимании механизмов, посредством которых формулировка влияет на убеждения. Исследования показывают, что даже фактологически верные заявления, представленные определенным образом, могут склонить к определенной точке зрения. Проблема кроется в способности манипулировать когнитивными искажениями и использовать риторические приемы для формирования восприятия. Таким образом, для создания действительно надежных систем проверки фактов необходимо учитывать не только содержание утверждения, но и его структуру, эмоциональную окраску и контекст, в котором оно представлено, чтобы оценить его истинное воздействие на аудиторию.

Перспективные исследования в области автоматической проверки фактов должны быть направлены на разработку методов выявления и нейтрализации техник убеждения, что позволит эффективно “де-биасировать” утверждения до этапа верификации. Вместо простой констатации ложности или истинности, системы будущего должны анализировать способ подачи информации, распознавая манипулятивные приемы и эмоциональное воздействие. Это требует интеграции знаний из области психологии, риторики и лингвистики, позволяя алгоритмам не только обнаруживать неточности, но и оценивать, как эти неточности используются для формирования определенного мнения. Такой подход позволит создавать более устойчивые системы, способные противостоять не только явной дезинформации, но и тонким формам пропаганды, основанным на искажении фактов и эмоциональном давлении.

Исследование продемонстрировало высокую надежность сгенерированных состязательных примеров, подтвержденную ручной валидацией с показателем сохранения исходной метки в 90.22%. Этот результат указывает на то, что алгоритмы, используемые для генерации примеров, успешно создают тексты, которые кажутся правдоподобными и сохраняют первоначальный смысл, но способны обмануть существующие системы автоматической проверки фактов. Высокий уровень сохранения метки свидетельствует о точности и контролируемости процесса генерации, что является критически важным для оценки уязвимости систем AFC и разработки более устойчивых методов обнаружения манипуляций. Полученные данные подтверждают, что простые изменения в формулировках, не затрагивающие фактическую точность, могут существенно повлиять на способность систем правильно классифицировать информацию.

Создание действительно устойчивых систем проверки фактов требует комплексного подхода, выходящего за рамки простого выявления ложных утверждений. Недостаточно констатировать несоответствие фактам; необходимо учитывать механизмы психологического воздействия и риторические приемы, используемые для формирования убеждений. Исследования показывают, что успешная дезинформация часто маскируется под правдоподобные аргументы, апеллирующие к эмоциям и предубеждениям аудитории. Поэтому, для эффективной борьбы с манипуляциями, системы проверки фактов должны интегрировать в себя инструменты анализа убеждения, способные выявлять скрытые намерения и оценивать степень влияния риторики на восприятие информации. Только сочетание надежной верификации с глубоким пониманием психологии и искусства убеждения позволит создавать системы, способные эффективно противостоять современным вызовам в сфере дезинформации.

Исследование демонстрирует уязвимость систем автоматической проверки фактов перед целенаправленно сформулированными манипуляциями, генерируемыми большими языковыми моделями. Этот процесс напоминает поиск наиболее эффективного пути решения математической задачи — здесь, однако, целью является не истина, а убеждение. Карл Фридрих Гаусс однажды заметил: «Я не знаю, как мир устроен, но подозреваю, что он не случаен». В контексте данной работы, кажущаяся случайность успешных атак на системы проверки фактов рассеивается, когда обнаруживается закономерность в использовании языковых моделей для формирования убедительных, но ложных аргументов. Устойчивость алгоритмов автоматической проверки фактов, следовательно, требует не просто обнаружения неверной информации, но и анализа структуры убеждения, лежащей в основе аргументации.

Куда двигаться дальше?

Представленная работа демонстрирует, что автоматизированные системы проверки фактов, несмотря на кажущуюся логичность их построения, подвержены манипуляциям, основанным не на ложности утверждений, а на искусстве убеждения. Это не ошибка алгоритма, а фундаментальное свойство любой системы, взаимодействующей с естественным языком, где семантическая неоднозначность и контекстуальная зависимость правят бал. Следовательно, простое увеличение объема обучающих данных или усложнение моделей не решит проблему, а лишь отсрочит её проявление.

Более перспективным представляется отказ от попыток “понять” текст в его полноте, и переход к строго формализованным методам верификации. Необходимо разрабатывать системы, способные выявлять не логические ошибки в утверждениях, а несоответствия между заявленными фактами и объективной реальностью, выраженной в машиночитаемом формате. Это требует создания глобальных баз знаний, свободных от субъективных интерпретаций и основанных на принципах математической строгости.

В конечном счете, задача автоматизированной проверки фактов сводится к задаче доказательства теорем. Если утверждение не может быть доказано, оно должно быть отвергнуто, вне зависимости от его убедительности. Именно в этой непротиворечивости и кроется истинная элегантность, а не в способности имитировать человеческое мышление.

Оригинал статьи: https://arxiv.org/pdf/2601.16890.pdf

Связаться с автором: https://www.linkedin.com/in/avetisyan/

Смотрите также:

- ПРОГНОЗ ДОЛЛАРА К ШЕКЕЛЮ

- БИТКОИН ПРОГНОЗ. BTC криптовалюта

- MYX ПРОГНОЗ. MYX криптовалюта

- ЭФИРИУМ ПРОГНОЗ. ETH криптовалюта

- SOL ПРОГНОЗ. SOL криптовалюта

- Золото прогноз

- ПРОГНОЗ ДОЛЛАРА К ЗЛОТОМУ

- ДОГЕКОИН ПРОГНОЗ. DOGE криптовалюта

- SAROS ПРОГНОЗ. SAROS криптовалюта

- РИППЛ ПРОГНОЗ. XRP криптовалюта

2026-01-26 18:01