Автор: Денис Аветисян

Обзор посвящен применению методов искусственного интеллекта для обнаружения вторжений и анализа криптографических утечек, а также анализу их уязвимости к изменениям данных и целенаправленным атакам.

Исследование показывает, что эффективность моделей искусственного интеллекта в области кибербезопасности существенно снижается при изменении распределения данных и под воздействием атак, требуя разработки устойчивых и адаптивных решений.

Несмотря на растущую роль искусственного интеллекта в обеспечении кибербезопасности, его устойчивость к изменяющимся условиям остается под вопросом. В работе ‘Understanding AI Methods for Intrusion Detection and Cryptographic Leakage’ исследуется применение методов машинного обучения для обнаружения вредоносной сетевой активности и выявления утечек информации в криптографических реализациях. Полученные результаты демонстрируют высокую точность обнаружения в стабильных сетевых средах, однако производительность снижается при столкновении с новыми или изменёнными паттернами трафика, а также выявляют признаки утечек по сторонним каналам. Каким образом можно разработать более адаптивные и устойчивые модели ИИ для эффективной защиты от современных киберугроз?

Современные Угрозы в Цифровом Пространстве: Эволюция и Масштаб

Современная цифровая инфраструктура подвергается непрекращающимся и всё более изощрённым атакам. Киберпреступники постоянно разрабатывают новые методы проникновения, используя уязвимости в программном обеспечении, социальной инженерии и сетевых протоколах. От простых фишинговых кампаний до сложных атак программ-вымогателей и целевых атак на критически важные объекты, угрозы становятся сложнее и труднее обнаруживаются. Эти атаки не только приводят к финансовым потерям и нарушению конфиденциальности данных, но и могут парализовать работу целых организаций и даже целых государств. Постоянное совершенствование тактик злоумышленников требует от специалистов по кибербезопасности непрерывного обучения и внедрения передовых технологий защиты.

Традиционные методы обнаружения угроз, такие как сигнатурный анализ и статическое обнаружение вредоносного кода, все чаще оказываются неэффективными перед лицом современных кибератак. Злоумышленники активно используют полиморфные и метаморфные вредоносные программы, способные изменять свой код, чтобы избежать обнаружения, а также новые векторы атак, эксплуатирующие уязвимости в сложных сетевых системах и приложениях. Это требует перехода к более адаптивным и интеллектуальным системам защиты, способным анализировать поведение программ и сетевой трафик в реальном времени, выявляя аномалии и потенциальные угрозы, даже если они не соответствуют известным сигнатурам. Неспособность быстро адаптироваться к этим изменениям создает серьезные риски для безопасности цифровой инфраструктуры и данных.

Современные цифровые сети генерируют колоссальные объемы данных, представляющие собой сложнейший поток информации. Этот непрерывный и стремительно растущий трафик создает серьезные трудности для оперативной и точной идентификации угроз безопасности. Анализ такого объема данных в режиме реального времени требует не только значительных вычислительных мощностей, но и применения передовых алгоритмов машинного обучения, способных отфильтровать полезный трафик от вредоносной активности. Традиционные методы, основанные на сигнатурном анализе, оказываются неэффективными, поскольку злоумышленники активно используют методы обфускации и полиморфизма, маскируя свои действия под легитимный сетевой трафик. В результате, даже незначительные аномалии могут оставаться незамеченными в огромном потоке данных, создавая благоприятную среду для проникновения и распространения киберугроз.

Искусственный Интеллект: Новый Рубеж в Защите от Вторжений

Искусственный интеллект (ИИ) и, в частности, машинное обучение (МО) предоставляют мощные инструменты для автоматизации анализа угроз и обнаружения вторжений. Традиционные методы, основанные на заранее заданных правилах и сигнатурах, требуют постоянного обновления и часто неэффективны против новых, ранее неизвестных атак. МО-алгоритмы, напротив, способны обучаться на больших объемах данных, выявлять закономерности и аномалии, что позволяет обнаруживать угрозы с большей скоростью и точностью, не требуя постоянного вмешательства человека. Автоматизация процессов анализа с помощью МО снижает нагрузку на специалистов по информационной безопасности и позволяет им сосредоточиться на более сложных задачах, требующих экспертной оценки.

Алгоритмы машинного обучения (МО) позволяют выявлять вредоносную активность с большей точностью и скоростью по сравнению с традиционными системами, основанными на правилах. В отличие от ручного определения сигнатур и паттернов, МО анализирует большие объемы данных для выявления статистических аномалий и корреляций, указывающих на потенциальные угрозы. Этот подход позволяет обнаруживать ранее неизвестные типы атак (zero-day exploits) и адаптироваться к изменяющимся тактикам злоумышленников. Вместо жестко заданных критериев, МО формирует модель поведения, что снижает количество ложных срабатываний и повышает эффективность обнаружения реальных угроз. Скорость анализа данных обеспечивается параллельной обработкой и оптимизированными алгоритмами, что особенно важно при обработке сетевого трафика в реальном времени.

Глубокое обучение, являясь подмножеством машинного обучения, значительно расширяет возможности обнаружения угроз за счет использования сложных нейронных сетей. Эти сети состоят из множества взаимосвязанных слоев, позволяющих им анализировать данные на различных уровнях абстракции и выявлять тонкие аномалии, которые могут указывать на вредоносную активность. В отличие от традиционных методов, основанных на заранее определенных правилах, глубокое обучение способно самостоятельно извлекать признаки из данных и адаптироваться к новым типам атак, что повышает эффективность обнаружения и снижает количество ложных срабатываний. Способность к автоматическому извлечению признаков особенно важна при анализе сложных данных, таких как сетевой трафик или исполняемый код, где ручное определение признаков затруднительно и требует значительных усилий.

Технологии искусственного интеллекта и машинного обучения находят широкое применение в системах классификации вредоносного ПО, анализа угроз и, что критически важно, в системах обнаружения вторжений. В системах классификации вредоносного ПО алгоритмы машинного обучения анализируют характеристики файлов и кода для автоматического определения типа и семейства вредоносной программы. При анализе угроз эти технологии позволяют автоматизировать процесс выявления и оценки потенциальных опасностей, значительно сокращая время реагирования. В системах обнаружения вторжений (IDS/IPS) машинное обучение используется для выявления аномального сетевого трафика и поведения, указывающего на потенциальные атаки, что позволяет оперативно блокировать угрозы и минимизировать ущерб.

Проверка на Прочность: Уязвимости и Методы Обхода Систем Защиты

Атакующие могут намеренно создавать вредоносные входные данные, предназначенные для обхода систем безопасности, основанных на машинном обучении, используя методы, известные как состязательные атаки. Один из таких методов — манипуляция признаками, заключающаяся в незначительных, но целенаправленных изменениях входных данных, которые не влияют на их функциональное назначение, но приводят к неправильной классификации моделью. Эти манипуляции могут быть направлены на наиболее значимые признаки, используемые моделью для принятия решений, что позволяет злоумышленнику обмануть систему обнаружения вторжений. Например, изменение порядка пакетов, небольшое изменение длины пакета или добавление случайного шума в определенные поля заголовка могут привести к тому, что вредоносный трафик будет ошибочно идентифицирован как нормальный.

Смещение распределения данных, заключающееся в изменении характеристик атакующих данных с течением времени, оказывает существенное влияние на производительность обученных моделей. Изначально обученные на определенном наборе данных, системы обнаружения вторжений демонстрируют снижение эффективности при столкновении с атаками, отличающимися по своим параметрам от тех, на которых они обучались. Это связано с тем, что модели, как правило, оптимизированы для распознавания паттернов, представленных в обучающей выборке, и менее эффективно реагируют на новые, ранее не встречавшиеся типы атак. Наблюдаемое снижение точности обнаружения до приблизительно 70% при использовании смещенных тестовых данных подтверждает значимость учета динамики атакующих данных при разработке и развертывании систем защиты на основе машинного обучения.

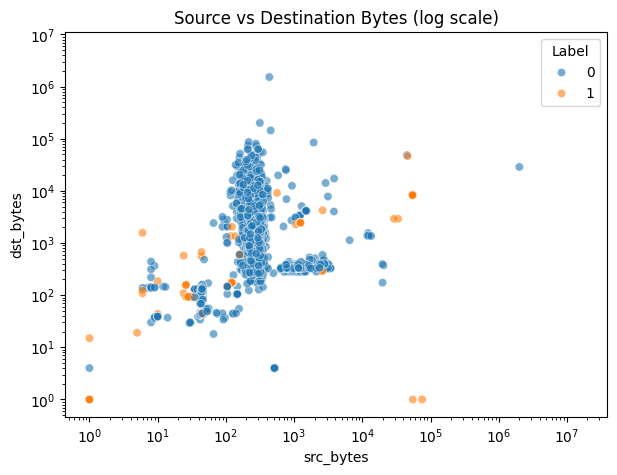

Для валидации и повышения устойчивости моделей машинного обучения в сфере сетевой безопасности часто используются наборы данных, имитирующие реальный сетевой трафик, такие как NSL-KDD и CIC-IDS. NSL-KDD является улучшенной версией оригинального KDD Cup 99, разработанной для решения проблем с несбалансированностью классов и избыточностью данных. CIC-IDS, в свою очередь, предоставляет более современные и реалистичные данные, включающие разнообразные типы атак, отражающие текущие угрозы. Эти наборы данных позволяют исследователям оценить способность моделей к обнаружению вторжений в контролируемых условиях и выявить потенциальные уязвимости перед развертыванием в производственной среде. Они также служат основой для разработки и тестирования новых методов защиты от атак.

Обучение с состязательными примерами (Adversarial Learning) представляет собой метод повышения устойчивости моделей машинного обучения к атакам, направленным на обход систем обнаружения вторжений. Суть подхода заключается в расширении обучающей выборки специально созданными, слегка модифицированными входными данными — состязательными примерами. Эти примеры, внешне похожие на легитимные, способны обмануть стандартно обученную модель, но при включении их в процесс обучения позволяют модели научиться распознавать и правильно классифицировать даже такие замаскированные атаки, тем самым повышая ее устойчивость к новым, ранее неизвестным, техникам обхода.

Наши исследования показали, что системы обнаружения вторжений, основанные на искусственном интеллекте, демонстрируют базовое значение Precision-Recall Area Under the Curve (PR-AUC) в 0.9983 в контролируемых условиях. Однако, при атаках, производительность существенно снижается. В частности, PR-AUC падает до 0.6148 при манипуляции с пятью наиболее важными признаками, до 0.5790 при манипуляции с десятью признаками, и до 0.6307 при манипуляции с двадцатью признаками. Данные результаты свидетельствуют о значительной уязвимости современных AI-систем обнаружения вторжений к атакам, направленным на искажение входных данных.

В ходе тестирования на смещенных данных обнаружено, что точность обнаружения угроз снижается до приблизительно 70%. Манипуляции с признаками привели к пропуску более 41 000 атак. Данный результат демонстрирует значительную уязвимость систем обнаружения вторжений, основанных на машинном обучении, к изменениям в распределении данных и целенаправленным атакам, направленным на искажение входных данных, что подчеркивает необходимость разработки более устойчивых алгоритмов и методов обучения.

Анализ Побочных Каналов: Уязвимость Физической Реализации Криптографии

Анализ по сторонним каналам (Side-Channel Analysis, SCA) представляет собой метод извлечения конфиденциальной информации из криптографических систем, основанный на использовании физических характеристик их реализации. Вместо того чтобы искать уязвимости в самом алгоритме шифрования, SCA эксплуатирует такие параметры, как энергопотребление, электромагнитное излучение, время выполнения и даже звуковые волны, возникающие в процессе работы устройства. Эти физические проявления, хотя и кажутся незначительными, напрямую связаны с обрабатываемыми данными и могут содержать ценную информацию о секретных ключах или других конфиденциальных данных. Таким образом, даже математически стойкие криптосистемы могут быть взломаны посредством анализа их физической реализации, подчеркивая важность защиты от атак по сторонним каналам на аппаратном и программном уровнях.

Анализ потребления мощности, как один из методов побочного-канального анализа, основывается на измерении незначительных колебаний энергопотребления во время выполнения криптографических операций. Суть этого подхода заключается в том, что количество потребляемой энергии связано с обрабатываемыми данными: например, переключение битов с 0 на 1 требует определенной энергии. Особое внимание уделяется концепции «веса Хэмминга» — количеству установленных битов в двоичном слове. Чем больше битов переключаются во время операции, тем заметнее изменение потребляемой мощности, которое и фиксируется. Таким образом, анализируя эти слабые сигналы, злоумышленник может восстановить информацию о ключе или других конфиденциальных данных, даже если сам криптографический алгоритм математически надежен.

Атаки по сторонним каналам представляют серьезную угрозу для криптографических алгоритмов, таких как AES, ECC и Diffie-Hellman, даже если сами алгоритмы математически надежны. Суть проблемы заключается в том, что физическая реализация криптографии, а не математическая модель, становится уязвимой точкой. Например, незначительные колебания энергопотребления или электромагнитного излучения во время выполнения операций шифрования могут содержать информацию о секретном ключе. Эти утечки, кажущиеся незначительными, могут быть зафиксированы и проанализированы злоумышленником, позволяя восстановить ключ и взломать шифрование. Таким образом, даже идеально разработанный алгоритм оказывается бессильным перед атаками, направленными на его физическое воплощение, что подчеркивает необходимость комплексных мер защиты, учитывающих как математическую, так и физическую безопасность криптографических систем.

Для разработки и оценки эффективности систем защиты на основе искусственного интеллекта против атак по сторонним каналам, критически важны специализированные наборы данных, такие как SCA Dataset. Эти коллекции содержат замеры физических характеристик криптографических устройств во время выполнения операций, например, потребляемой мощности или электромагнитного излучения. Доступность структурированных и размеченных данных позволяет исследователям обучать алгоритмы машинного обучения для выявления аномалий и паттернов, указывающих на утечку информации. Использование таких наборов данных способствует созданию более надежных и устойчивых к взлому криптографических систем, позволяя тестировать и совершенствовать методы противодействия атакам, основанным на анализе физической реализации, и оценивать их эффективность в реалистичных условиях.

Анализ атак по сторонним каналам показал, что достижение точности классификации в 50% является вполне реальным сценарием, что свидетельствует о частичной утечке информации из криптографических систем. Этот результат подчеркивает уязвимость даже тех реализаций, алгоритмы которых математически надежны. Несмотря на то, что полная компрометация ключа не происходит, возможность получения половины информации о ключе представляет собой серьезную угрозу безопасности. Такой уровень утечки позволяет злоумышленнику значительно сократить пространство поиска ключа и повысить вероятность успешной атаки, что требует разработки эффективных контрмер и методов защиты от атак по сторонним каналам даже в тех случаях, когда криптографические алгоритмы сами по себе не содержат уязвимостей.

Исследование, представленное в статье, подчеркивает уязвимость систем обнаружения вторжений и анализа утечек информации, основанных на искусственном интеллекте, к изменениям в распределении данных и целенаправленным манипуляциям. Это особенно актуально, учитывая, что надежность алгоритмов напрямую зависит от их способности к адаптации и устойчивости. Кен Томпсон однажды заметил: «Оптимизация без анализа — это самообман и ловушка для неосторожного разработчика». Данное высказывание прекрасно иллюстрирует необходимость тщательного анализа данных и алгоритмов, применяемых в системах безопасности, прежде чем полагаться на их эффективность. Без глубокого понимания потенциальных угроз и способов их обхода, даже самые сложные модели машинного обучения могут оказаться бесполезными перед лицом адаптирующегося противника.

Что Дальше?

Представленные результаты, хотя и демонстрируют потенциал методов искусственного интеллекта в области сетевой безопасности и анализа утечек, обнажают фундаментальную проблему: алгоритмическая «элегантность» не гарантирует устойчивости. Доказательство корректности модели на ограниченном наборе данных — иллюзия, если не учитывать неизбежные сдвиги в распределении данных и преднамеренные манипуляции со стороны атакующих. Необходимо признать, что «работает на тестах» — это не доказательство, а лишь временное облегчение.

Будущие исследования должны быть сосредоточены на разработке алгоритмов, способных к адаптации и самообучению в условиях меняющейся среды. Особое внимание следует уделить формальной верификации моделей и разработке метрик, оценивающих не только точность, но и робастность к различным видам атак. Необходимо перейти от эмпирических наблюдений к строгим математическим доказательствам, подтверждающим устойчивость алгоритмов к искажениям входных данных.

В конечном итоге, истинный прогресс в области применения искусственного интеллекта в кибербезопасности требует не просто создания более сложных моделей, а разработки принципиально новых подходов, основанных на глубоком понимании математических основ как алгоритмов машинного обучения, так и атак, которым они подвержены. Иначе, останется лишь красивая, но хрупкая иллюзия безопасности.

Оригинал статьи: https://arxiv.org/pdf/2603.25826.pdf

Связаться с автором: https://www.linkedin.com/in/avetisyan/

Смотрите также:

- БИТКОИН ПРОГНОЗ. BTC криптовалюта

- ПРОГНОЗ ДОЛЛАРА К ШЕКЕЛЮ

- ЭФИРИУМ ПРОГНОЗ. ETH криптовалюта

- MYX ПРОГНОЗ. MYX криптовалюта

- SAROS ПРОГНОЗ. SAROS криптовалюта

- SOL ПРОГНОЗ. SOL криптовалюта

- SIREN ПРОГНОЗ. SIREN криптовалюта

- ДОГЕКОИН ПРОГНОЗ. DOGE криптовалюта

- ПРОГНОЗ ДОЛЛАРА

- ZEC ПРОГНОЗ. ZEC криптовалюта

2026-03-30 06:16