Автор: Денис Аветисян

Исследователи представили AdvSynGNN — инновационную структуру графовых нейронных сетей, способную эффективно справляться со сложными и неоднородными графами реального мира.

AdvSynGNN использует состязательное обучение, структурное кодирование и адаптивную передачу информации для повышения устойчивости и масштабируемости графовых нейронных сетей.

Несмотря на значительный прогресс, графовые нейронные сети (ГНС) остаются уязвимыми к шуму в структуре графа и несовпадению признаков соседних узлов. В данной работе представлена архитектура ‘AdvSynGNN: Structure-Adaptive Graph Neural Nets via Adversarial Synthesis and Self-Corrective Propagation’, предназначенная для повышения устойчивости и масштабируемости ГНС в реальных условиях. Ключевой идеей является интеграция состязательного синтеза структур, адаптивной простракции и коррекции меток для формирования робастных представлений узлов. Способна ли предложенная архитектура обеспечить надежную работу ГНС в задачах, требующих обработки сложных и зашумленных графовых данных?

Хрупкость Графового Обучения: Суть Проблемы

Несмотря на впечатляющую мощь графовых нейронных сетей, реальные графы, с которыми они сталкиваются, зачастую далеки от идеала. На практике, данные о связях между объектами могут быть неполными или содержать ошибки, а атрибуты узлов — шум и неточности. Такая «загрязненность» информации приводит к снижению надежности прогнозов, поскольку модели, обученные на чистых данных, оказываются уязвимы к неточностям в реальных графах. Неполнота связей может привести к неправильной интерпретации взаимосвязей, а неточные атрибуты — к ошибочным выводам о свойствах объектов. В результате, даже небольшие отклонения в структуре или данных графа могут существенно повлиять на качество предсказаний, ограничивая возможности практического применения графовых нейронных сетей в динамичных и неструктурированных средах.

Традиционные графовые нейронные сети (GNN) демонстрируют уязвимость даже при незначительных изменениях в структуре графа или данных о его узлах, что существенно ограничивает их применение в динамически меняющихся средах. Исследования показывают, что небольшие возмущения, такие как добавление или удаление связей, или даже небольшие погрешности в атрибутах узлов, могут привести к резкому снижению точности прогнозов. Эта чувствительность обусловлена тем, что стандартные GNN предполагают неизменность топологии графа и распределения признаков как во время обучения, так и во время применения. В результате, модели, успешно работающие на статических графах, оказываются неэффективными в реальных сценариях, где структура и данные постоянно эволюционируют, что подчеркивает необходимость разработки более устойчивых и адаптивных методов графового обучения.

Чувствительность графовых нейронных сетей (GNN) к изменениям в данных обусловлена фундаментальным предположением о неизменности структуры графа и распределения признаков на этапах обучения и применения. В процессе обучения GNN адаптируются к конкретному графу, формируя представления узлов и связей, основанные на его топологии и характеристиках. Однако, при развертывании в реальных условиях, графы часто претерпевают изменения — добавляются или удаляются узлы и связи, изменяются значения признаков. Если эти изменения не учитываются, модель, обученная на «статичном» графе, может давать неточные или ненадежные прогнозы, поскольку её представления, сформированные в процессе обучения, становятся нерелевантными для нового, измененного графа. Таким образом, несоответствие между предположениями модели и реальной динамикой графа является ключевым фактором, ограничивающим её устойчивость и практическую применимость.

Реализация полного потенциала обучения на графах в практических приложениях напрямую зависит от преодоления их уязвимости к шуму и неполноте данных. Неспособность графовых нейронных сетей (GNN) стабильно функционировать в условиях незначительных изменений структуры графа или характеристик узлов существенно ограничивает их применение в динамичных и реальных сценариях. Разработка методов, повышающих устойчивость GNN к возмущениям, не просто академическая задача, а необходимое условие для внедрения этих мощных моделей в критически важные области, такие как прогнозирование социальных сетей, обнаружение мошенничества, разработка лекарств и управление инфраструктурой. Успешное решение данной проблемы откроет путь к созданию более надежных и адаптивных систем, способных эффективно функционировать в условиях неопределенности и изменчивости реального мира.

Состязательная Пропагация: Гарантия Устойчивости

Метод Adversarial Propagation предполагает внесение целенаправленного структурного шума в обучающие данные графовых нейронных сетей. Этот шум моделирует потенциальные искажения в структуре графа, возникающие в реальных условиях. Вводя такие возмущения в процессе обучения, модель вынуждена учиться выделять устойчивые признаки, не зависящие от незначительных изменений в структуре графа. В результате, модель становится менее чувствительной к враждебным атакам, основанным на манипулировании структурой графа, и демонстрирует повышенную обобщающую способность на зашумленных или неполных графах.

Метод Adversarial Propagation использует моделирование реальных возмущений графовой структуры для выявления уязвимостей в обучении моделей машинного обучения. Вводя контролируемые искажения в данные во время тренировки, техника позволяет модели «увидеть» потенциальные недостатки и адаптироваться к ним. Это достигается путем имитации типичных ошибок или неточностей, которые могут возникнуть в реальных графовых данных, таких как пропущенные связи, шумные атрибуты или неверные метки. В результате модель обучается не только на чистых данных, но и на их модифицированных версиях, что способствует развитию более устойчивых и надежных признаков, менее подверженных влиянию реальных помех и неточностей.

Для обеспечения стабильности при обучении с использованием состязательных методов и предотвращения коллапса мод используются такие техники, как Gradient Penalty и Wasserstein Distance. Gradient Penalty, применяемый в генеративных состязательных сетях (GAN), наказывает за большие градиенты нормы дискриминатора по отношению к входным данным, стабилизируя процесс обучения и предотвращая исчезновение градиентов. Wasserstein Distance, также известная как Earth Mover’s Distance, позволяет оценивать расстояние между распределениями вероятностей, даже если они не перекрываются, что особенно полезно при обучении GAN. Использование Wasserstein Distance в качестве функции потерь обеспечивает более плавный градиент и способствует более стабильному обучению, предотвращая ситуации, когда генератор застревает в узком диапазоне выходных данных, что приводит к коллапсу мод. W(P_r, P_g) обозначает расстояние Вассерштейна между реальным распределением данных P_r и распределением, генерируемым моделью P_g.

Традиционно, обучение моделей на графах предполагает принятие структуры графа как данного, неизменного условия. Метод Adversarial Propagation принципиально меняет этот подход, переходя от пассивного принятия структуры графа к активной защите от её потенциальных недостатков и уязвимостей. Вместо того чтобы рассматривать граф как идеальную основу для обучения, данный метод рассматривает его как подверженную воздействию среду, в которой необходимо разрабатывать устойчивые представления. Это достигается путем намеренного внесения структурных возмущений в граф во время обучения, что вынуждает модель адаптироваться и научиться игнорировать или компенсировать эти несовершенства, тем самым повышая её надежность и устойчивость к атакам.

Адаптивная Калибровка и Гетерофилия: Преодоление Ограничений

Механизм адаптивной калибровки сигнала (Adaptive Signal Calibration) регулирует величину остаточной коррекции, обеспечивая стабильность обучения даже при существенных изменениях в структуре графа. Этот процесс динамически масштабирует вклад остаточных связей, предотвращая переполнение или затухание сигнала в процессе обратного распространения ошибки. Регулировка осуществляется на основе анализа изменений в структуре графа, что позволяет модели адаптироваться к новым соединениям или удалениям узлов без потери производительности. В результате, даже при значительных структурных изменениях, обучение остается стабильным и эффективным, что особенно важно для динамических графов и задач, где структура графа не является фиксированной.

Механизм адаптивной калибровки сигнала использует концепцию распространяемых остатков (Propagated Residuals) для предотвращения накопления ошибок при обучении. Остатки, представляющие собой разницу между предсказаниями и фактическими значениями, распространяются по графу, позволяя корректировать ошибки на каждом слое. Одновременно с этим, применяется спектральный контроль (Spectral Control), ограничивающий величину собственных значений матрицы смежности графа. Это гарантирует стабильность процесса обучения и предотвращает взрыв или затухание сигналов, поддерживая целостность информации, передаваемой между узлами графа, даже при наличии структурных изменений или шумов.

Традиционные графовые нейронные сети (GNN) часто демонстрируют снижение производительности на графах, характеризующихся гетерофилией — ситуацией, когда смежные узлы имеют различные признаки и свойства. Эта проблема возникает из-за предположения стандартных GNN о том, что соседние узлы, как правило, похожи, что позволяет эффективно агрегировать информацию. В случае гетерофилии, агрегация информации от несхожих соседей может приводить к зашумлению сигнала и ухудшению качества представлений узлов. Механизм Heterophily-Aware Transformer решает эту проблему, адаптируя процесс агрегации соседних признаков таким образом, чтобы учитывать различия между узлами и эффективно фильтровать шум, обеспечивая стабильное обучение и высокую производительность даже на графах с выраженной гетерофилией.

Расширение для графовых нейронных сетей (GNN) позволяет эффективно функционировать в средах со слабой гомофилией, где традиционные методы часто демонстрируют низкую производительность. Гомофилия подразумевает сходство признаков между смежными узлами графа; в ситуациях, когда такая связь отсутствует или выражена слабо, стандартные GNN склонны к накоплению ошибок и неспособности к обобщению. Предложенное расширение преодолевает это ограничение за счет адаптации механизмов обработки информации, позволяя модели эффективно извлекать полезные сигналы даже из гетерофильных графов, где связи между узлами не подразумевают схожесть их характеристик. Это критически важно для работы с данными, представляющими сложные социальные сети, гетерогенные информационные графы и другие типы данных, где гомофилия не является доминирующим свойством.

AdvSynGNN: Объединение для Устойчивости

В основе AdvSynGNN лежит интегрированная архитектура, объединяющая три ключевых компонента для повышения устойчивости графовых нейронных сетей. Механизм Adversarial Propagation позволяет модели предвидеть и смягчать влияние структурных возмущений, распространяя возмущения по графу для обучения более надежным представлениям. В то же время, Heterophily-Aware Transformer учитывает гетерофилию — тенденцию смежных узлов иметь разные классы — что особенно важно для реальных графов, где узлы часто связаны с неоднородными данными. Наконец, Adaptive Signal Calibration динамически настраивает важность различных сигналов, получаемых от соседних узлов, для оптимизации процесса обучения и повышения точности. Такое сочетание методов позволяет AdvSynGNN эффективно справляться со сложными структурными изменениями и обеспечивать стабильную производительность в различных сценариях.

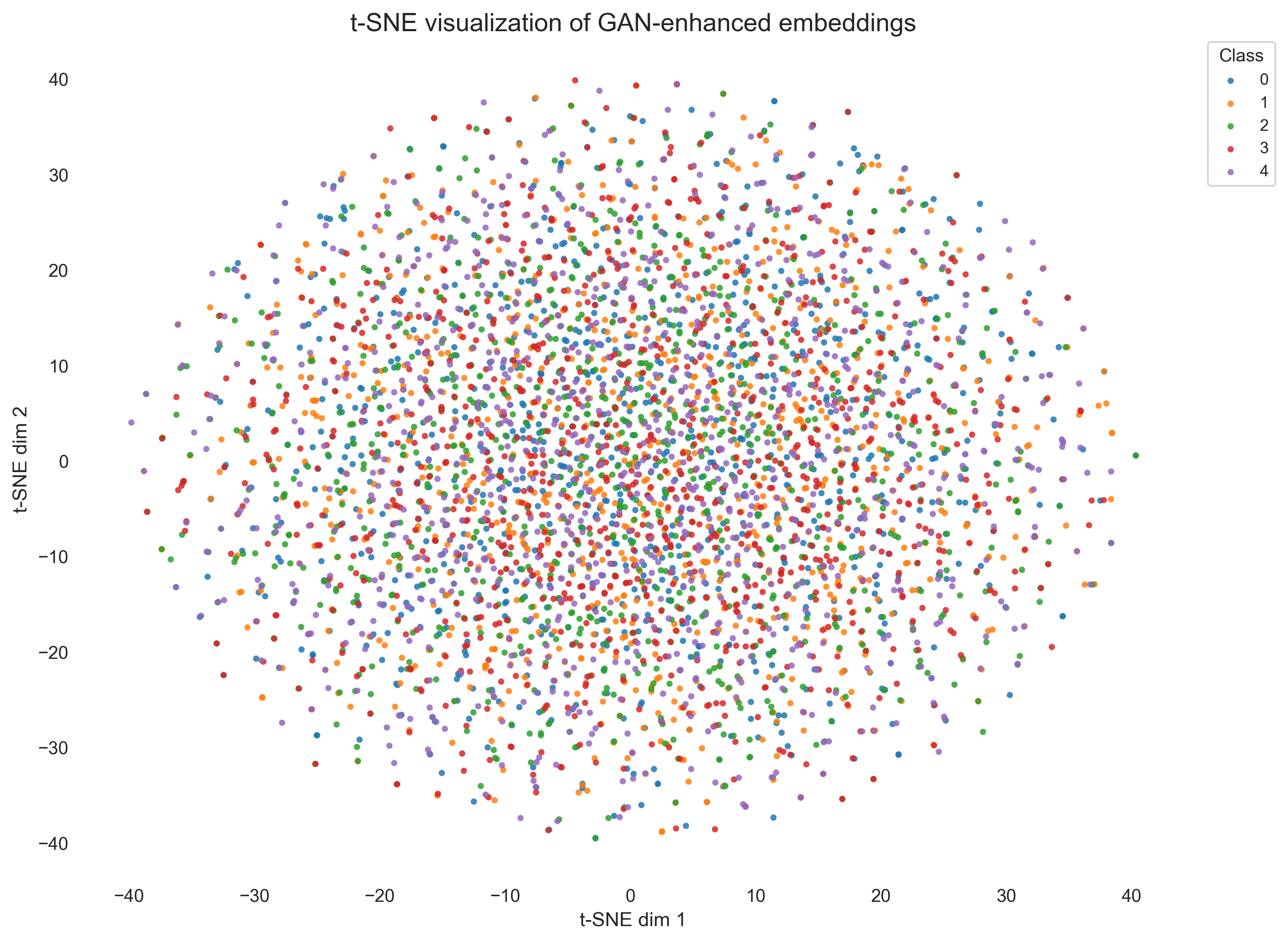

Для повышения устойчивости к структурным возмущениям, AdvSynGNN использует многомасштабные векторные представления и контрастивное предварительное обучение. Этот подход позволяет модели одновременно учитывать как локальные, так и глобальные структурные характеристики графа. Многомасштабные представления позволяют захватывать информацию из различных соседских окружений каждой вершины, в то время как контрастивное обучение способствует формированию более устойчивых и различимых векторных представлений. Благодаря этому, модель способна более эффективно отличать важные структурные особенности от незначительных возмущений, что значительно улучшает её способность к обобщению и сохранению точности даже при наличии изменений в структуре графа. Такое комбинированное использование техник позволяет AdvSynGNN эффективно представлять сложные взаимосвязи в графе и обеспечивать высокую устойчивость к различным типам структурных изменений.

Предложенный унифицированный подход демонстрирует передовые результаты на гетерофильных графовых бенчмарках, что подтверждается значительным снижением искажения векторных представлений на 40.7% при структурных возмущениях. Данное снижение указывает на повышенную устойчивость модели к изменениям в структуре графа, сохраняя при этом качество полученных представлений узлов. Это достигается благодаря интеграции нескольких ключевых компонентов, которые совместно обеспечивают надежную работу даже в условиях неполных или зашумленных данных. В результате, система демонстрирует повышенную точность и надежность в задачах, требующих анализа сложных взаимосвязей в гетерофильных графах.

Разработка AdvSynGNN представляет собой существенный прорыв в создании устойчивых и надежных систем обучения на графах. Достигнутое значительное улучшение метрики AUC на эталонных наборах данных, в частности, на OGB-Proteins, демонстрирует повышенную способность модели сохранять точность предсказаний даже при наличии структурных возмущений в графе. Это свидетельствует о потенциале AdvSynGNN для применения в критически важных областях, где надежность и стабильность работы алгоритмов имеют первостепенное значение, таких как прогнозирование свойств белков и анализ социальных сетей, где небольшие изменения в структуре могут существенно повлиять на результаты.

Представленная работа демонстрирует элегантное решение проблемы устойчивости графовых нейронных сетей в сложных условиях реальных графов. Авторы, подобно математикам, стремящимся к доказательству, а не к эмпирической проверке, предлагают архитектуру AdvSynGNN, основанную на состязательном обучении и адаптивной передаче информации. Этот подход позволяет сети не просто «работать» на тестовых данных, но и демонстрировать надежность при наличии гетерофилии и масштабируемости. Как заметил Джон фон Нейман: «В науке не существует символов величия, только точность и простота». AdvSynGNN, стремясь к этим принципам, представляет собой значительный шаг вперед в разработке надежных и эффективных графовых нейронных сетей.

Что Дальше?

Представленная архитектура AdvSynGNN, несомненно, вносит вклад в повышение устойчивости графовых нейронных сетей. Однако, подобно любому элегантному решению, она лишь откладывает неизбежное столкновение с фундаментальными проблемами. Устойчивость к возмущениям — это хорошо, но истинная проверка — способность к обобщению на принципиально новые, непредсказуемые графовые структуры. Пока что, большая часть исследований сосредоточена на улучшении производительности на существующих бенчмарках, что напоминает полировку иллюзий.

Следующим шагом видится переход от эмпирических улучшений к формальной верификации. Доказательство сходимости и стабильности алгоритма, а не просто демонстрация его работы на наборе тестов, должно стать приоритетом. Особенно остро стоит вопрос о масштабируемости: возможность обработки графов, на порядки превосходящих текущие, требует не просто оптимизации кода, а разработки принципиально новых алгоритмических подходов. Необходимо исследовать возможность интеграции методов символьной математики и логического вывода непосредственно в архитектуру графовых сетей.

В хаосе данных спасает только математическая дисциплина. Пока мы пытаемся «обучить» сети, истинная задача заключается в создании систем, способных к логическому выводу и самокоррекции. AdvSynGNN — лишь шаг на этом пути, и лишь время покажет, насколько он приблизил нас к созданию действительно интеллектуальных систем.

Оригинал статьи: https://arxiv.org/pdf/2602.17071.pdf

Связаться с автором: https://www.linkedin.com/in/avetisyan/

Смотрите также:

- ПРОГНОЗ ДОЛЛАРА К ШЕКЕЛЮ

- БИТКОИН ПРОГНОЗ. BTC криптовалюта

- SIREN ПРОГНОЗ. SIREN криптовалюта

- MYX ПРОГНОЗ. MYX криптовалюта

- ЭФИРИУМ ПРОГНОЗ. ETH криптовалюта

- SAROS ПРОГНОЗ. SAROS криптовалюта

- SOL ПРОГНОЗ. SOL криптовалюта

- ZEC ПРОГНОЗ. ZEC криптовалюта

- ДОГЕКОИН ПРОГНОЗ. DOGE криптовалюта

- ПРОГНОЗ ДОЛЛАРА

2026-02-20 12:03