Автор: Денис Аветисян

Исследование предлагает оригинальный подход к повышению устойчивости и снижению вычислительных затрат глубокого обучения, используя инструменты теории случайных матриц.

В работе представлена методика, основанная на спектральной геометрии и теории случайных матриц, для обнаружения галлюцинаций и сжатия моделей глубокого обучения.

Несмотря на впечатляющую производительность, глубокие нейронные сети остаются уязвимыми к галлюцинациям и характеризуются высокой вычислительной сложностью. В настоящей работе, ‘Spectral Geometry for Deep Learning: Compression and Hallucination Detection via Random Matrix Theory’, предложен унифицированный подход, основанный на спектральной геометрии и теории случайных матриц, для анализа структуры собственных значений скрытых активаций. Разработаны методы EigenTrack для обнаружения галлюцинаций и RMT-KD для эффективной компрессии моделей, сохраняя при этом точность и надежность. Способны ли спектральные характеристики стать ключевым инструментом для мониторинга неопределенности и оптимизации больших нейронных сетей?

Разоблачение Скрытых Состояний: Необходимость Внутреннего Мониторинга

Современные нейронные сети, несмотря на впечатляющую производительность, зачастую функционируют как “чёрные ящики”, затрудняя понимание внутренних процессов, приводящих к конкретному решению. Эта непрозрачность возникает из-за сложной архитектуры и огромного количества параметров, которые взаимодействуют нелинейным образом. В отличие от традиционных алгоритмов, где логика каждого шага ясна и отслеживаема, внутренние представления в нейронных сетях остаются скрытыми, что делает проблематичным выявление причин ошибок или предвзятости. Попытки “взглянуть внутрь” сети, например, с помощью визуализации активаций или анализа градиентов, предоставляют лишь частичную картину, не раскрывая полной картины принятия решений. Такая неясность представляет серьезную проблему, особенно в приложениях, требующих высокой степени надежности и объяснимости, таких как медицина или автономное вождение.

Непрозрачность современных нейронных сетей представляет серьезную проблему для обеспечения надежности, особенно в критически важных областях применения, где доверие и объяснимость имеют первостепенное значение. В таких сферах, как здравоохранение, финансы или автономное управление, ошибки модели могут иметь катастрофические последствия, а отсутствие понимания процесса принятия решений затрудняет выявление и исправление этих ошибок. Невозможность проследить логику рассуждений нейронной сети подрывает доверие пользователей и регуляторов, препятствуя широкому внедрению искусственного интеллекта в ответственные области. Повышение прозрачности и объяснимости моделей становится не просто желательной функцией, а необходимостью для обеспечения безопасного и эффективного использования искусственного интеллекта в современном мире.

Обнаружение случаев, когда модель искусственного интеллекта уверенно выдает неверную информацию, или, как это называют, «галлюцинирует», является ключевым шагом в создании более надежных и заслуживающих доверия систем. Несмотря на значительный прогресс в области машинного обучения, современные методы определения подобных ошибок демонстрируют лишь ограниченную эффективность, достигая в среднем 89-92% точности. Это означает, что в значительной части случаев модель может ошибочно предоставлять ложные сведения, будучи при этом абсолютно уверенной в их правильности, что представляет серьезную проблему для применения ИИ в критически важных областях, требующих безошибочной работы и объяснимости принимаемых решений.

Спектральная Геометрия: Новый Взгляд на Нейронные Сети

Внутреннее состояние нейронной сети можно охарактеризовать спектром ее матриц активаций, что позволяет получить важную информацию о формируемых ею представлениях. Спектр, определяемый собственными значениями и собственными векторами матрицы активации, отражает распределение «энергии» в сети на различных признаках. Высокие собственные значения соответствуют доминирующим направлениям в пространстве признаков, определяющим наиболее значимые компоненты входных данных. Анализ собственных векторов показывает, как различные нейроны в слое реагируют на эти направления. Таким образом, спектр матрицы активации служит компактным представлением информации о том, как сеть преобразует входные данные и какие признаки она считает наиболее важными для решения задачи. A\mathbf{v} = \lambda\mathbf{v}, где λ — собственное значение, а \mathbf{v} — соответствующий собственный вектор.

Спектральная геометрия, как раздел математики, изучающий матрицы через их собственные значения и собственные векторы, предоставляет эффективный инструментарий для анализа внутренних состояний нейронных сетей. Анализ собственных значений матрицы активаций позволяет определить доминирующие направления в пространстве признаков, представляя собой своего рода «спектральный отпечаток» представления данных сетью. Собственные векторы, соответствующие этим собственным значениям, описывают направления, вдоль которых сеть наиболее чувствительна к изменениям входных данных. Таким образом, спектральная геометрия позволяет количественно оценить и визуализировать структуру внутренних представлений, выявляя взаимосвязи между признаками и определяя вклад каждого признака в общую функцию сети. Методы, основанные на анализе собственных значений и собственных векторов, такие как \sigma(A) = \{\lambda_i\}, где \sigma(A) — спектр матрицы A, и анализ сингулярных чисел, позволяют характеризовать сложность и стабильность внутренних представлений нейронной сети.

Анализ геометрических свойств спектров матриц активаций позволяет получить представление о процессе рассуждений нейронной сети и выявлять потенциальные аномалии. Спектр, состоящий из собственных значений и собственных векторов, характеризует распределение информации внутри сети. Изменения в геометрии спектра, такие как смещение собственных значений или изменение их кратности, могут указывать на отклонения в работе сети, например, на переобучение или активацию нежелательных признаков. Изучение характеристик, таких как trace(A) (сумма собственных значений) и det(A) (произведение собственных значений), позволяет оценить стабильность и информационную ёмкость представления, сформированного слоем сети. Отслеживание изменений этих характеристик во время обучения или работы сети может служить индикатором возникновения проблем или неэффективности модели.

EigenTrack: Мониторинг Галлюцинаций и Выходящих За Пределы Распределения Данных в Режиме Реального Времени

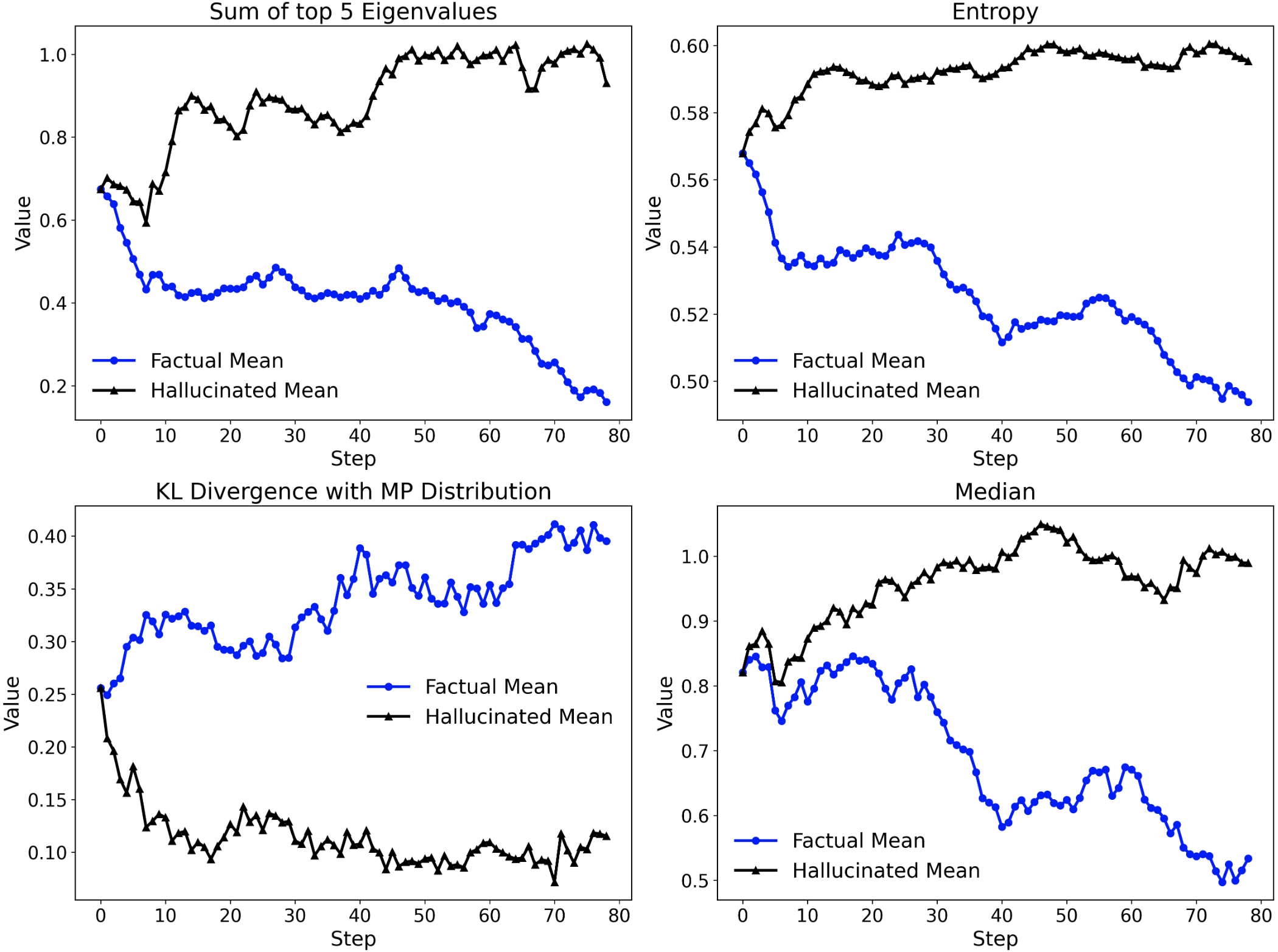

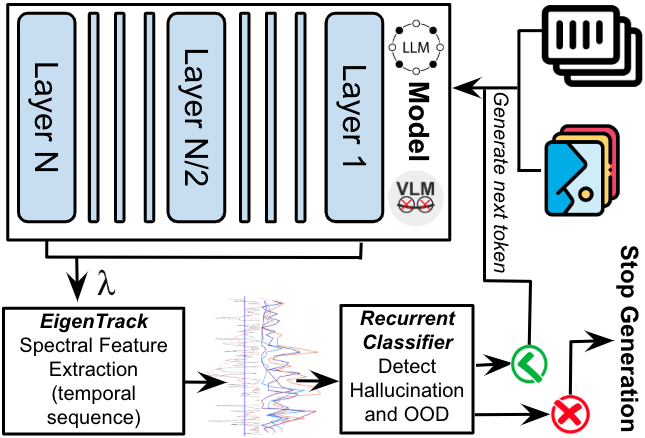

EigenTrack — это новый фреймворк, использующий принципы спектральной геометрии для мониторинга изменений спектров активаций в нейронных сетях в режиме реального времени. Фреймворк анализирует распределение собственных значений матриц активаций, позволяя отслеживать динамику внутренних представлений модели. Это позволяет выявлять отклонения от ожидаемых паттернов активаций, что является ключевым для обнаружения аномалий и потенциальных галлюцинаций в процессе обработки данных. Мониторинг проводится непрерывно, что обеспечивает своевременное реагирование на нежелательное поведение модели.

EigenTrack использует анализ распределения собственных значений для выявления отклонений от ожидаемых паттернов активаций нейронной сети. Отклонения в спектре собственных значений сигнализируют о потенциальных галлюцинациях или поступлении входных данных, не соответствующих тренировочному распределению (out-of-distribution). В ходе исследований EigenTrack продемонстрировал точность до 96% в обнаружении таких аномалий, что подтверждает эффективность данного подхода к мониторингу целостности работы модели в реальном времени. Анализ собственных значений позволяет количественно оценить изменения в структуре активаций и, следовательно, выявить нетипичное поведение сети.

В EigenTrack для моделирования временной динамики спектральных признаков используются рекуррентные нейронные сети (RNN). Это позволяет системе отслеживать изменения в распределении собственных значений с течением времени и выявлять аномалии до того, как они приведут к нежелательным результатам. RNN анализируют последовательности спектральных данных, обучаясь предсказывать ожидаемое поведение и сигнализируя об отклонениях от этой модели. Использование RNN обеспечивает возможность проактивного обнаружения галлюцинаций и выходящих за пределы распределения входных данных, что повышает надежность и безопасность системы.

Теория Случайных Матриц: Понимание Спектральных Свойств

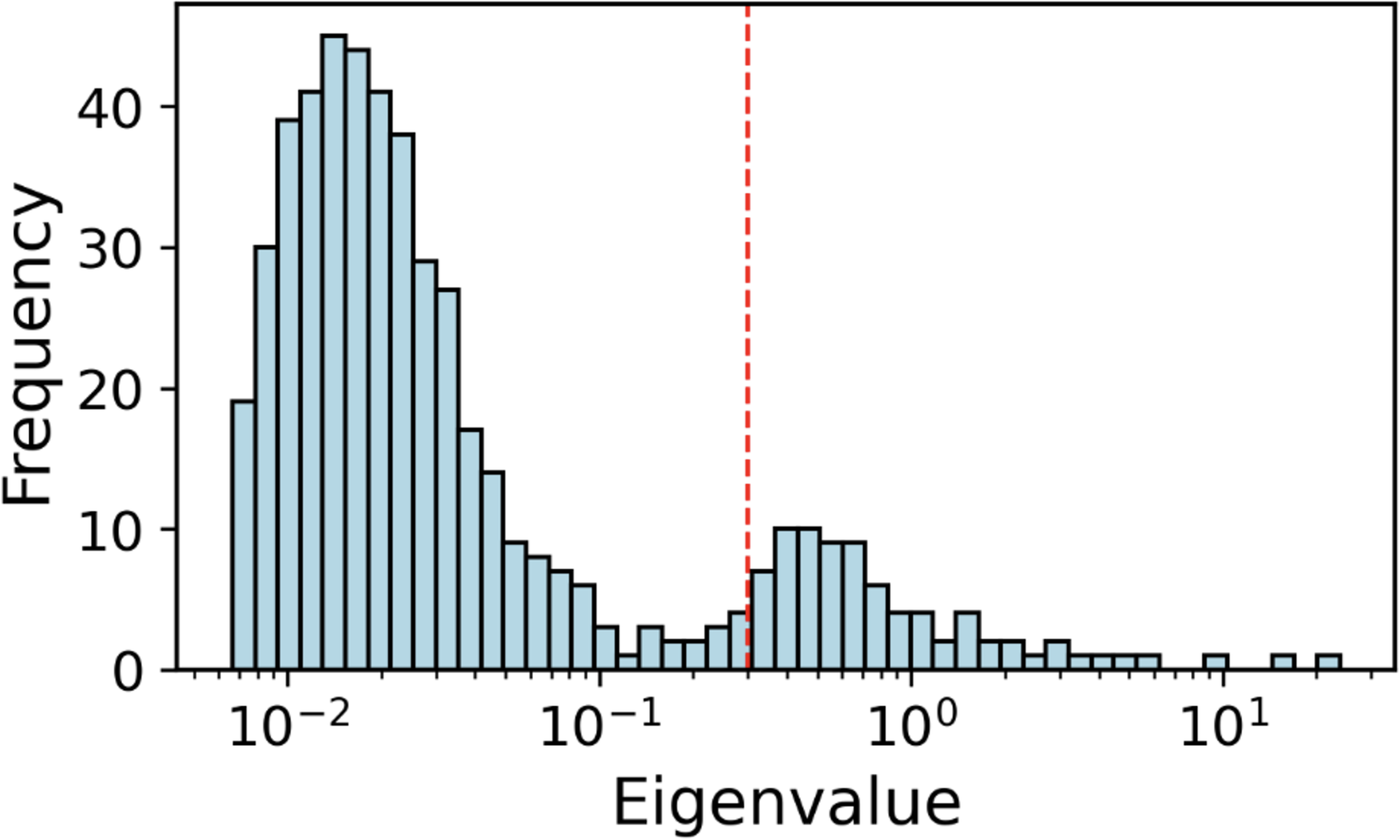

Теория случайных матриц (ТРМ) служит фундаментальной математической основой для интерпретации спектров активаций в нейронных сетях, позволяя эффективно отделять информационный сигнал от случайного шума. В основе этого подхода лежит анализ собственных значений случайных матриц, которые демонстрируют предсказуемые статистические свойства. Эти свойства, в свою очередь, формируют теоретическую базу для определения границ, за пределами которых отклонения в спектрах активаций могут указывать на значимые признаки или аномалии. По сути, ТРМ предоставляет инструменты для понимания, какие части спектра несут полезную информацию, а какие являются результатом случайных флуктуаций, что критически важно для задач, связанных с уменьшением размерности данных, выявлением ключевых признаков и повышением устойчивости моделей машинного обучения.

Теория случайных матриц предоставляет инструменты для анализа спектральных свойств матриц, возникающих в различных областях науки, включая машинное обучение. Ключевыми элементами этого анализа являются закон Марченко-Пастура и распределение Трейси-Видома. Закон Марченко-Пастура описывает распределение собственных значений случайных матриц большого размера, определяя так называемый «спектральный край». Отклонения собственных значений от этого распределения, особенно те, что находятся за пределами спектрального края, рассматриваются как потенциальные индикаторы значимой информации. Распределение Трейси-Видома, в свою очередь, позволяет точно определить вероятность появления таких выбросов, отделяя истинные сигналы от случайного шума. Использование этих распределений в качестве базовых линий позволяет исследователям эффективно выявлять и интерпретировать наиболее важные компоненты данных, что критически важно для задач, связанных с анализом главных компонент и понижением размерности.

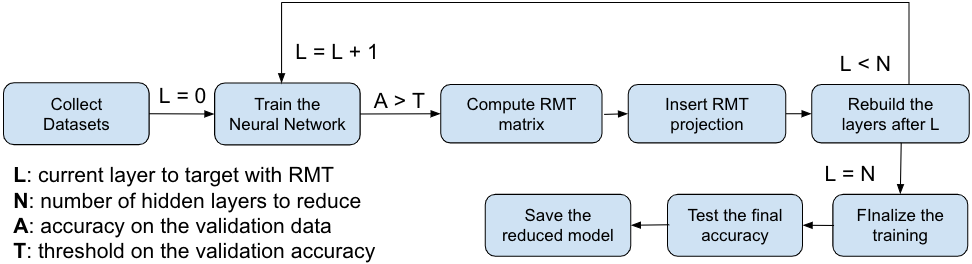

Метод RMT-KD, основанный на теории случайных матриц, представляет собой усовершенствованную технику сжатия моделей машинного обучения. Он позволяет снизить размер модели на 60-80%, проецируя активации на подпространства меньшей размерности, отобранные на основе выявленных аномальных собственных значений. Этот процесс, опирающийся на принципы теории случайных матриц для отделения полезного сигнала от шума, обеспечивает минимальную потерю точности — всего 1-2%. По сути, RMT-KD позволяет эффективно уменьшить вычислительную нагрузку и требования к памяти, сохраняя при этом высокую производительность модели, что особенно важно для развертывания на устройствах с ограниченными ресурсами.

К Надежному Искусственному Интеллекту: Будущее Спектрального Мониторинга

EigenTrack представляет собой значительный прогресс в создании искусственного интеллекта, отличающегося повышенной прозрачностью, надежностью и доверием. Данный фреймворк позволяет отслеживать внутреннее состояние нейронных сетей в режиме реального времени, что дает возможность разработчикам выявлять и устранять потенциальные проблемы до того, как они приведут к ошибкам. В отличие от традиционных методов, EigenTrack обеспечивает более глубокое понимание процессов принятия решений ИИ, способствуя созданию систем, в которых можно быть уверенным. Это особенно важно для приложений, требующих высокой степени ответственности, таких как автономные системы и медицинская диагностика, где понимание логики работы алгоритма критически важно.

Предлагаемый фреймворк EigenTrack предоставляет разработчикам беспрецедентную возможность мониторинга внутреннего состояния нейронных сетей в режиме реального времени. Это позволяет выявлять потенциальные проблемы и аномалии на ранних стадиях, до того, как они приведут к заметным ошибкам или сбоям в работе системы. Благодаря такому проактивному подходу, становится возможным не только оперативное исправление дефектов, но и повышение общей надежности и предсказуемости искусственного интеллекта. Такой мониторинг позволяет, например, обнаруживать “галлюцинации” модели или выход за пределы области обучающих данных, что критически важно для применения в ответственных областях, где безошибочность функционирования является приоритетом.

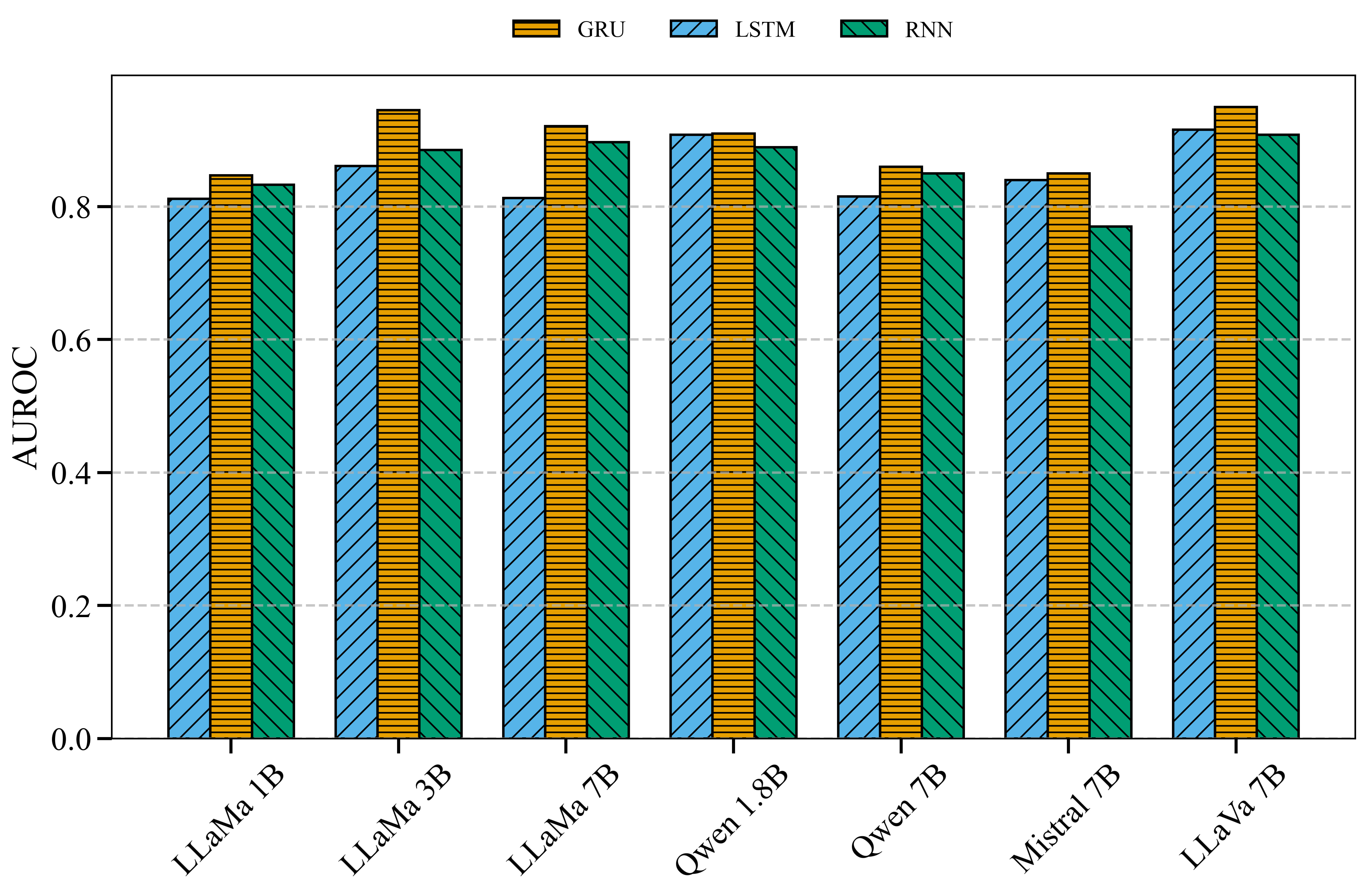

Перспективные исследования направлены на адаптацию данной методики к более сложным архитектурам нейронных сетей и расширение спектра её применения, в частности, в областях, где критически важна надёжность — например, в системах безопасности и научных открытиях. Проведённые тесты демонстрируют высокие показатели точности: значения AUROC в диапазоне 0.82-0.96 для выявления как галлюцинаций, так и внедоменных данных, что значительно превосходит результаты, полученные с использованием традиционных метрик, таких как Cosine Distance (92.0) и Energy Score (89.0). Это позволяет предположить, что разработанный подход может стать ценным инструментом для повышения доверия к системам искусственного интеллекта и обеспечения их безопасной и эффективной работы в различных областях.

Исследование, представленное в данной работе, демонстрирует, что строгое математическое обоснование методов сжатия и обнаружения галлюцинаций в глубоком обучении является ключевым фактором повышения надежности систем. Авторы используют инструменты теории случайных матриц и спектральной геометрии для анализа свойств весов нейронных сетей, что позволяет выявлять аномалии и эффективно уменьшать размер моделей без значительной потери точности. В этом подходе явно прослеживается стремление к математической чистоте и доказуемости алгоритмов. Как однажды заметил Кен Томпсон: «Простота — это высшая степень утонченности». Эта фраза точно отражает суть предложенного метода, где элегантность достигается за счет строгого математического анализа и использования фундаментальных принципов линейной алгебры для решения практических задач.

Что дальше?

Представленная работа, хоть и демонстрирует элегантность подхода, основанного на спектральной геометрии и теории случайных матриц, лишь приоткрывает дверь в область детерминированного анализа глубоких нейронных сетей. До сих пор надежность этих систем оценивалась эмпирически, посредством тестов, которые, как известно, не гарантируют корректности в произвольной ситуации. Ключевым вызовом остается доказательство сходимости спектральных характеристик модели к предсказуемым значениям, отражающим ее истинную способность к обобщению.

Очевидным направлением дальнейших исследований представляется разработка метрик, нечувствительных к конкретной архитектуре сети. Полагаться на эмпирически выведенные пороги для обнаружения галлюцинаций — наивно; необходимы инвариантные характеристики, основанные на фундаментальных принципах линейной алгебры. Иначе говоря, необходимо выйти за рамки “черного ящика” и обрести возможность предсказывать поведение модели, а не просто наблюдать за ним.

Сведение задачи сжатия моделей к анализу собственных значений — шаг в правильном направлении, однако его эффективность ограничена сложностью реальных нейронных сетей. Будущие исследования должны быть направлены на разработку алгоритмов, способных эффективно обрабатывать высокоразмерные матрицы, сохраняя при этом вычислительную эффективность и, что важнее, математическую строгость. В конечном итоге, истинный прогресс будет достигнут лишь тогда, когда мы сможем доказать, а не просто наблюдать.

Оригинал статьи: https://arxiv.org/pdf/2601.17357.pdf

Связаться с автором: https://www.linkedin.com/in/avetisyan/

Смотрите также:

- ПРОГНОЗ ДОЛЛАРА К ШЕКЕЛЮ

- БИТКОИН ПРОГНОЗ. BTC криптовалюта

- MYX ПРОГНОЗ. MYX криптовалюта

- ЭФИРИУМ ПРОГНОЗ. ETH криптовалюта

- SOL ПРОГНОЗ. SOL криптовалюта

- SAROS ПРОГНОЗ. SAROS криптовалюта

- SIREN ПРОГНОЗ. SIREN криптовалюта

- ДОГЕКОИН ПРОГНОЗ. DOGE криптовалюта

- ZEC ПРОГНОЗ. ZEC криптовалюта

- ПРОГНОЗ ДОЛЛАРА

2026-01-28 04:07