Градиенты Больших Языковых Моделей: Новый Взгляд на Оптимизацию

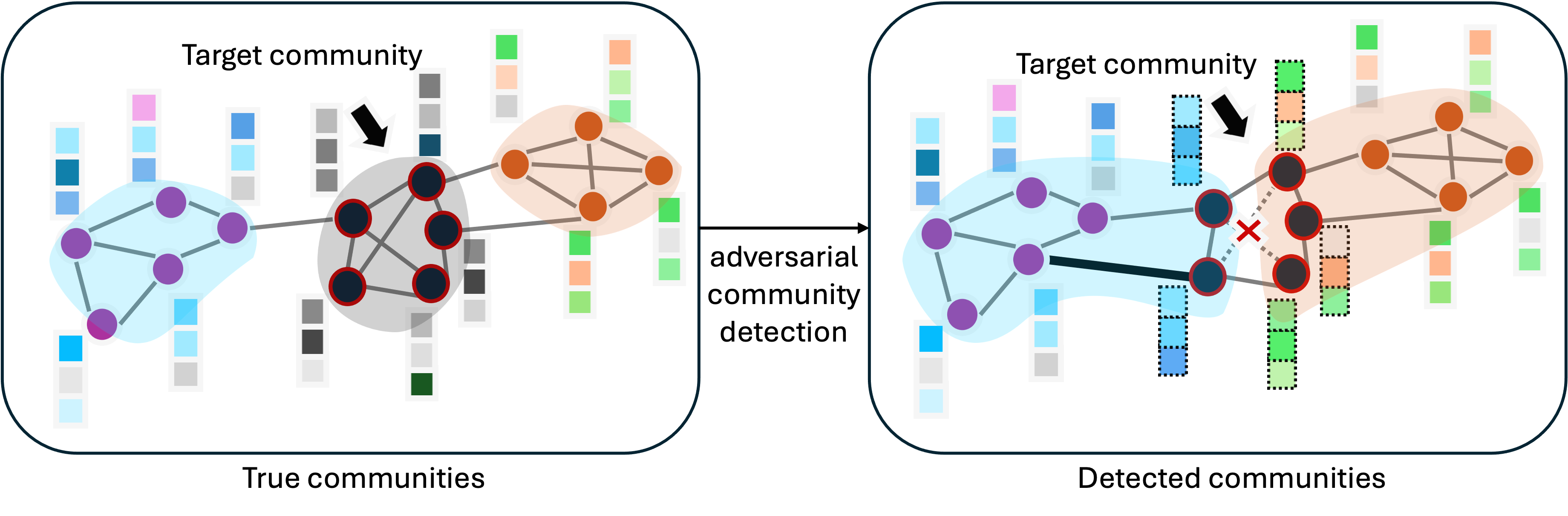

![В ходе исследования сравнивались алгоритмы оптимизации Spectra и AdamW при различных значениях скорости обучения [latex] \eta \in \{8 \times 10^{-4}, 1 \times 10^{-3}, 5 \times 10^{-3}, 1 \times 10^{-2} \} [/latex], при этом Spectra продемонстрировала более быструю сходимость и превосходные результаты в большинстве режимов обучения.](https://arxiv.org/html/2602.11185v1/figures/lr_ablation.png)

Исследование выявило особенности структуры градиентов в больших языковых моделях и предлагает новый подход к оптимизации, направленный на повышение скорости обучения и качества результатов.