Искусственный интеллект на страже сети: как сделать защиту прозрачной

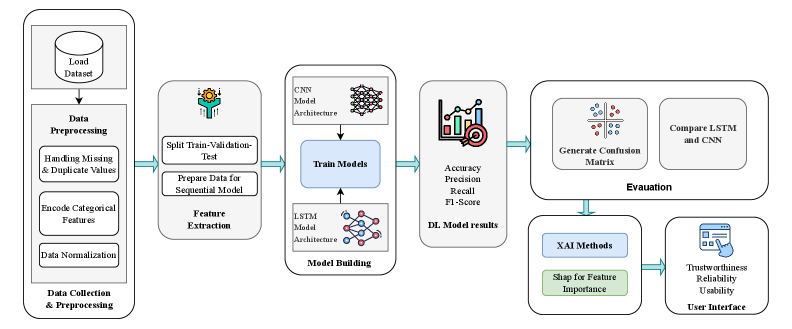

Новая система обнаружения вторжений объединяет возможности глубокого обучения и объяснимого искусственного интеллекта для повышения точности и доверия к решениям в сфере кибербезопасности.