Автор: Денис Аветисян

Новое исследование показывает, что Graph Transformers, несмотря на свою способность обрабатывать удаленные связи, часто усиливают структурные ограничения в графах, приводя к локализованной передаче сообщений.

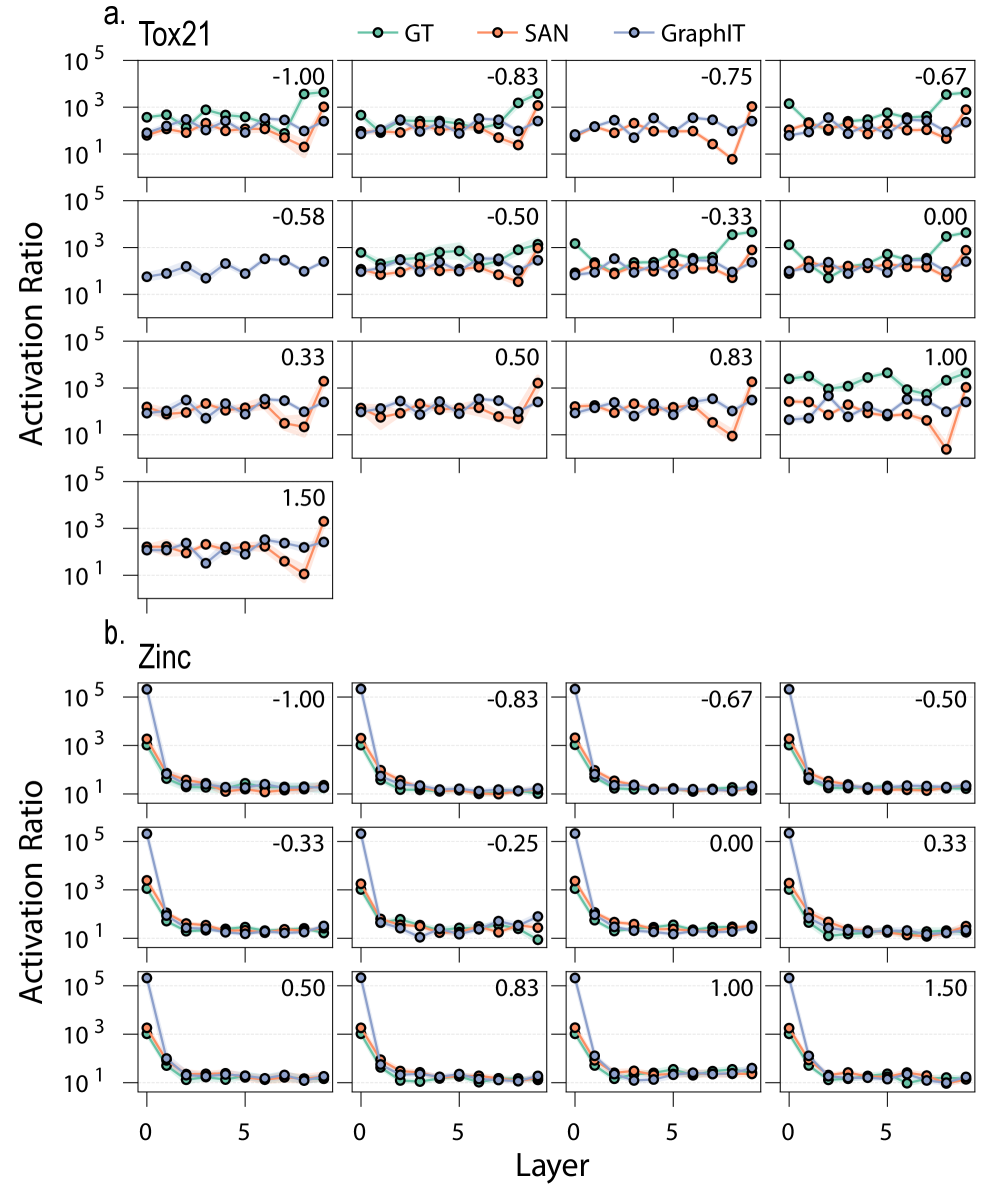

Анализ паттернов активации в Graph Transformers выявляет деградацию глобальной связности и усиление влияния топологических узких мест.

Несмотря на успехи графовых нейронных сетей (GNN) в моделировании сложных взаимосвязей, остается неясным, как топология графа влияет на процесс обучения и распространение информации. В работе ‘Probing Graph Neural Network Activation Patterns Through Graph Topology’ исследуется взаимодействие между топологией графа и особенностями активаций в GNN, в частности, в Graph Transformers. Полученные результаты показывают, что механизмы глобального внимания могут усугублять топологические «узкие места», приводя к снижению эффективности передачи информации на больших расстояниях. Можно ли использовать анализ топологической кривизны графа как диагностический инструмент для выявления и устранения проблем в обучении графовых нейронных сетей?

Бутылочное Горлышко Графового Рассуждения

Несмотря на огромный потенциал графовых нейронных сетей (GNN) в моделировании взаимосвязанных данных, современные методы часто сталкиваются с трудностями при работе со сложными, глубоко связанными графами. Эффективная обработка таких структур требует учета экспоненциально растущего числа путей и зависимостей между узлами, что быстро становится вычислительно непосильным. В результате, GNN могут испытывать трудности с улавливанием тонких, но важных паттернов, особенно в графах, где информация должна распространяться на большие расстояния. Это ограничивает их применимость в критически важных областях, таких как открытие лекарств, анализ социальных сетей и системы рекомендаций, где сложные взаимосвязи играют ключевую роль.

В процессе распространения информации по графу, стандартные методы передачи сообщений в графовых нейронных сетях (GNN) часто сталкиваются с проблемой “сглаживания” и “сжатия”. Феномен сглаживания проявляется в том, что представления узлов, проходя через множество слоев передачи сообщений, становятся всё более похожими друг на друга, теряя индивидуальные характеристики и, следовательно, дискриминационную способность. Одновременно, “сжатие” возникает из-за последовательных операций агрегации и преобразования, которые приводят к потере информации на каждом шаге. В результате, критически важные детали и тонкие взаимосвязи в графе могут быть утеряны, что существенно ограничивает способность GNN к эффективному анализу и моделированию сложных графовых структур. Данные эффекты особенно заметны в глубоких графах, где информация должна проходить через большое количество узлов и ребер, усугубляя потерю информации и снижая качество представления графа.

Ограничения современных графовых нейронных сетей (GNN) в обработке сложных графов обусловлены их неспособностью эффективно учитывать топологические особенности и улавливать взаимосвязи на больших расстояниях. В процессе распространения сообщений по графу, информация, проходя через множество узлов, подвергается сжатию и искажению, что приводит к потере тонких, но важных деталей. Такая «пересжатость» затрудняет выявление сложных закономерностей и взаимосвязей, особенно в глубоко связанных графах, где удаленные узлы могут оказывать значительное влияние друг на друга. В результате, GNN испытывают трудности с различением узлов и связей, критичных для точного анализа и прогнозирования, что снижает их эффективность в задачах, требующих понимания глобальной структуры графа.

Внимание За Пределами Соседства: Графовые Трансформеры

Графовые трансформеры внедряют механизмы внимания в графовые нейронные сети (GNN), позволяя узлам напрямую учитывать информацию из удаленных частей графа. В отличие от традиционных GNN, использующих локальный обмен сообщениями между соседними узлами, трансформеры обходят это ограничение, вычисляя веса внимания между всеми парами узлов. Это позволяет модели учитывать глобальную структуру графа и зависимости между узлами, находящимися на большом расстоянии друг от друга, что невозможно при использовании исключительно локальных операций. Эффективность такого подхода обусловлена способностью внимания динамически определять наиболее важные связи для каждого узла, обеспечивая более эффективное распространение информации по графу.

Традиционные графовые нейронные сети (GNN) часто ограничены способностью улавливать зависимости между узлами, расположенными далеко друг от друга в графе, поскольку они полагаются на локальную передачу сообщений. Трансформеры для графов преодолевают это ограничение, моделируя дальнодействующие зависимости напрямую. Это позволяет им выявлять сложные взаимосвязи, которые ранее были недоступны для GNN, такие как корреляции между узлами в разных частях графа, не связанных непосредственными ребрами. Такой подход позволяет более эффективно обрабатывать графы со сложной структурой и выявлять скрытые закономерности, требующие анализа информации из различных областей графа.

Механизм внимания в Graph Transformers обеспечивает динамическое взвешивание связей между узлами графа. Вместо равномерной обработки соседних узлов, как в традиционных GNN, вес каждой связи определяется на основе её релевантности для текущего узла. Этот процесс позволяет модели фокусироваться на наиболее важной информации, игнорируя или минимизируя влияние менее значимых связей. Динамическое взвешивание эффективно предотвращает потерю информации, которая могла бы произойти при использовании фиксированных или усредненных весов, и позволяет модели улавливать тонкие зависимости между узлами, даже если они удалены друг от друга в графе.

Раскрывая Топологические Ограничения в Графовых Трансформерах

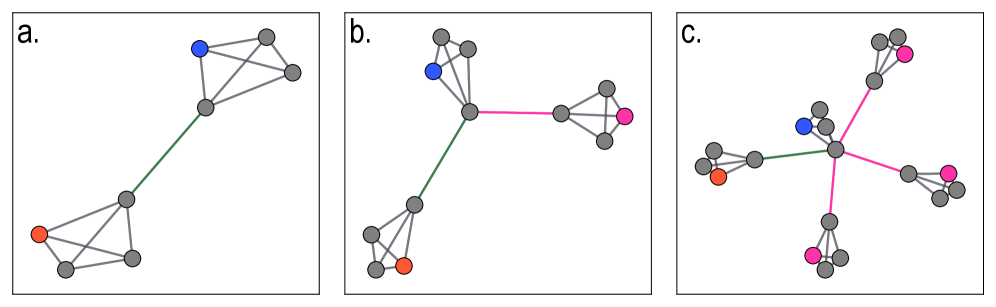

Наше исследование показывает, что механизмы внимания в Graph Transformers, вопреки интуиции, могут усугублять явление “коллапса кривизны” — ситуацию, когда внимание усиливает отрицательную кривизну и узкие места в графе. Этот эффект проявляется в том, что процесс внимания не просто обрабатывает информацию, но и изменяет структуру графа, увеличивая концентрацию отрицательной кривизны в определенных областях. В результате, прохождение информации по графу затрудняется из-за возникновения узких мест, что может негативно сказаться на производительности модели и качестве получаемых результатов. Данное явление требует особого внимания при разработке и оптимизации архитектур Graph Transformers, поскольку стандартные методы, направленные на улучшение производительности, могут усугубить проблему коллапса кривизны.

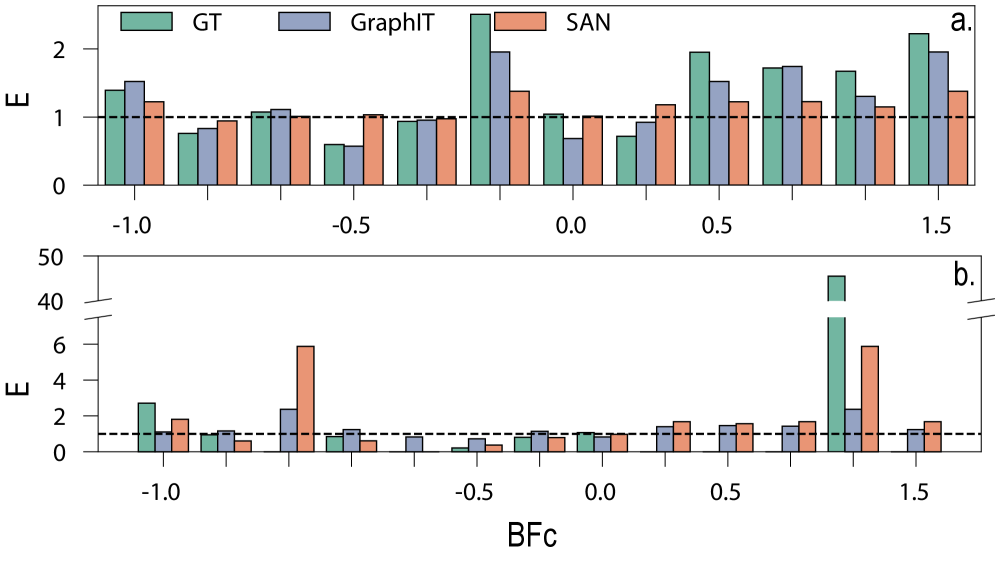

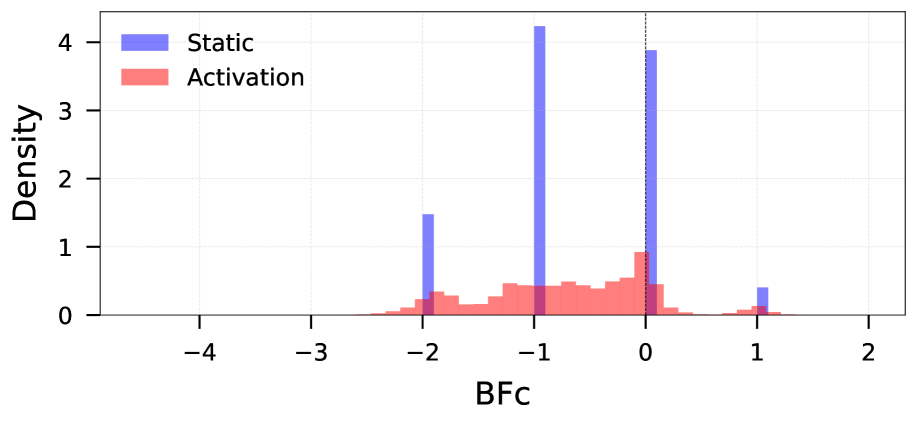

Для количественной оценки узких мест в графах, возникающих при использовании Graph Transformers, применялась метрика «Balanced Forman Curvature». Эксперименты показали снижение данного показателя с -0.6784 до -0.7008 в статических графах после применения трансформаторов. Уменьшение значения Balanced Forman Curvature указывает на увеличение отрицательной кривизны и, следовательно, усиление эффекта «bottlenecking» — сужения путей распространения информации в графе. Данное снижение является статистически значимым и подтверждает, что механизм внимания Graph Transformer может усиливать существующие ограничения в структуре графа.

Анализ показывает существенное увеличение доли ребер с отрицательной кривизной в графах, обрабатываемых Graph Transformer. Если в исходном (статическом) графе доля таких ребер составляла 57%, то после применения механизма внимания она возрастает до 84%. Это указывает на значительное усиление «узких мест» (bottlenecks) в графе, что может негативно сказываться на распространении информации и производительности модели. Увеличение доли ребер с отрицательной кривизной напрямую связано с явлением «коллапса кривизны», при котором внимание усиливает негативную кривизну и ограничивает пропускную способность графа.

Влияние и Применение в Молекулярных Графах

Проверка эффективности предложенного подхода проводилась на широко известных эталонных наборах данных, включая ZINC, Tox21 и Peptides-func. Результаты показали, что коллапс кривизны оказывает значительное влияние на точность предсказаний моделей машинного обучения для молекулярных графов. Наблюдаемая корреляция между кривизной и значимостью ребер указывает на то, что модель активно использует области с высокой кривизной для выявления ключевых структурных особенностей молекул, что, в свою очередь, способствует более точным предсказаниям их свойств и функций. Данные результаты подтверждают, что анализ кривизны может быть ценным инструментом для понимания работы моделей и повышения их эффективности в задачах молекулярного моделирования.

Исследования показали, что удаление связей в молекулярных графах, характеризующихся высокой активацией и отрицательной кривизной, приводит к значительному увеличению потерь при валидации — на 0.1124. Этот результат подтверждает критическую роль таких структур в процессе обучения модели. Подобные связи функционируют как узкие места, ограничивающие поток информации и, следовательно, оказывающие существенное влияние на способность модели к предсказаниям. Потеря этих ключевых связей приводит к деградации производительности, демонстрируя, что модель активно использует и полагается на эти «бутылочные горлышки» для эффективной обработки и анализа молекулярных данных.

Исследования показали, что удаление связей с положительной кривизной в молекулярных графах приводит к незначительному увеличению потерь при валидации — всего на 0.0153. Это указывает на неэффективное распределение внимания моделью к легкодоступным окрестностям молекулы. По сути, модель тратит вычислительные ресурсы на анализ областей, которые и так хорошо понятны, вместо того чтобы фокусироваться на более сложных и информативных участках молекулярной структуры. Данный результат позволяет предположить, что оптимизация механизма внимания с целью снижения акцента на легкодоступные области может повысить эффективность и точность предсказаний в задачах молекулярного моделирования.

К Надежному Графовому Рассуждению: Путь Вперед

Дальнейшие исследования в области графового рассуждения должны быть сосредоточены на разработке методов выявления и устранения топологических узких мест в структуре графов. Эти узкие места, представляющие собой участки с ограниченной пропускной способностью информации, препятствуют эффективному распространению сигналов и снижают общую производительность моделей. Выявление таких участков требует анализа кривизны графа и других топологических характеристик. Устранение этих препятствий может быть достигнуто с помощью различных стратегий, таких как упрощение графа путём объединения узлов или переконфигурация связей между ними. Успешная реализация этих методов позволит создавать более устойчивые и эффективные системы графового рассуждения, способные обрабатывать сложные и неоднородные данные.

Исследования показывают, что применение методов укрупнения графа (graph coarsening) или перекомпоновки связей (edge rewiring) может существенно улучшить эффективность алгоритмов обработки графов. Укрупнение графа, заключающееся в объединении нескольких узлов в один, позволяет снизить вычислительную сложность и уменьшить шум в данных. Перекомпоновка связей, в свою очередь, направлена на устранение «узких мест» в структуре графа, где информация испытывает затруднения при распространении. Оптимизируя топологию графа таким образом, можно добиться более плавного и быстрого распространения информации между узлами, что, в свою очередь, способствует повышению точности и надежности алгоритмов анализа графов, особенно в задачах, связанных с предсказанием свойств узлов или выявлением скрытых взаимосвязей.

Разработка надежных систем рассуждений на графах становится возможной благодаря интеграции топологического анализа с передовыми механизмами внимания. Исследования показывают, что учет геометрических свойств графа, таких как кривизна и связность, позволяет выявить узкие места, ограничивающие распространение информации. Комбинируя эти топологические сведения с внимательными механизмами, способными динамически взвешивать важность различных узлов и связей, можно значительно повысить устойчивость и обобщающую способность системы. Такой подход позволяет моделям лучше понимать сложные взаимосвязи в данных, эффективно обрабатывать шум и неполноту информации, а также адаптироваться к новым, ранее не встречавшимся графовым структурам. В результате, системы рассуждений на графах становятся более надежными и способными решать широкий спектр задач, от анализа социальных сетей до открытия новых лекарственных препаратов.

Исследование паттернов активации в графовых нейронных сетях выявляет парадоксальную ситуацию: архитектуры, предназначенные для преодоления ограничений топологических узких мест, зачастую их усугубляют. Авторы демонстрируют, что графовые трансформеры, несмотря на потенциал для захвата зависимостей на больших расстояниях, склонны к локальной предвзятости при передаче сообщений. Это подтверждает известную мысль Брайана Кернигана: «Простота — это высшая степень совершенства». Сложность архитектуры не гарантирует решение проблемы, а напротив, может привести к неожиданным ограничениям и ухудшению глобальной связности графа, что противоречит изначальной цели — эффективной обработке информации в сложных графовых структурах. Необходимо стремиться к ясности и лаконичности, чтобы избежать ненужных усложнений и обеспечить надежную работу модели.

Что Дальше?

Наблюдаемое усугубление топологических узких мест в графовых трансформаторах, несмотря на их заявленную способность к моделированию дальнодействующих связей, представляет собой парадоксальное явление. Попытки обойти ограничения, связанные с локальным обменом сообщениями, приводят к воспроизведению тех же самых проблем, что и в более простых моделях. Необходимо пересмотреть фундаментальные предположения о том, как лучше всего представлять и обрабатывать графовые данные. Вопрос не в том, чтобы добавлять новые слои сложности, а в том, чтобы найти способ уменьшить избыточность и выделить истинно значимые связи.

Будущие исследования должны быть сосредоточены на разработке методов, позволяющих оценивать и смягчать узкие места в графах до обучения модели. Игнорирование топологии графа — ошибка, за которую приходится платить вычислительными ресурсами и снижением обобщающей способности. Использование геометрических методов, выходящих за рамки простой кривизны, может дать новые инструменты для понимания структуры графов и оптимизации процессов обмена сообщениями.

В конечном счете, прогресс в области графовых нейронных сетей зависит не от создания более сложных архитектур, а от способности к интеллектуальной экономии. Простота — не ограничение, а признак глубокого понимания. Если система не может быть объяснена в одном предложении, она, вероятно, не понята.

Оригинал статьи: https://arxiv.org/pdf/2602.21092.pdf

Связаться с автором: https://www.linkedin.com/in/avetisyan/

Смотрите также:

- ПРОГНОЗ ДОЛЛАРА К ШЕКЕЛЮ

- БИТКОИН ПРОГНОЗ. BTC криптовалюта

- SAROS ПРОГНОЗ. SAROS криптовалюта

- ЭФИРИУМ ПРОГНОЗ. ETH криптовалюта

- SIREN ПРОГНОЗ. SIREN криптовалюта

- SOL ПРОГНОЗ. SOL криптовалюта

- MYX ПРОГНОЗ. MYX криптовалюта

- ORDI ПРОГНОЗ. ORDI криптовалюта

- ПРОГНОЗ ЕВРО К ШЕКЕЛЮ

- ZEC ПРОГНОЗ. ZEC криптовалюта

2026-02-25 16:51