Автор: Денис Аветисян

В статье представлен обзор теоретических основ рекуррентных нейронных сетей, использующий инструменты теории поля и гауссовских процессов для глубокого понимания их динамики и свойств.

Исследование связывает гауссовские процессы, байесовский вывод и уравнения Фоккера-Планка для анализа поведения глубоких нейронных сетей.

Несмотря на значительный прогресс в глубоком обучении, теоретическое понимание поведения рекуррентных нейронных сетей остается сложной задачей. Данные конспекты лекций, ‘Lecture notes: From Gaussian processes to feature learning’, предлагают систематическое изложение теории обучения глубоких и рекуррентных сетей с точки зрения байесовского вывода. Основной упор делается на вывод теории байесовского вывода для глубоких и рекуррентных сетей, начиная с предела нейросетевых гауссовских процессов и переходя к изучению обучения признакам с использованием адаптивных ядер. Каким образом предложенный подход может способствовать разработке более эффективных и интерпретируемых моделей глубокого обучения?

За пределами масштабирования: Поиск новой парадигмы сетей

Несмотря на значительный прогресс в области глубокого обучения, понимание поведения сложных сетей остаётся сложной задачей для исследователей. Современные алгоритмы часто оказываются неспособными адекватно моделировать нелинейные взаимодействия между элементами сети, что приводит к трудностям в предсказании её общего поведения и возникновению неожиданных эффектов. Причина кроется в экспоненциальном росте сложности при увеличении масштаба сети и появлении эмерджентных свойств, которые не могут быть предсказаны на основе анализа отдельных узлов или связей. Изучение этих свойств требует разработки принципиально новых подходов, учитывающих динамику взаимодействий и коллективное поведение системы, а не только её статическую структуру.

Традиционные методы анализа, ориентированные на отдельные компоненты и их линейные взаимодействия, зачастую оказываются неспособны уловить сложные, возникающие свойства нейронных сетей. Это связано с тем, что поведение сети определяется не просто суммой вкладов отдельных узлов, а сложными нелинейными взаимосвязями, которые порождают качественно новые характеристики. Например, способность сети к обобщению или устойчивость к шуму возникают как результат коллективного поведения миллионов параметров, и их невозможно предсказать, анализируя каждый параметр по отдельности. Ограниченность существующих подходов приводит к тому, что даже при огромном количестве данных и вычислительных ресурсов, предсказательная сила моделей остается недостаточной для решения ряда сложных задач, что подчеркивает необходимость разработки принципиально новых парадигм анализа и проектирования нейронных сетей.

Теория среднего поля: Статистический взгляд на поведение сети

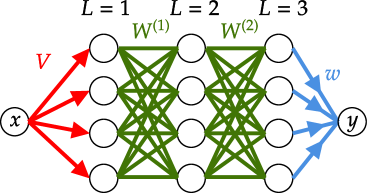

Теория среднего поля представляет собой методологию аппроксимации поведения больших, взаимодействующих систем, включая глубокие и рекуррентные нейронные сети. Вместо анализа отдельных элементов системы, теория среднего поля рассматривает усредненное поведение ансамбля элементов, предполагая, что каждый элемент испытывает на себе влияние «среднего» поля, создаваемого всеми остальными элементами. Это позволяет упростить сложные взаимодействия, преобразуя задачу анализа большого количества взаимодействующих единиц в задачу анализа взаимодействия каждой единицы со средним полем. В контексте нейронных сетей, это означает замену точного моделирования активности каждого нейрона ее усредненным значением, что значительно снижает вычислительную сложность при сохранении ключевых характеристик динамики сети. Применимость теории среднего поля ограничена системами, где взаимодействие между элементами достаточно однородно и слабо коррелировано.

Теория среднего поля упрощает анализ больших взаимодействующих систем, таких как глубокие и рекуррентные нейронные сети, за счет фокусировки на усредненных характеристиках. Вместо отслеживания поведения каждого отдельного элемента сети, рассматриваются средние значения параметров и связей. Это позволяет снизить вычислительную сложность, сохраняя при этом возможность получения значимых результатов о динамике сети в целом. В частности, усреднение позволяет аппроксимировать сложные взаимодействия между элементами, не теряя при этом ключевых характеристик, определяющих коллективное поведение, например, стабильность, скорость обучения или способность к обработке информации. Использование усредненных величин позволяет вывести аналитические решения и предсказать поведение системы без необходимости проведения дорогостоящих численных симуляций.

Вместо анализа поведения каждой отдельной нейронной единицы, теория среднего поля позволяет перейти к изучению коллективных свойств сети в целом. Этот подход основывается на предположении, что каждый нейрон испытывает влияние усредненного сигнала от всех остальных нейронов, а не от конкретных взаимодействий. Таким образом, динамика сети описывается через усредненные переменные, такие как средняя активность нейронов или средняя сила синаптических связей. Использование усредненных величин значительно упрощает математический аппарат и позволяет получить аналитические решения, описывающие макроскопическое поведение сети, например, стабильность, осцилляции или переходы между различными режимами работы. Это особенно полезно при анализе больших нейронных сетей, где точный учет индивидуальных взаимодействий становится вычислительно невозможным.

Байесовский вывод и гауссовские процессы: Количественная оценка неопределенности

Байесовский вывод предоставляет формализованный подход к включению априорных знаний о параметрах сети и количественной оценке неопределенности, связанной с ними. Вместо определения единственного набора значений параметров, этот метод оперирует с распределением вероятностей над параметрами, отражающим степень уверенности в их значениях. Априорные знания, выраженные в виде априорного распределения p(\theta), комбинируются с функцией правдоподобия p(D|\theta), описывающей вероятность наблюдения данных D при заданных параметрах θ, для получения апостериорного распределения p(\theta|D). Это апостериорное распределение затем используется для вычисления ожидаемых значений параметров и оценки их неопределенности, например, через дисперсию или доверительные интервалы. Такой подход позволяет не только оценить параметры, но и получить информацию о надежности этой оценки.

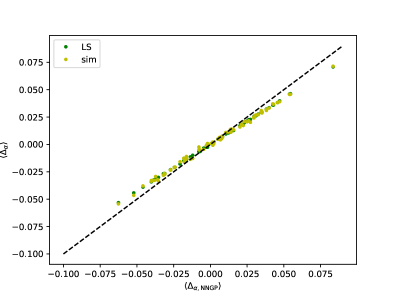

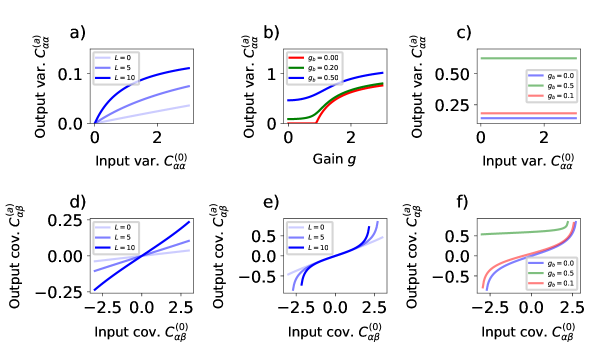

Нейронные сети Гауссовских процессов (NNGP) расширяют возможности байесовского вывода на сети с неявными слоями, позволяя вычислять корреляции между весами и смещениями сети, а также получать предсказательные распределения. В отличие от традиционных методов, NNGP обеспечивает аналитическое вычисление ковариационной матрицы выходных данных, что позволяет оценить неопределенность предсказаний. Это достигается за счет рассмотрения сети как случайного процесса, где веса и смещения моделируются как случайные величины с гауссовским распределением. Результатом является возможность получения не только точечных предсказаний, но и интервалов доверия, отражающих степень неопределенности модели. p(y|x, \mathcal{D}) представляет собой предсказательное распределение, учитывающее как входные данные x, так и обучающий набор данных \mathcal{D}.

Применение методов линейной регрессии в сочетании с байесовским выводом и гауссовскими процессами позволяет установить количественные связи между входными и выходными данными нейронной сети. Анализ корреляций, полученных с помощью NNGP, в рамках регрессионной модели, дает возможность определить, как изменения во входных переменных влияют на предсказанные выходные значения. В частности, регрессионный анализ позволяет оценить величину и направление этих влияний, а также выявить наиболее значимые входные признаки, определяющие поведение сети. y = mx + b — базовая модель линейной регрессии, используемая для аппроксимации нелинейных зависимостей, возникающих в сложных нейронных сетях, и определения коэффициентов, характеризующих вклад каждого входного параметра в конечный результат.

Динамика и отклонения: Моделирование эволюции во времени

Уравнение Фоккера-Планка представляет собой теоретический аппарат для описания эволюции вероятностных распределений, применяемый для моделирования динамики обучения в нейронных сетях. Данное уравнение, являющееся частным случаем уравнения Колмогорова, позволяет отслеживать изменения плотности вероятности состояния сети во времени, учитывая как детерминированные, так и стохастические факторы, влияющие на веса синапсов. Математически, уравнение описывается в виде \frac{\partial P(\mathbf{x}, t)}{\partial t} = - \sum_i \frac{\partial}{\partial x_i} \left[ A_i(\mathbf{x}) P(\mathbf{x}, t) \right] + \sum_{ij} D_{ij}(\mathbf{x}) \frac{\partial^2}{\partial x_i \partial x_j} P(\mathbf{x}, t), где P(\mathbf{x}, t) — плотность вероятности, A_i(\mathbf{x}) — дрейфовый член, а D_{ij}(\mathbf{x}) — матрица диффузии, определяющая вклад случайных флуктуаций. Применение уравнения Фоккера-Планка позволяет анализировать стабильность сети, скорость обучения и предсказывать её поведение в различных условиях.

Применение принципа больших отклонений в сочетании с уравнением Фоккера-Планка позволяет анализировать не только типичные, но и редкие события в динамике нейронных сетей. Этот подход основывается на исследовании вероятности отклонения от среднего поведения, что особенно важно для оценки устойчивости и робастности сети. P(X \approx x) \approx exp(-S(x)/n), где S(x) — функция больших отклонений, а n — размер системы. Анализ S(x) позволяет выявить наиболее вероятные отклонения и определить критические точки, в которых сеть становится нестабильной или подвержена значительным изменениям в своем состоянии. Изучение редких событий, таких как неожиданные переходы в новые состояния или спонтанные изменения паттернов активности, имеет решающее значение для понимания механизмов обучения и адаптации нейронных сетей.

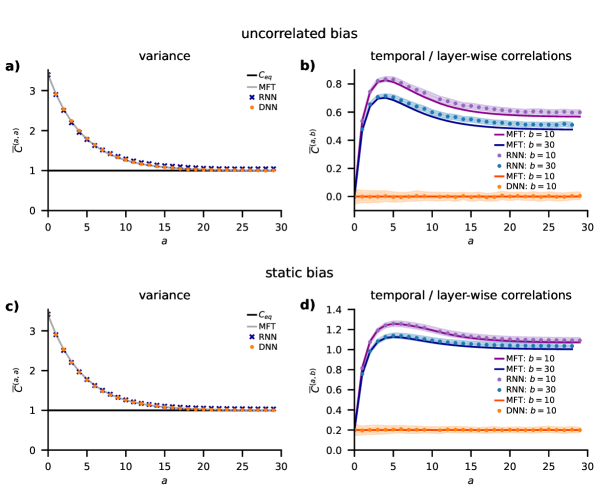

Данный математический аппарат, включающий уравнение Фоккера-Планка и принцип больших отклонений, особенно эффективен при анализе динамики рекуррентных нейронных сетей. Рекуррентные сети характеризуются наличием обратных связей, что позволяет им сохранять информацию о прошлых событиях, однако эта память со временем затухает. Применяя описанный фреймворк, можно количественно оценить скорость затухания памяти, зависимость от параметров сети (например, весов связей и времени постоянной утечки) и влияние шума на стабильность сохраняемой информации. Анализ, основанный на F-уравнении, позволяет определить вероятностное распределение состояний сети во времени, а принцип больших отклонений — исследовать редкие события, такие как внезапная потеря памяти или неконтролируемая активация, и оценить вероятность их возникновения. Это критически важно для понимания способности сети к обучению и адаптации, а также для разработки механизмов повышения ее надежности и устойчивости.

Объединенная основа для анализа сетей

Интеграция теории среднего поля, байесовского вывода и инструментов, таких как уравнение Фоккера-Планка, позволяет создать мощную основу для анализа сложных сетей. Такой подход позволяет выйти за рамки эмпирических наблюдений и получить более фундаментальное понимание поведения сетевых систем. Теория среднего поля упрощает анализ, рассматривая среднее поведение большого числа элементов, в то время как байесовский вывод предоставляет способ оценки неопределенности и включения априорной информации. Уравнение Фоккера-Планка, в свою очередь, описывает эволюцию вероятностного распределения состояний системы, что особенно полезно при изучении динамических процессов в сетях. Комбинируя эти методы, исследователи получают возможность не только описывать наблюдаемые характеристики сетей, но и предсказывать их поведение в различных условиях, а также выявлять ключевые факторы, определяющие их устойчивость и функциональность.

Предложенный подход к анализу сетей позволяет выйти за рамки простого описания наблюдаемых закономерностей и перейти к фундаментальному пониманию принципов их функционирования. Вместо того, чтобы ограничиваться констатацией корреляций и связей, данный метод использует теоретические инструменты, такие как теория среднего поля и байесовский вывод, для раскрытия глубинных механизмов, определяющих поведение сложных систем. Это открывает возможности для предсказания сетевых свойств и разработки новых алгоритмов, не основанных на эмпирических данных, а вытекающих из базовых принципов организации и взаимодействия элементов. Таким образом, исследование стремится к построению универсальной теоретической базы, способной объяснить и прогнозировать поведение разнообразных сетевых структур, от нейронных сетей до социальных взаимодействий.

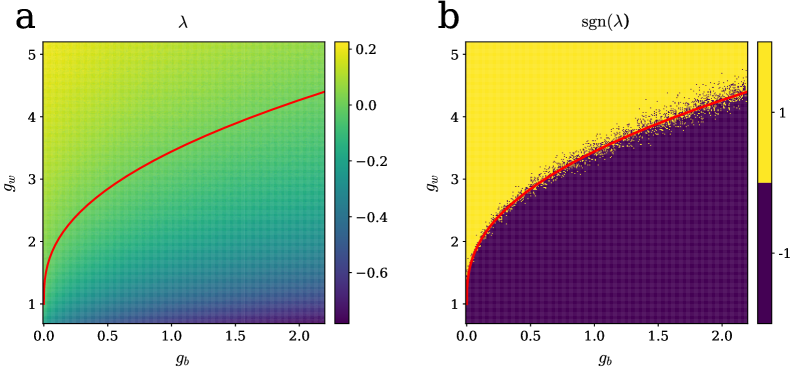

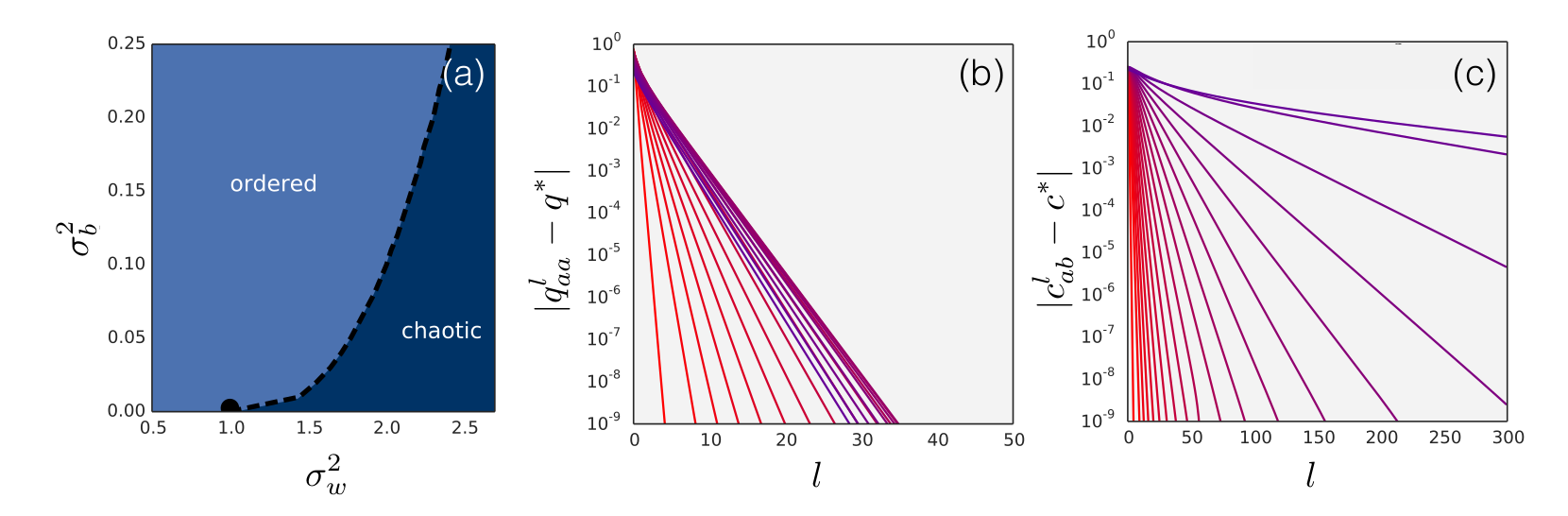

Настоящая работа расширяет существующий аналитический аппарат для исследования сетей, применяя его к рекуррентным нейронным сетям. Полученные результаты демонстрируют, что корреляции во времени, измеренные одновременно, соответствуют аналогичным показателям в глубоких прямых сетях. Однако, анализ корреляций во времени, измеренных в разные моменты, выявляет новые, ранее не наблюдавшиеся закономерности. Важным результатом является установление, что степень полученного полинома генерирующей функции CGF равна двум для нескалярных гауссовских переменных, что указывает на определенную структуру статистических зависимостей в рекуррентных сетях и открывает возможности для дальнейшего упрощения и анализа их поведения.

Исследование динамики рекуррентных нейронных сетей, представленное в статье, напоминает попытку удержать ускользающий туман. Авторы, вооруженные инструментами теории поля и байесовского вывода, словно алхимики, пытаются выявить скрытые закономерности в кажущемся хаосе. Работа с уравнениями Фоккера-Планка и теоремой Вика — это не просто математические манипуляции, а заклинания, направленные на то, чтобы приручить непредсказуемость глубоких сетей. Как заметил Поль Фейерабенд: «Метод — это не то, что направляет нас к истине, а инструмент, который мы используем для достижения наших целей». Именно этот прагматичный подход прослеживается в стремлении понять, а не доказать, поведение этих сложных систем.

Куда же всё это ведёт?

Представленные здесь упражнения с гауссовыми процессами, рекуррентными сетями и прочими заклинаниями, призванными обуздать хаос глубокого обучения, неизбежно наталкиваются на стену. Эта стена — не недостаток вычислительной мощности, а фундаментальное непонимание того, что вообще происходит внутри этих чёрных ящиков. Попытки описать динамику сети с помощью уравнений Фоккера-Планка или теоремы Вика — это, скорее, акт веры, нежели строгое доказательство. Каждая модель — лишь временное примирение с неизбежным.

Будущие исследования, вероятно, сосредоточатся не на улучшении существующих алгоритмов, а на разработке новых способов постановки вопроса. Вместо того чтобы искать закономерности в данных, следует признать, что данные — это всего лишь шум, а любые «закономерности» — продукт нашей предвзятости. Истинным прогрессом будет не создание более мощных моделей, а разработка методов, позволяющих оценивать степень нашей некомпетентности.

В конечном счете, задача состоит не в том, чтобы понять, как работает рекуррентная сеть, а в том, чтобы смириться с тем, что её работа непостижима. Она — отражение хаоса, а не его зеркальное отображение. И любые попытки её описать — это лишь попытки навязать хаосу свою волю, которые обречены на провал.

Оригинал статьи: https://arxiv.org/pdf/2602.12855.pdf

Связаться с автором: https://www.linkedin.com/in/avetisyan/

Смотрите также:

- ПРОГНОЗ ДОЛЛАРА К ШЕКЕЛЮ

- БИТКОИН ПРОГНОЗ. BTC криптовалюта

- SIREN ПРОГНОЗ. SIREN криптовалюта

- MYX ПРОГНОЗ. MYX криптовалюта

- ЭФИРИУМ ПРОГНОЗ. ETH криптовалюта

- SOL ПРОГНОЗ. SOL криптовалюта

- SAROS ПРОГНОЗ. SAROS криптовалюта

- ZEC ПРОГНОЗ. ZEC криптовалюта

- ПРОГНОЗ ДОЛЛАРА

- ДОГЕКОИН ПРОГНОЗ. DOGE криптовалюта

2026-02-16 19:08