Автор: Денис Аветисян

Новое исследование анализирует оптимальные стратегии регулирования контента, созданного искусственным интеллектом, и их влияние на мотивацию авторов и качество создаваемых материалов.

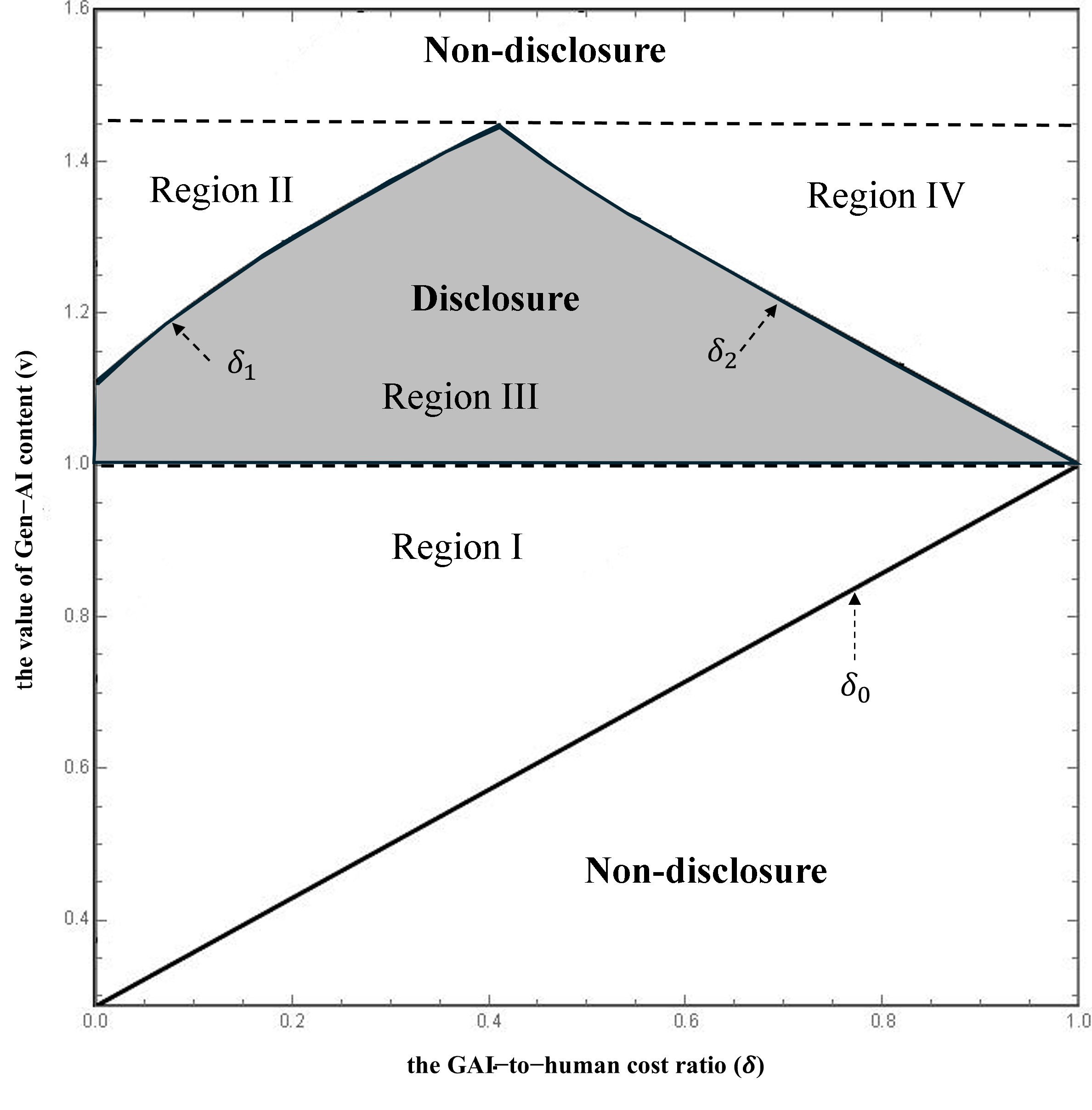

Анализ показывает, что обязательное раскрытие информации об использовании ИИ эффективно только в определенном диапазоне качества и экономической эффективности технологий.

Растущая популярность генеративного искусственного интеллекта (GenAI) ставит платформы перед дилеммой: как обеспечить прозрачность контента, не подавляя при этом творческую активность. В работе ‘When Is Self-Disclosure Optimal? Incentives and Governance of AI-Generated Content’ разработана формальная модель, анализирующая оптимальные стратегии раскрытия информации об AI-генерируемом контенте, учитывающая стимулы создателей и механизмы контроля платформы. Полученные результаты показывают, что обязательное раскрытие информации эффективно лишь в определенном диапазоне качества и экономической выгоды от использования AI, а по мере развития технологий требуется пересмотр подходов к регулированию. Не приведет ли стремление к полной прозрачности к снижению качества контента и подавлению инноваций в сфере генеративного AI?

Истинная Сущность Информации: Вызов Эпохи Генеративного ИИ

Современные генеративные модели искусственного интеллекта, такие как GPT-5.2 и Gemini Ultra, демонстрируют экспоненциальный рост возможностей в создании разнообразного контента. От текстовых материалов и изображений до музыки и видео, эти системы способны генерировать материалы, практически неотличимые от созданных человеком. Этот прогресс не ограничивается простой имитацией; модели активно осваивают новые стили и форматы, расширяя спектр доступных творческих решений. Скорость и масштабируемость генеративного ИИ позволяют создавать огромные объемы контента, значительно превосходящие возможности традиционных методов, что приводит к фундаментальным изменениям в индустриях, связанных с производством и распространением информации.

Распространение контента, созданного генеративными моделями искусственного интеллекта, ставит под вопрос подлинность информации и вызывает закономерную обеспокоенность по поводу снижения доверия аудитории. По мере того, как все больше текстов, изображений и видеоматериалов генерируются алгоритмами, а не людьми, становится сложнее определить, что является истинным отражением реальности, а что — результатом машинной обработки. Это приводит к формированию скептического отношения у зрителей и читателей, которые начинают сомневаться в достоверности всего потребляемого контента. Подобная эрозия доверия способна подорвать основы информационного пространства и создать благоприятную почву для распространения дезинформации и манипуляций, что особенно актуально в эпоху цифровых технологий и социальных сетей.

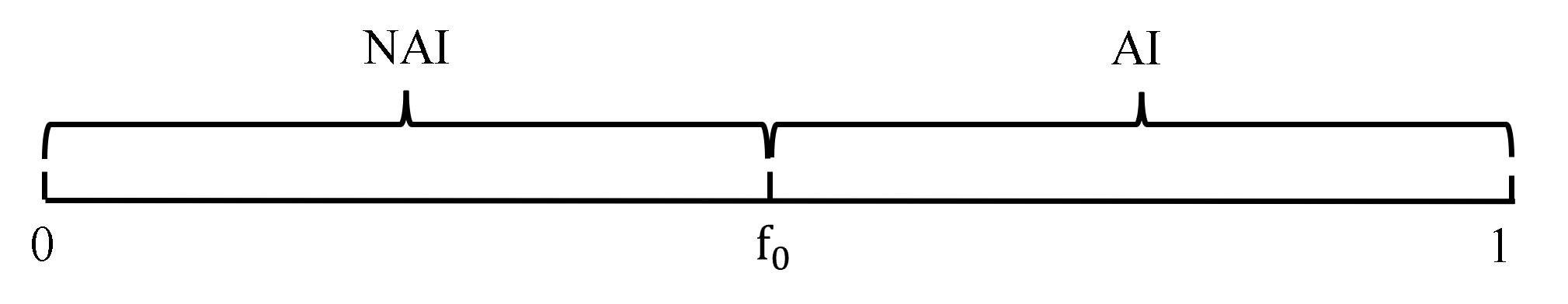

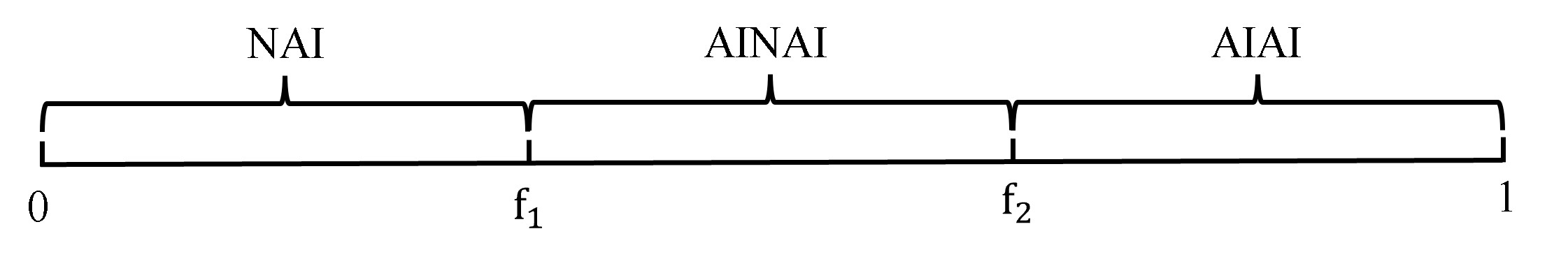

Основная проблема, возникающая в эпоху генеративного искусственного интеллекта, заключается в растущей сложности разграничения между контентом, созданным человеком, и контентом, сгенерированным машиной. Эта неразличимость оказывает существенное влияние на восприятие достоверности информации, поскольку зрители и читатели склонны к снижению доверия к материалам, которые они подозревают в искусственном происхождении. Данная тенденция количественно оценивается посредством так называемого “Коэффициента Скидки Доверия” (f), отражающего степень, в которой аудитория склонна обесценивать контент, если ей известно или предполагается его машинное происхождение. Чем выше значение f, тем сильнее негативное влияние на восприятие надёжности, что подчеркивает необходимость разработки методов для подтверждения подлинности и восстановления доверия к информации в цифровом пространстве.

Управление Платформой: Баланс Инноваций и Целостности

Эффективное управление платформой имеет решающее значение для контроля воздействия контента, сгенерированного искусственным интеллектом (ИИ), поскольку оно напрямую влияет как на качество этого контента, так и на мотивацию создателей. В частности, стратегии управления платформой определяют, насколько широко распространяется контент низкого качества, сгенерированный ИИ, и какие стимулы получают создатели контента для использования ИИ-инструментов. Регулирование может включать в себя политику маркировки, алгоритмическое обнаружение и механизмы модерации, которые, в свою очередь, влияют на экономические и творческие стимулы для создателей контента. Недостаточное управление может привести к распространению дезинформации или контента низкого качества, в то время как чрезмерно строгое управление может подавить инновации и творческое самовыражение.

Платформы, такие как Meta и YouTube, внедряют политики раскрытия информации, обязывающие создателей контента помечать использование технологий искусственного интеллекта (ИИ). Эти политики требуют от пользователей четкой индикации, когда в процессе создания контента использовались инструменты ИИ, например, для генерации текста, изображений или видео. Целью данных мер является повышение прозрачности для пользователей и обеспечение возможности оценки достоверности и происхождения контента. Внедрение таких политик осложняется необходимостью разработки эффективных механизмов контроля и обеспечения соблюдения требований к маркировке, а также сложностью определения и подтверждения использования ИИ в процессе создания контента.

Автоматическое обнаружение контента, сгенерированного искусственным интеллектом, играет важную роль в модерации платформ, однако сталкивается с фундаментальными ограничениями. Точность алгоритмов обнаружения не является абсолютной и варьируется в диапазоне от β (1/2 до 1). Это означает, что даже в оптимальных условиях, алгоритмы могут ошибочно классифицировать контент, сгенерированный ИИ, как созданный человеком, и наоборот. Вероятность ложноположительных и ложноотрицательных результатов напрямую влияет на эффективность систем модерации и требует разработки комплексных стратегий, учитывающих неизбежные ошибки обнаружения. Фактически, алгоритмическое обнаружение не может гарантировать 100% точность, что обуславливает необходимость комбинирования с другими методами контроля, такими как ручная модерация и самораскрытие со стороны создателей контента.

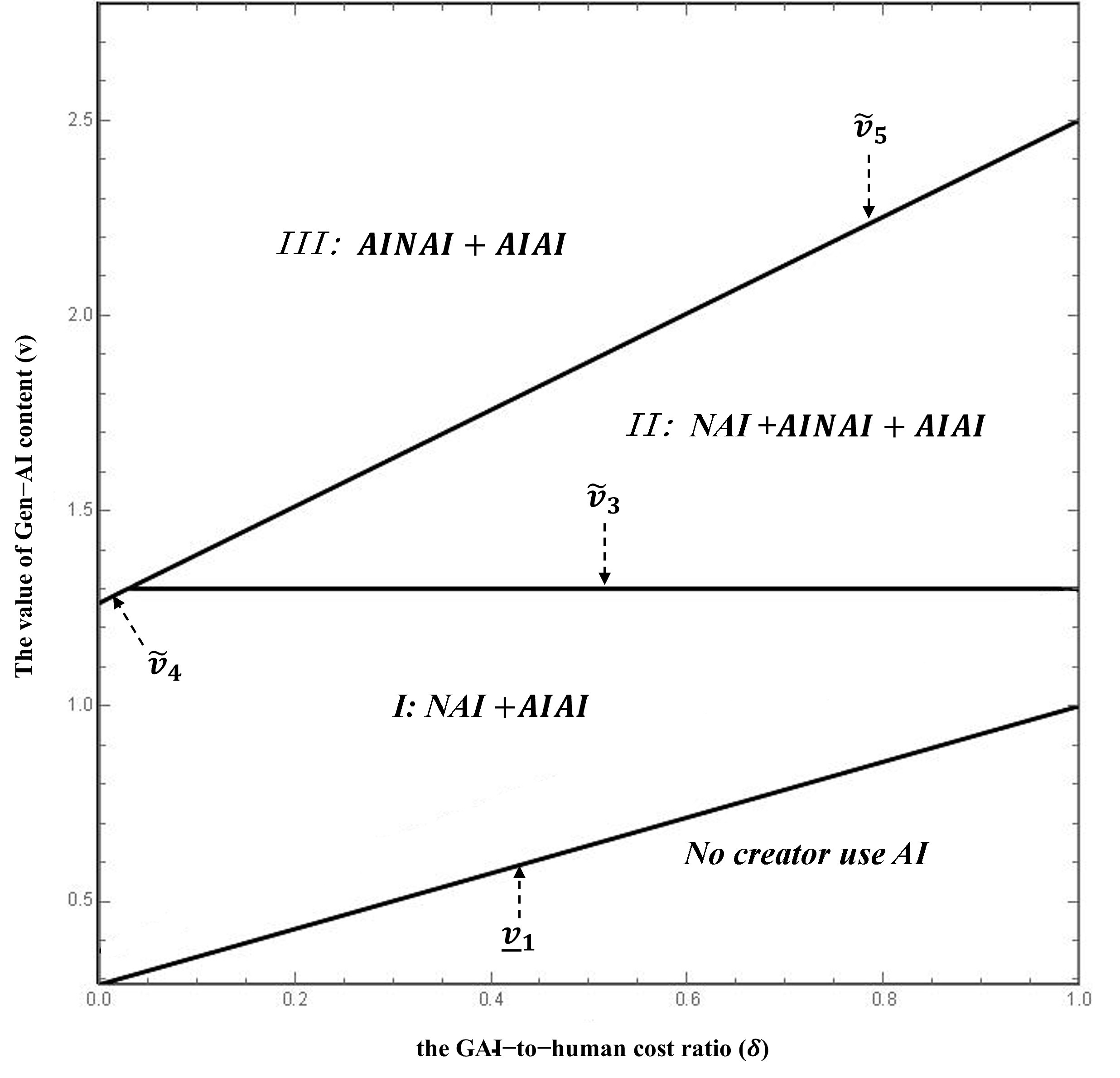

Формальное моделирование позволяет оценить эффективность различных сценариев управления контентом, генерируемым искусственным интеллектом. Исследования показали, что оптимальный уровень раскрытия информации об использовании ИИ достигается лишь в промежуточной области, характеризующейся определенным соотношением между ценностью контента и затратами на его создание. В сценарии полного отсутствия раскрытия (Non-Disclosure Benchmark) и в режиме самораскрытия (Self-Disclosure Regime) наблюдаются отклонения от оптимального уровня. В частности, при низкой ценности контента или высоких затратах на его производство, раскрытие информации об использовании ИИ не приносит существенных преимуществ, а в некоторых случаях может даже снизить эффективность платформы. Моделирование позволяет определить границы этой «оптимальной зоны», где раскрытие информации способствует повышению доверия пользователей и поддержанию качества контента без существенных экономических потерь для создателей контента.

Экономика Раскрытия: Восприятие Зрителя и Прибыль Платформы

Снижение ценности контента в глазах зрителей, вызванное осознанием его генерации искусственным интеллектом, представляет собой значительную проблему для монетизации. Этот эффект, определяемый как “Скидка на доверие” (f), напрямую влияет на готовность аудитории платить за контент. Значение фактора f варьируется в зависимости от типа контента, платформы и степени раскрытия информации об использовании ИИ, но в целом указывает на снижение воспринимаемой ценности по сравнению с контентом, созданным человеком. Чем выше значение f, тем меньшую цену зрители готовы заплатить за аналогичный контент, что существенно снижает потенциальную прибыль от его распространения и требует разработки новых стратегий монетизации, учитывающих этот фактор.

Попытки стратегического сокрытия факта генерации контента искусственным интеллектом, направленные на обход эффекта дисконтирования со стороны зрителей, приводят к снижению доверия к платформе и контенту. Этот процесс выражается в виде ‘Коэффициента Дисконта Доверия’ — k — который напрямую влияет на восприятие ценности контента. По сути, зрители, осознающие или подозревающие сокрытие информации о происхождении контента, склонны оценивать его ниже, даже если качество остается прежним, что негативно сказывается на монетизации и долгосрочной экономической устойчивости платформы. Значение k зависит от степени сокрытия, частоты выявления обмана и общей репутации платформы в отношении прозрачности.

Прибыль платформы и схема распределения доходов напрямую зависят от сохранения вовлеченности аудитории и восприятия контента как подлинного. Стандартная комиссия платформы (r) обычно варьируется в пределах от 30% до 45% от дохода, полученного создателем контента. Эта комиссия является ключевым фактором, определяющим экономическую модель платформы, и ее величина напрямую влияет на мотивацию создателей контента и, как следствие, на объем и качество генерируемого контента. Более высокая комиссия может снизить стимулы для создателей, в то время как слишком низкая комиссия может негативно сказаться на прибыльности платформы и ее способности инвестировать в развитие и поддержание инфраструктуры.

Прозрачный подход к созданию контента, ориентированный на поддержание высокого качества, является ключевым фактором восстановления доверия аудитории и обеспечения долгосрочной экономической устойчивости платформы. Повышение прозрачности позволяет смягчить негативное влияние фактора снижения доверия (k) и стимулировать вовлеченность пользователей. В сочетании с сокращением издержек за счет использования искусственного интеллекта (δ), это позволяет максимизировать прибыльность платформы. Оптимальное сочетание качества контента, прозрачности и снижения издержек создает положительную обратную связь, обеспечивая устойчивый рост и лояльность аудитории.

Будущее, Построенное на Прозрачности: Возрождение Подлинности

В будущем создание контента, вероятно, столкнется со стиранием границ между вкладом человека и искусственного интеллекта. Уже сейчас наблюдается тенденция к использованию алгоритмов для автоматизации рутинных задач, генерации текстов, изображений и даже музыки. Однако, эта интеграция не означает полного замещения человека — скорее, формируется симбиоз, где ИИ выступает инструментом, расширяющим возможности креатора. По мере развития технологий, будет все сложнее определить, где заканчивается работа человека и начинается — машины. Это потребует новых подходов к авторскому праву, оценке качества контента и, что самое главное, к построению доверия аудитории к источникам информации. Появляется необходимость в создании систем, позволяющих идентифицировать и маркировать контент, созданный с использованием ИИ, чтобы зрители могли осознанно оценивать его происхождение и достоверность.

Успех в будущем создании контента напрямую зависит от разработки надёжных систем, обеспечивающих прозрачность. Важно, чтобы зрители имели возможность оценивать происхождение и качество представленного материала. Это достигается посредством внедрения технологий, позволяющих отслеживать этапы создания контента — от первоначальной идеи до финального продукта. Такие системы могут включать в себя цифровые подписи, метаданные, описывающие вклад автора и используемые инструменты, а также алгоритмы, выявляющие признаки манипуляций или искусственной генерации. Прозрачность не только укрепляет доверие аудитории, но и создаёт основу для справедливой оценки труда создателей, способствуя развитию более честной и устойчивой экосистемы контента.

Поддержание подлинности контента становится не просто этической необходимостью, но и ключевым фактором экономического роста для создателей. Исследования показывают, что аудитория все чаще проявляет готовность поддерживать авторов, демонстрирующих искренность и прозрачность в своей работе. Это создает благоприятную среду для формирования новых бизнес-моделей, основанных на прямом взаимодействии с поклонниками и предоставлении эксклюзивного контента в обмен на поддержку. Авторы, способные доказать подлинность своего творчества, получают доступ к расширенным возможностям монетизации, включая краудфандинг, прямые подписки и партнерские программы, что позволяет им сохранять независимость и развивать свои проекты, избегая зависимости от традиционных посредников. В долгосрочной перспективе, акцент на аутентичности формирует лояльную аудиторию, готовую инвестировать не только в контент, но и в развитие творческой личности автора.

Платформы, стремящиеся к долгосрочному успеху в эпоху цифрового контента, обязаны инвестировать в передовые технологии и продуманные политики, направленные на создание устойчивой и заслуживающей доверия экосистемы. Это предполагает разработку инструментов для точной идентификации и маркировки контента, созданного искусственным интеллектом, а также внедрение механизмов, позволяющих пользователям оценивать достоверность информации. Акцент делается на прозрачности алгоритмов, позволяющей понимать, как формируется лента новостей или предлагаются рекомендации. Более того, необходимо создать систему защиты авторских прав, стимулирующую оригинальное творчество и препятствующую распространению дезинформации. Инвестиции в эти направления не только укрепят репутацию платформы, но и откроют новые возможности для монетизации качественного контента, формируя тем самым здоровую и динамично развивающуюся цифровую среду.

Исследование оптимальных стратегий управления контентом, сгенерированным искусственным интеллектом, подчеркивает необходимость детерминированного подхода к оценке качества и затрат. Как отмечает Брайан Керниган: «Простота — это высшая степень совершенства». Данное утверждение находит отражение в анализе, представленном в работе, где показано, что обязательное раскрытие информации об использовании ИИ эффективно лишь в определенном диапазоне соотношения качества контента и его стоимости. Выход за эти рамки приводит к непредсказуемым последствиям для мотивации создателей и общего качества генерируемого контента, что противоречит принципам математической чистоты и доказуемости алгоритмов.

Куда двигаться дальше?

Без четкого определения критериев «качества» контента, любая дискуссия об оптимальных механизмах раскрытия информации о его происхождении обречена на провал. Представленная работа демонстрирует, что обязательное раскрытие информации об использовании генеративного искусственного интеллекта имеет смысл лишь в узком диапазоне характеристик этой самой технологии. Однако, что есть «достаточно хорошее» качество? И как измерить «экономическую эффективность» создания контента? Эти вопросы требуют формализации, а не интуитивных оценок.

Очевидное ограничение — предположение об однородности пользователей и их реакций на раскрытие информации. Реальность же такова, что доверие формируется дифференцированно. Необходимо исследовать, как различные сегменты аудитории воспринимают контент, созданный с помощью ИИ, и как раскрытие информации влияет на их восприятие. Простое «раскрытие» — не панацея; важен контекст и способ подачи информации.

В конечном счете, задача сводится не к регулированию, а к построению систем, в которых само определение «подлинности» контента становится излишним. Если алгоритм способен доказать математическую корректность и логическую непротиворечивость произведения, необходимость в маркировке «создано ИИ» отпадет сама собой. Пока же, любое решение — лишь приближение к истине, замаскированное под практическую необходимость.

Оригинал статьи: https://arxiv.org/pdf/2601.18654.pdf

Связаться с автором: https://www.linkedin.com/in/avetisyan/

Смотрите также:

- ПРОГНОЗ ДОЛЛАРА К ШЕКЕЛЮ

- БИТКОИН ПРОГНОЗ. BTC криптовалюта

- MYX ПРОГНОЗ. MYX криптовалюта

- ЭФИРИУМ ПРОГНОЗ. ETH криптовалюта

- SOL ПРОГНОЗ. SOL криптовалюта

- SIREN ПРОГНОЗ. SIREN криптовалюта

- SAROS ПРОГНОЗ. SAROS криптовалюта

- ДОГЕКОИН ПРОГНОЗ. DOGE криптовалюта

- ПРОГНОЗ ДОЛЛАРА

- ZEC ПРОГНОЗ. ZEC криптовалюта

2026-01-28 00:23