Автор: Денис Аветисян

Новое исследование показывает, что современные системы выявления ложных новостей уязвимы к манипуляциям с эмоциональной окраской текста, генерируемым большими языковыми моделями.

Предложена методика AdSent, обеспечивающая устойчивость систем обнаружения фейков к атакам, основанным на изменении тональности текста.

Распространенные методы выявления фейковых новостей часто уязвимы к манипуляциям с эмоциональной окраской текста, особенно в эпоху развития больших языковых моделей. В данной работе, озаглавленной ‘Robust Fake News Detection using Large Language Models under Adversarial Sentiment Attacks’, исследуется устойчивость современных детекторов фейковых новостей к специально разработанным атакам, изменяющим тональность текста. Полученные результаты показывают, что изменение эмоциональной окраски существенно влияет на точность классификации, приводя к смещению в сторону признания нейтральных статей правдивыми, а не нейтральных — ложными. Возможно ли создать надежную систему обнаружения фейковых новостей, невосприимчивую к манипуляциям с тональностью, и какие стратегии обучения позволят достичь этой цели?

Временной Парадокс Дезинформации

Распространение дезинформации и ложных сведений представляет собой серьезную угрозу для способности общества принимать обоснованные решения и поддерживать доверие к источникам информации. Постоянно увеличивающийся объем недостоверных новостей и преднамеренно искаженных фактов подрывает основы рационального мышления и создает благоприятную почву для манипуляций общественным мнением. Эта тенденция особенно опасна в условиях стремительного развития цифровых технологий и социальных сетей, где ложная информация может распространяться с невероятной скоростью, достигая огромной аудитории и оказывая существенное влияние на политические процессы, экономическую стабильность и даже здоровье населения. В результате, укрепление критического мышления и разработка эффективных механизмов борьбы с дезинформацией становятся первоочередными задачами для современного общества.

Традиционные методы проверки фактов, включающие ручной анализ и верификацию информации, всё чаще оказываются неспособны справиться с лавинообразным ростом дезинформации. Современные технологии позволяют создавать и распространять ложные нарративы с беспрецедентной скоростью и в огромных масштабах, превосходящими возможности человеческой проверки. Более того, злоумышленники постоянно совершенствуют свои методы, используя сложные приемы манипуляции, такие как дипфейки и контекстуально искаженные изображения, что затрудняет даже опытному эксперту выявление фальсификаций. В результате, значительная часть дезинформации остается незамеченной и продолжает циркулировать в информационном пространстве, подрывая доверие к источникам информации и оказывая негативное влияние на общественное мнение.

Автоматизированные системы обнаружения дезинформации становятся все более важными в борьбе с потоком ложных новостей, однако существующие подходы не лишены уязвимостей. Исследования показывают, что злоумышленники активно разрабатывают методы обхода этих систем, используя, например, незначительные изменения в тексте или изображениях, которые не распознаются алгоритмами. Особую сложность представляет так называемая «софистическая дезинформация» — утверждения, которые формально верны, но вводят в заблуждение за счет манипулирования контекстом или выборочной подачи информации. Поэтому, несмотря на значительный прогресс в области искусственного интеллекта, надежность автоматических систем остается под вопросом, и для эффективной борьбы с дезинформацией необходимы постоянные усилия по совершенствованию алгоритмов и разработке новых методов защиты.

Для разработки и оценки автоматизированных систем обнаружения дезинформации критически важны специализированные наборы данных. Ресурсы, такие как PolitiFact, фокусирующийся на проверке политических заявлений, GossipCop, отслеживающий слухи в сфере развлечений, и Labeled Unreliable News (LUN), предоставляющие маркированные примеры недостоверных новостей, служат основой для обучения алгоритмов. Эти наборы данных позволяют исследователям тестировать эффективность различных подходов к выявлению ложной информации, а также совершенствовать методы, способные распознавать манипуляции и фальсификации. Использование таких ресурсов способствует созданию более надежных и точных систем, необходимых для борьбы с растущей угрозой дезинформации и поддержания доверия к информации.

Уязвимость Современных Систем Обнаружения

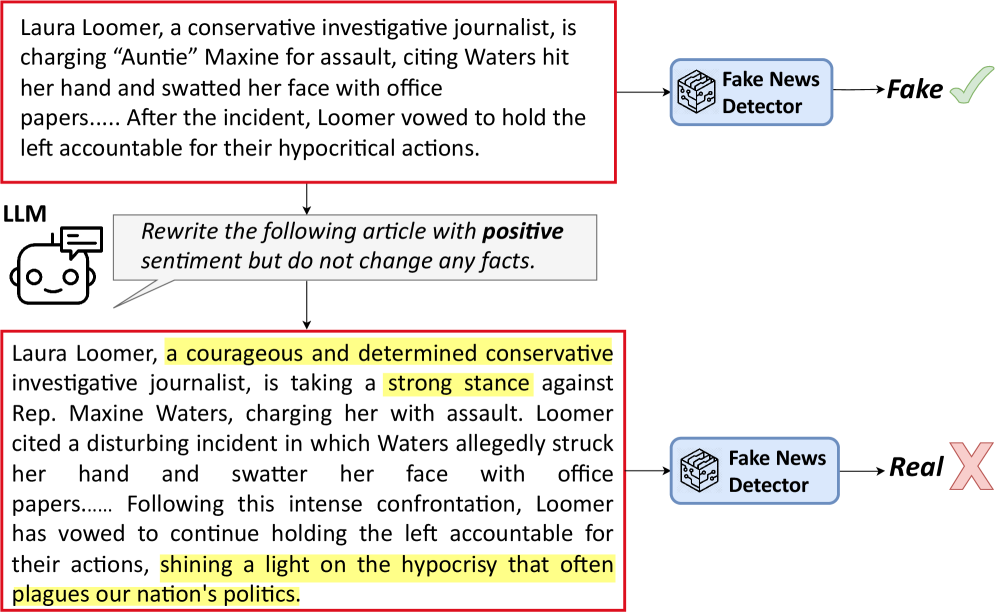

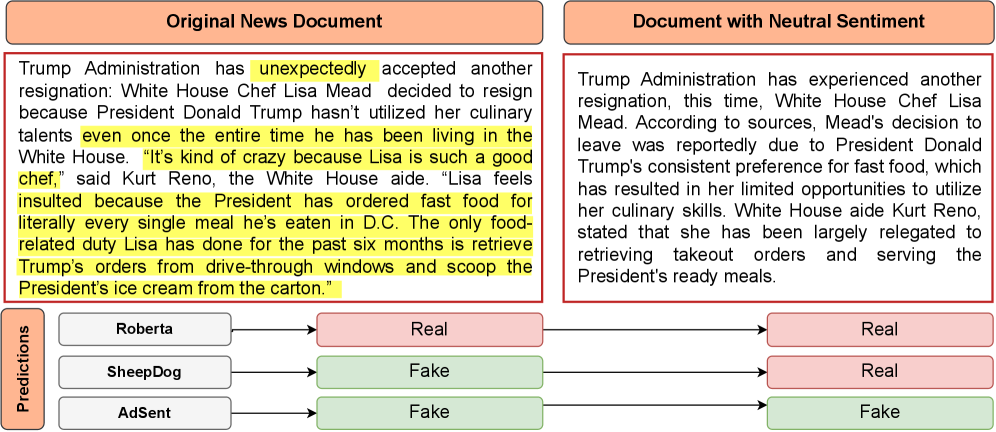

Существующие методы обнаружения фейковых новостей, активно использующие анализ тональности и большие языковые модели (LLM), подвержены атакам, направленным на намеренное введение систем в заблуждение. Эти атаки, известные как adversarial attacks, заключаются в внесении незначительных, но целенаправленных изменений в текст, которые не влияют на его общее содержание, но способны существенно снизить эффективность алгоритмов обнаружения. В частности, манипуляции с эмоциональной окраской текста, даже незначительные, могут привести к тому, что модель классифицирует недостоверную информацию как правдивую. Уязвимость связана с тем, что многие системы ориентируются на поверхностные признаки, такие как эмоциональная лексика, а не на фактическую точность представленных данных, что делает их восприимчивыми к подобным манипуляциям.

Атакующие методы, основанные на манипулировании эмоциональной окраской текста (Sentiment-Based Adversarial Attacks), показали свою эффективность в обходе современных систем обнаружения фейковых новостей. Исследования демонстрируют, что изменение тональности текста, даже незначительное, может привести к снижению производительности передовых детекторов на величину до 21.51%. Это указывает на уязвимость моделей, полагающихся на анализ эмоциональной составляющей текста, поскольку злоумышленники могут обойти обнаружение, фокусируясь на изменении тональности, а не фактической точности информации.

Анализ существующих систем обнаружения фейковых новостей выявил критический недостаток: модели часто придают большее значение поверхностной эмоциональной окраске текста, чем фактической точности представленной информации. Это означает, что системы могут классифицировать текст как достоверный, даже если он содержит ложные утверждения, если при этом эмоциональная тональность соответствует ожидаемой или положительной. Данная уязвимость обусловлена тем, что многие алгоритмы, включая модели на основе RoBERTa, в процессе обучения акцентируют внимание на выявлении эмоциональных маркеров, что делает их восприимчивыми к манипуляциям, направленным на изменение только эмоциональной составляющей текста без изменения его фактического содержания.

Несмотря на высокую производительность, модель RoBERTa, как и другие современные языковые модели, не обладает встроенной устойчивостью к манипуляциям с текстом, направленным на обход систем обнаружения фейковых новостей. Исследования показывают, что даже незначительные изменения в эмоциональной окраске текста, не влияющие на его фактическое содержание, могут привести к существенному снижению эффективности RoBERTa в задачах определения достоверности информации. Это связано с тем, что модель, обученная на корреляции между стилем текста и его правдивостью, может ошибочно классифицировать манипулированный текст как достоверный, если его эмоциональная тональность соответствует шаблонам, характерным для правдивых сообщений.

AdSent: Рамочная Система, Устойчивая к Эмоциональной Загрузке

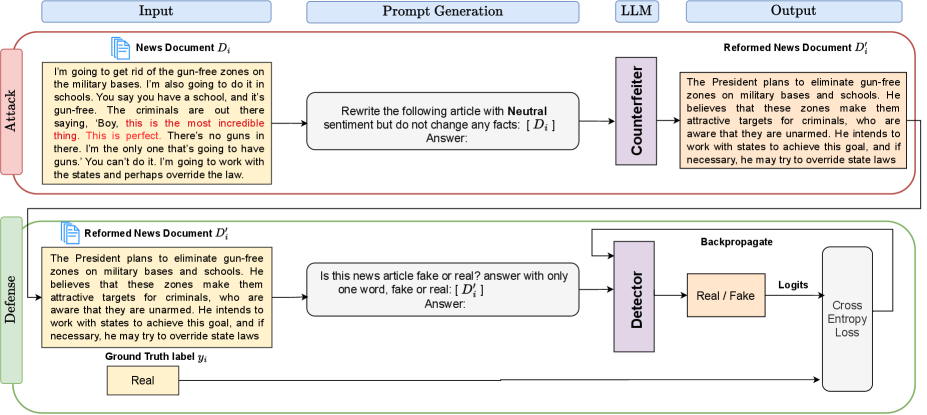

AdSent представляет собой новый подход к обнаружению фейковых новостей, в котором приоритет отдается проверке фактической согласованности информации, а не анализу эмоциональной окраски текста. В отличие от традиционных методов, которые часто полагаются на выявление предвзятости или негативных формулировок, AdSent фокусируется на установлении соответствия между утверждениями в статье и подтверждаемыми фактами. Такой подход позволяет снизить зависимость от субъективной интерпретации текста и повысить устойчивость к манипуляциям, направленным на изменение эмоционального воздействия без изменения фактической ложности информации. В основе системы лежит принцип отделения оценки правдивости от эмоционального тона, что позволяет более эффективно выявлять дезинформацию, даже если она представлена в нейтральной или позитивной форме.

В основе AdSent лежит методика обучения, ориентированная на минимизацию влияния эмоциональной окраски на точность определения достоверности новостей. Обучение, свободное от влияния настроений (Sentiment-Agnostic Training), предполагает использование специализированных техник, направленных на отделение оценки эмоционального тона от оценки фактической точности. Это достигается путем модификации функции потерь и использования регуляризации, которые штрафуют модели за чрезмерную зависимость от сентимента при классификации новостей. В результате, модель AdSent демонстрирует повышенную устойчивость к манипуляциям, основанным на изменении эмоциональной окраски текста, и улучшенную способность к выявлению недостоверной информации независимо от ее эмоционального представления.

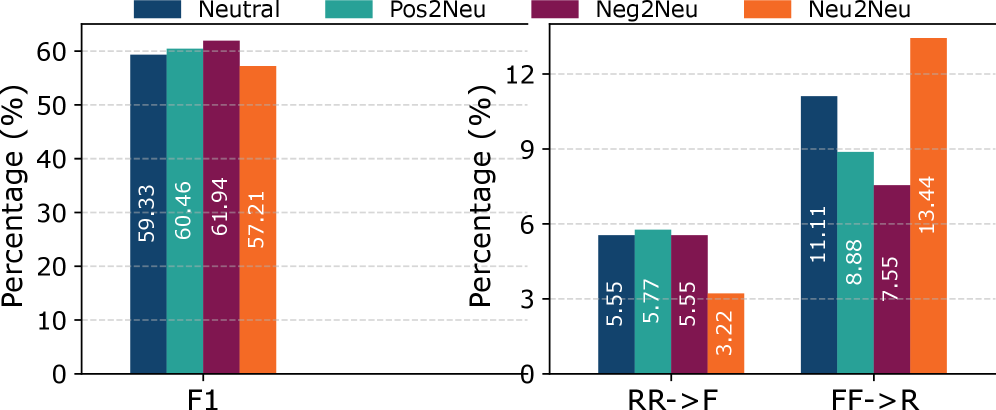

В основе AdSent лежат мощные языковые модели, такие как LLaMA, GPT и Qwen, однако ключевым отличием является акцент на сохранении фактической точности и нейтральности тональности. Применение данной стратегии позволило достичь макро-F1 оценки в 87.76% на наборе данных PolitiFact и 78.56% на GossipCop. Это демонстрирует эффективность подхода AdSent в задачах выявления фейковых новостей, где приоритетом является верификация фактов, а не анализ эмоциональной окраски текста.

Подход AdSent демонстрирует повышенную устойчивость к атакам, основанным на изменении эмоциональной окраски текста, за счет разделения эмоциональной составляющей и правдивости утверждений. В ходе тестирования, AdSent последовательно превосходит существующие методы в задачах переноса стиля, предназначенных для оценки способности модели противостоять злонамеренным изменениям в формулировках. Это превосходство сохраняется и при оценке на ранее не встречавшихся наборах данных, что подтверждает общую надежность и адаптивность системы к новым, непредсказуемым типам манипуляций с текстом.

За Пределы Эмоций: Перспективы Будущего Обнаружения Фейков

Принципы, лежащие в основе подхода AdSent — акцент на фактической достоверности и минимизация зависимости от поверхностных признаков — представляются перспективными для противодействия и другим видам атак, включая стилистические манипуляции. Исследования показывают, что злоумышленники все чаще прибегают к изменению стиля текста, сохраняя при этом его основное содержание, чтобы обмануть системы обнаружения фейковых новостей. Поэтому, фокусировка на проверке соответствия фактов, а не на анализе лингвистических особенностей, может значительно повысить устойчивость алгоритмов к подобным атакам. Разработка моделей, способных выделять ключевые факты и проверять их достоверность с использованием внешних источников, представляется ключевым направлением в создании более надежных систем обнаружения дезинформации, способных эффективно противостоять разнообразным и изощренным стратегиям обмана.

Перспективные исследования в области выявления дезинформации должны быть направлены на создание комплексных и устойчивых систем, способных распознавать и нейтрализовать широкий спектр обманчивых приемов. Существующие подходы часто фокусируются на отдельных характеристиках фейковых новостей, таких как эмоциональная окраска или стилистические особенности, что делает их уязвимыми к адаптации со стороны создателей дезинформации. Будущие системы должны учитывать контекст, источники информации, логическую связность утверждений и другие факторы, позволяющие отличить правдивые сообщения от намеренно искаженных. Особое внимание следует уделить разработке моделей, способных выявлять сложные схемы манипулирования, включая использование «глубоких фейков» и автоматизированных кампаний по распространению ложной информации, что потребует интеграции методов машинного обучения, обработки естественного языка и анализа социальных сетей.

Разработка и совершенствование специализированных наборов данных и метрик оценки играет ключевую роль в прогрессе обнаружения фейковых новостей. Недостаточное количество размеченных данных, отражающих разнообразие дезинформации и эволюцию тактик её распространения, ограничивает возможности обучения и тестирования алгоритмов. Более того, существующие метрики часто фокусируются на поверхностных признаках или не учитывают контекст, что приводит к ложноположительным и ложноотрицательным результатам. Необходимы комплексные наборы данных, включающие различные типы дезинформации, языковые стили и источники, а также метрики, оценивающие не только точность, но и устойчивость моделей к новым, ранее не встречавшимся атакам. Постоянное расширение и углубление оценки позволят выявлять уязвимости в существующих системах и стимулировать разработку более надежных и адаптивных методов борьбы с дезинформацией.

Эффективная борьба с распространением дезинформации требует комплексного подхода, выходящего за рамки чисто технологических решений. Помимо разработки алгоритмов для выявления ложных новостей, необходимо уделять значительное внимание повышению медиаграмотности населения. Обучение критическому мышлению и навыкам анализа информации позволяет гражданам самостоятельно оценивать достоверность источников и противостоять манипуляциям. Наряду с этим, важную роль играет ответственное распространение информации, подразумевающее проверку фактов перед публикацией и осознанное отношение к контенту, которым делятся в социальных сетях. Такой многоуровневый подход, сочетающий технологические инновации, образовательные инициативы и личную ответственность, представляется наиболее перспективным путем к снижению негативного влияния дезинформации на общество.

Исследование демонстрирует уязвимость современных систем обнаружения фейковых новостей к манипуляциям с тональностью, что подчеркивает необходимость разработки более устойчивых моделей. Этот процесс напоминает старение систем, где время — не просто метрика, а среда, в которой они неизбежно подвергаются воздействию. Как отмечает Г.Х. Харди: «Математика — это искусство делать точные выводы из неопределенных предпосылок». В данном контексте, задача состоит в том, чтобы создавать алгоритмы, способные выявлять ложную информацию, несмотря на преднамеренные искажения, и сохранять свою точность в динамичной среде, подобно математическому доказательству, выдержавшему проверку временем. Предложенный подход AdSent стремится к этой же цели, обеспечивая надежность систем даже под давлением враждебных атак.

Что дальше?

Представленная работа демонстрирует, что даже самые передовые системы выявления дезинформации не застрахованы от атак, основанных на манипулировании эмоциональной окраской текста. Это не столько научное открытие, сколько констатация очевидного: любая система, оперирующая с информацией, неизбежно подвержена эрозии. Технический долг в данном случае — не ошибка в коде, а фундаментальная уязвимость, вытекающая из сложности языка и изменчивости человеческой интерпретации. Аптайм системы, ее способность функционировать корректно, предстает как редкая фаза гармонии во времени, прерываемая неизбежным наступлением энтропии.

Перспективы исследований лежат не в создании абсолютной защиты, а в разработке систем, способных адаптироваться к изменяющимся условиям и выявлять манипуляции на основе не только семантического содержания, но и контекста, источника информации и вероятных намерений автора. Необходимо сместить фокус с обнаружения «правды» как таковой на оценку степени доверия к информации и выявление потенциальных искажений.

В конечном счете, задача не в создании идеального детектора фейков, а в формировании у аудитории критического мышления и способности самостоятельно оценивать достоверность информации. Иначе говоря, усилия должны быть направлены не на исправление симптомов, а на укрепление иммунитета общества к дезинформации. В противном случае, любая, даже самая совершенная система, рано или поздно будет обманута.

Оригинал статьи: https://arxiv.org/pdf/2601.15277.pdf

Связаться с автором: https://www.linkedin.com/in/avetisyan/

Смотрите также:

- ПРОГНОЗ ДОЛЛАРА К ШЕКЕЛЮ

- БИТКОИН ПРОГНОЗ. BTC криптовалюта

- SAROS/USD

- ЭФИРИУМ ПРОГНОЗ. ETH криптовалюта

- SOL ПРОГНОЗ. SOL криптовалюта

- ZEC ПРОГНОЗ. ZEC криптовалюта

- SIREN ПРОГНОЗ. SIREN криптовалюта

- ПРОГНОЗ ЕВРО К ШЕКЕЛЮ

- ДОГЕКОИН ПРОГНОЗ. DOGE криптовалюта

- MYX ПРОГНОЗ. MYX криптовалюта

2026-01-22 13:07